Esses trinta dias loucos, onze grandes modelos, parecem um espetáculo de fogos de artifício barulhento.

Autor do artigo, fonte: 0x9999in1, ME News

TL;DR

- Trinta dias de competição extrema: de 26 de março a 24 de abril, foram lançados 11 grandes modelos globais, um a cada 2,7 dias. O mercado enfrenta uma "fadiga de parâmetros" severa.

- A “cirurgia de emagrecimento” do Parâmetro Gourmand: o V4-Pro possui 1,6T de parâmetros totais, mas apenas 49B estão ativados. Por meio da reestruturação da arquitetura CSA+HCA, os FLOPs caem para 27% com contexto de 1M e o cache KV reduz-se a um incrível 10%.

- A separação de gerações da alquimia: introduz o paradigma de pós-treinamento “primeiro reforço independente, depois fusão por distilação online”, com o V4-Pro-Max aproximando-se do teto das soluções fechadas em inferência e tarefas de Agent.

- Votos em dinheiro real: O GPT-5.5 apenas impulsionou a alta de 4,2% de um único dia da NVIDIA antes de atingir o pico, enquanto o V4, totalmente aberto pela MIT, acendeu completamente a alta contínua da cadeia de capacidade de processamento local na China e Hong Kong.

- Lógica de jogo profundo: modelos fechados vendem "imposto"; modelos de grande porte abertos vendem "ferro". A chegada do V4 finalmente equilibrou o livro de computação para implantação privada empresarial em todo o mundo.

Abril da corrida dos deuses, com a fadiga estética do mercado

Louco. Todos estão loucos.

Se você é um observador atento ao setor de IA, os últimos trinta dias provavelmente o deixaram com desconforto fisiológico. De 26 de março de 2026 a 24 de abril, em menos de um mês, pelo menos onze grandes modelos com influência significativa foram lançados no mercado global.

A lista parece um cardápio: Anthropic Opus 4.6, Google Gemini 3.1 Pro, OpenAI GPT-5.5, Mistral Large 3, Meta Llama 4, Moonshot Kimi K2.6, Alibaba Qwen3-Next, ByteDance Doubao 2.5 Pro, Tencent Hunyuan 3.0, Kimi K2.6 Plus.

Além disso, no dia 23 de abril, às 4h da manhã, o DeepSeek V4 foi lançado silenciosamente, como uma bomba subaquática.

Em média, um novo modelo é lançado a cada 2,7 dias. É uma velocidade tão rápida que até os gestores de fundos não conseguem ler todos os comunicados. Enquanto os investidores ainda ouviam o “superior em parâmetros” da empresa A, o “desempenho esmagador” da empresa B já estava em sua mesa. O mercado já está entorpecido. O chamado “ranking de benchmarks” está se tornando cada vez mais uma espécie de jogo numérico de entretenimento próprio, em um cenário de intensa concorrência.

Mas o dinheiro é esperto. Ou, as velas não mentem.

Ao analisar os candles dos ativos de IA da China, dos EUA e de Hong Kong nos últimos 30 dias, você descobrirá uma realidade extremamente fria: nesta "guerra dos deuses", apenas dois pontos deixaram marcas persistentes no gráfico.

Primeiro, em 8 de abril, a OpenAI do outro lado do oceano lançou o GPT-5.5. Este rei incontestável impulsionou diretamente uma alta de 4,2% em um único dia da NVIDIA. E depois? Não houve mais nada; atingiu o pico em um dia, e o bom noticiário foi totalmente consumido. Todos perceberam que, por mais grandioso que seja o rei fechado, é difícil agora, como há dois anos, mover facilmente a pesada montanha do capital global.

O segundo nó é de 23 a 24 de abril. Versão de pré-visualização do DeepSeek V4 lançada. Sem lançamento extravagante, sem宣传片 impressionante. Os pesos foram diretamente disponibilizados no Hugging Face e ModelScope, com licença MIT.

Resultado? Isso impulsionou a cadeia de poder de mineração da China e de Hong Kong a sair de uma série de saltos de alta.

Por quê? Por que um modelo de código aberto conseguiu fazer o que muitos especialistas de código fechado não conseguiram?

Para responder a essa pergunta, precisamos agir como contadores de histórias, deixando de lado os comunicados de imprensa chatos, abrindo o capô do DeepSeek V4 e ver o que há dentro desse monstro.

Análise do V4: Não mais a crença na estética da força de parâmetros

Modelos grandes. Muito caros. Isso é de conhecimento geral.

No último ano, as empresas de grandes modelos caíram em uma “fobia de falta de poder”. Você faz um trilhão, eu faço dois trilhões. Todos acreditavam que, desde que tivessem força suficiente, a inteligência emergente resolveria todos os problemas. Mas isso trouxe consigo custos de computação extremamente assustadores. Nem mesmo o suprimento extra do fazendeiro é suficiente para queimar.

DeepSeek V4 lançou dois modelos MoE (Mistura de Especialistas): V4-Pro e V4-Flash. Vamos analisar alguns dados principais primeiro.

V4-Pro: total de parâmetros de 1,6T (1,6 trilhão), mas apenas 49B (490 bilhões) de parâmetros ativados por token.

V4-Flash: parâmetros totais de 284B (284 bilhões), parâmetros ativados apenas 13B (13 bilhões).

Entendeu? É um “com um toque leve, desvia uma carga pesada” extremamente contido. A essência da arquitetura MoE é não disparar todos os alarmes a cada vez. Para tarefas simples, como matar um frango, mobilize alguns especialistas em matar frangos; para tarefas complexas, como matar um dragão, traga a espada do matador de dragões. A base de 1,6 trilhões garante que ela “tenha visto o mundo e seja extremamente knowledgeável”; os 490 bilhões ativados garantem que ela “responda rapidamente e seja ágil”.

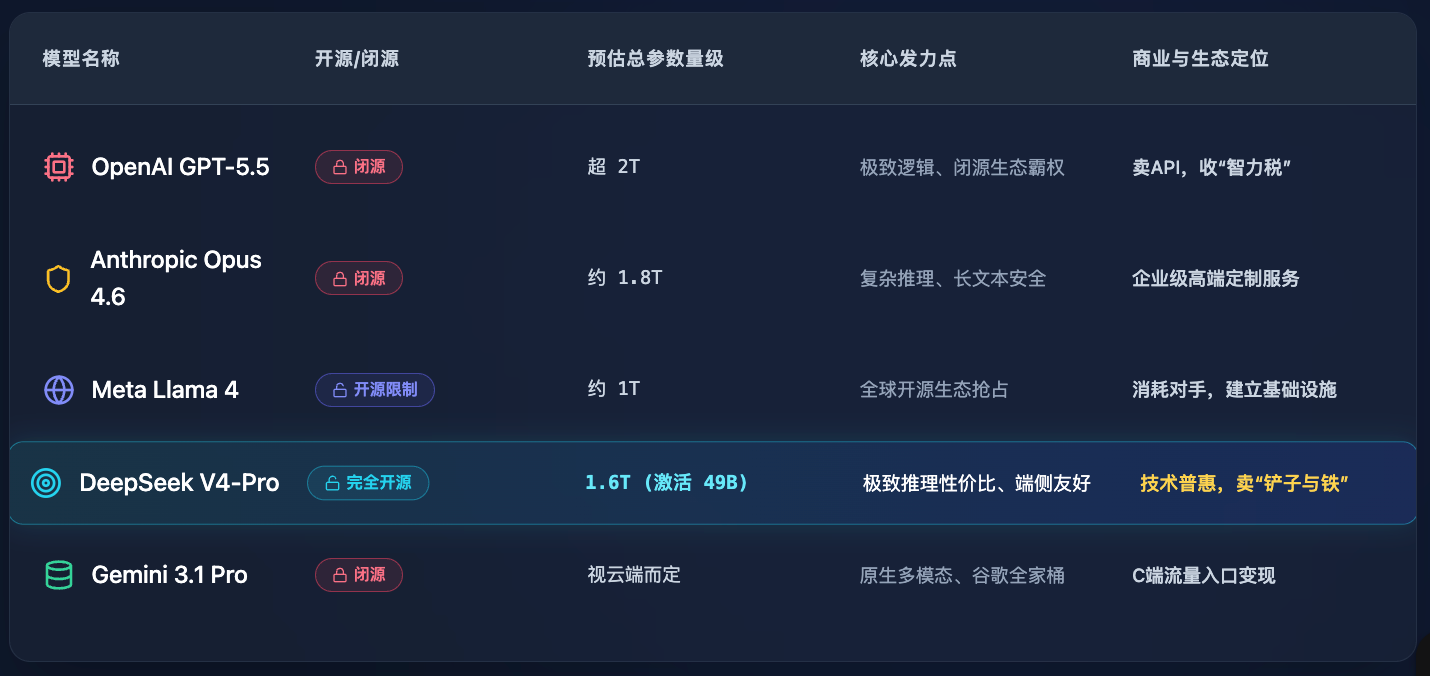

Para visualizar mais claramente essa diferença, criamos uma tabela comparando as principais abordagens do mercado atual (os dados são estimativas e cálculos públicos do mercado):

Ao analisar a tabela, percebe-se que o V4-Pro não busca indiscriminadamente superar o GPT-5.5 em parâmetros totais, mas concentra todos os esforços em “como fazer com que essa gigante consuma menos e corra mais rápido”.

Mas isso ainda não é suficiente. O que realmente deixou os especialistas de cabelo em pé foi a eliminação implacável dos "assassinos de VRAM".

O fim do Memory Assassin: Três lâminas de raspagem arquitetônicas

O que é um "assassino de VRAM"? É "contexto longo (Long Context)".

Agora todos estão se gabando de suportar 1M (um milhão) de tokens de contexto. Parece ótimo — você consegue inserir todo o Romance dos Três Reinos e ele lê em alguns segundos. Mas qual é o custo? Textos longos geram um cache KV enorme durante a inferência (o uso de memória GPU para armazenar informações históricas). É como se, a cada página que você lesse, precisasse copiar toda a página anterior em um quadro-negro gigante à sua frente. Quando você chegar ao um milhão de caracteres, os quadros-negros serão tantos que nem os data centers de Zhongguancun conseguirão acomodar.

Memória é mais cara do que poder de processamento. Esta é a regra não dita da indústria de IA.

Como o DeepSeek V4 resolve esse problema? Eles realizaram uma “cirurgia” direta no mecanismo de atenção subjacente. Esta é a primeira e mais impactante ferramenta de sua atualização de arquitetura: o mecanismo de atenção híbrido (CSA + HCA).

CSA (compressed sparse attention) mais HCA (heavy compressed attention) soa como linguagem de Marte; traduzindo para o português simples: agora ele não decorou mais, aprendeu a "destacar o essencial" e a "fazer anotações mínimas".

O efeito é extremamente drástico: sob um contexto de 1M, os FLOPs (operações de ponto flutuante) por token da V4-Pro são apenas 27% dos da geração anterior V3.2! Mais assustador ainda, o cache KV é apenas 10% do da V3.2!

O que é esse conceito? Equivale a uma tarefa de texto longo de um milhão de caracteres que anteriormente exigia 10 servidores de alto desempenho para ser concluída, e agora é facilmente realizada por apenas um servidor. O custo de computação foi reduzido em 90%. Essa é uma otimização de nível revolucionário.

Ainda há duas facas.

A segunda faca é chamada de "Hiperconexão com Restrição de Variedade (mHC)". Nos grandes modelos anteriores, a transmissão de informações entre camadas era feita por "conexões residuais tradicionais", como usar tubos de ferro antigos e enferrujados para transportar água — quando a pressão aumenta,容易 vazar. Diante de 32T tokens de dados de pré-treinamento em massa, os antigos tubos não aguentavam. A mHC é como trocar por uma rede de fibra óptica, aumentando a estabilidade da propagação de sinal entre camadas. Sem perda de pacotes, sem desvios.

Terceira faca: trocar o óleo do motor. Abandone o tradicional e passe para o otimizador Muon. Ele acelera a convergência. Enquanto outros levam sete vezes sete, ou seja, quarenta e nove dias para refinar uma pílula, ele pode prontificar em vinte dias. Tempo é dinheiro, tempo de máquina é dólar.

These three cuts completely cured the large model's "affluenza."

O segredo do forno de alquimia: da luta isolada à unificação de todas as técnicas

Todos na indústria sabem que o pré-treinamento apenas transforma um “analfabeto” em um “idiota que sabe muitas coisas, mas não consegue falar”. O que realmente o transforma em um mestre supremo é o pós-treinamento (Post-training).

DeepSeek V4, no pós-treinamento, aplicou uma estratégia extremamente avançada de "dois estágios".

Antes, treinar MoE era como um grupo de professores ensinando um único aluno, o que facilmente levava a conflitos. Como o V4 faz isso?

Fase um: “Cada um por si”. Utiliza aprendizado por reforço com SFT (fine-tuning supervisionado) e GRPO (Group Relative Policy Optimization) para separar e treinar individualmente cada “rede especialista” no modelo. O especialista em programação treina diariamente codificação, e o especialista em matemática resolve problemas matemáticos todos os dias. Totalmente independentes, sem interferência mútua. Isso é chamado de levar a capacidade pontual ao extremo.

Fase dois: “Todas as leis retornam à origem”. Por meio da técnica de destilação online, esses especialistas, já treinados em artes marciais supremas, são unificados em um único modelo coerente e integrado. Sem desperdício interno, sem travamentos.

Vamos ver os dois “golpes finais” que eles forçaram.

Primeiro, o modo V4-Pro-Max. Este é o modo de maior poder de inferência. É como desbloquear a trava genética. Segundo eles mesmos (e rapidamente verificado pela comunidade), nos testes de codificação, o V4-Pro já alcançou o nível mais alto, e na execução de tarefas complexas de inferência e Agentes, a lacuna em relação aos modelos fechados de ponta (como GPT-5.5, Opus 4.6) foi significativamente reduzida.

O segundo é o V4-Flash-Max. Isso é ainda mais interessante. É um modelo pequeno de apenas 284B, mas, após receber orçamento suficiente para pensamento, seu desempenho de inferência pode se aproximar do Pro. O que isso indica? Que a "qualidade do algoritmo" está começando a superar o "volume de parâmetros". Desde que você dê a ele tempo suficiente para refletir, até um cérebro pequeno consegue resolver grandes desafios. Claro, em armazenamento de conhecimento puro e tarefas de Agent extremamente complexas e multistep, ele ainda é limitado pelo tamanho dos parâmetros (afinal, o estômago é só aquele), mas isso já é superavitário para a maioria das aplicações empresariais cotidianas.

Por fim, o armazenamento de pesos adota inteligentemente o armazenamento de precisão mista FP4+FP8, mantendo a precisão enquanto economiza memória gráfica. Tudo transmite um charme de estudante de ciências exatas que sabe economizar.

Para comparar mais claramente o aumento de eficiência de engenharia trazido por esse pós-treinamento, vamos apresentar uma tabela de comparação de métricas robustas:

O faro do capital: Por que o V4 acendeu a cadeia de poder de cálculo da China e de Hong Kong?

Até aqui, a análise técnica está quase concluída. Mas ainda não respondemos à pergunta fundamental que fizemos no início:

Por que o GPT-5.5 não conseguiu manter o entusiasmo contínuo no setor de poder de processamento, enquanto o DeepSeek V4 conseguiu?

Isso exige que saiamos do código e enxerguemos esse jogo com os olhos do capital e do negócio.

GPT-5.5 é muito forte, inexpugnavelmente forte. Mas é proprietário. O que significa ser proprietário? Significa que a OpenAI é um enorme "buraco negro". Se você quiser usar sua capacidade, precisa comprar sua API. É um modelo de "cobrança de impostos". Os lucros fluem para a Silicon Valley, e a demanda por poder de computação se concentra nos data centers em nuvem da Microsoft. Para fabricantes de hardware globais, centros de computação locais e agentes de servidores de diversos países, além de olhar para cima, não sobra muita parte. Mesmo que o GPT-5.5 seja tão poderoso, é a festa de outra pessoa. A Nvidia subiu porque todos acham que a OpenAI ainda vai comprar mais chips.

Mas o DeepSeek V4 é diferente.

É de código aberto e possui uma licença MIT extremamente permissiva. A licença MIT é o presente mais generoso da comunidade de código aberto, o que significa que empresas comerciais podem usá-la, modificá-la e vendê-la gratuitamente, sem se preocupar com riscos legais.

Mais fatal ainda, dedicamos grande parte do texto anterior para argumentar que o V4 reduziu o custo de inferência do modelo e o uso de memória gráfica até os tornozelos.

Ao combinar esses dois pontos, você chega a uma conclusão que deixará os mercados financeiros loucos: o ponto crítico da implantação privada finalmente chegou.

No passado, empresas que desejavam implantar um modelo grande de mais de 1 TB olhavam para a tabela de preços de hardware, fechavam silenciosamente e iam comprar API. Agora, o V4 diz a todos: você precisa de apenas poucas máquinas para executar localmente um supercérebro quase idêntico ao GPT-4 e até capaz de desafiar o nível do GPT-5.5. Os dados não precisam sair da província nem do país, são absolutamente seguros.

Como todos agora podem executar localmente, o que acontecerá a seguir?

Compre máquinas! Compre servidores! Compre módulos ópticos! Construa um centro de computação inteligente!

As grandes empresas de código fechado vendem um imposto sobre a inteligência, enquanto as grandes empresas de código aberto, em essência, estão fazendo promoção para os fabricantes de hardware de toda a indústria. O DeepSeek V4 é a pessoa que lançou a faísca. Quanto mais útil e mais aberto ele for, maior será o boom na demanda por capacidade de cálculo localizada em regiões como China, Hong Kong e Taiwan. Empresas que fabricam servidores, desenvolvem refrigeração líquida e operam data centers finalmente viram o dinheiro real da implementação em larga escala.

É por isso que a cadeia de poder de mineração da China e de Hong Kong subiu em saltos consecutivos assim que a V4 foi lançada em 23 de abril. O capital não está pagando por emoção; o capital está se posicionando antecipadamente para a iminente “onda de implantação privada em milhares de setores”.

Isso é o plano comercial subjacente.

Conclusão: A maré baixa e os recifes

Esses trinta dias loucos, onze grandes modelos, parecem um espetáculo de fogos de artifício barulhento.

Os gigantes trocam golpes com grandes quantias nos parâmetros, tentando derrubar os oponentes com socos de poder de processamento. Mas, após o barulho, quem geralmente permanece para transformar o panorama da indústria não é o mais barulhento.

A aparição do DeepSeek V4 é como um assassino calmo. Ele não compete com você em quem gasta mais dinheiro; ele ataca apenas o ponto fraco mais doloroso: eliminar a memória gráfica desnecessária, nivelar a barreira de implantação e transformar o jogo de alto nível em um jogo para todos.

Nesta guerra de IA chamada "Ragnarök", a era de empilhar parâmetros cegamente está acelerando seu fim. O campo de batalha do futuro pertencerá àqueles que conseguirem encontrar o equilíbrio perfeito entre "desempenho extremo" e "eficiência de engenharia".

As marés das tendências sempre recuam; só após a maré baixar é que se vê quem está nu e quem é aquela rocha inabalável.

V4 já distribuiu as armas a todos. Agora, fica a cargo de cada senhor feudal estabelecer seu acampamento nesta nova terra.

Ao compreender esse nível, ao ouvir aqueles anúncios barulhentos de “lançamento impactante” ou “redefinição”, talvez você consiga ser um pouco mais tranquilo e menos ansioso.

After all, no matter how dazzling the magic, it ultimately comes down to the ledger, balancing out those few coins.

Fonte:

- Prévia da Série DeepSeek V4 – Lançamento Oficial, DeepSeek Team, GitHub/ModelScope/HuggingFace. (2026).

- O Rally de IA de abril: Analisando o ciclo de 30 dias dos modelos grandes, ME News Market Observer. (2026).

- Leis de Escalamento e a Mudança de Paradigma Pós-Treinamento, Journal of Artificial Intelligence Economics. (2026).

- Relatório de Pulse do Mercado de Cadeia de Suprimentos de Computação Global (abril de 2026), Pan-Ásia Financial Data Analytics. (2026).