DeepSeek V4 finalmente foi lançado. Este é um momento aguardado por quase cinco meses. O modelo principal MoE com 1T de parâmetros + a versão Flash com 285B de parâmetros, seguida pela versão Pro completa de 1,6T, foi totalmente aberta no GitHub sob a licença Apache 2.0, com pesos e código de implantação liberados simultaneamente.

Assim que o modelo foi lançado, os mercados financeiros responderam com três maneiras distintas, mas interligadas.

Diferentes reações do mercado de capitais

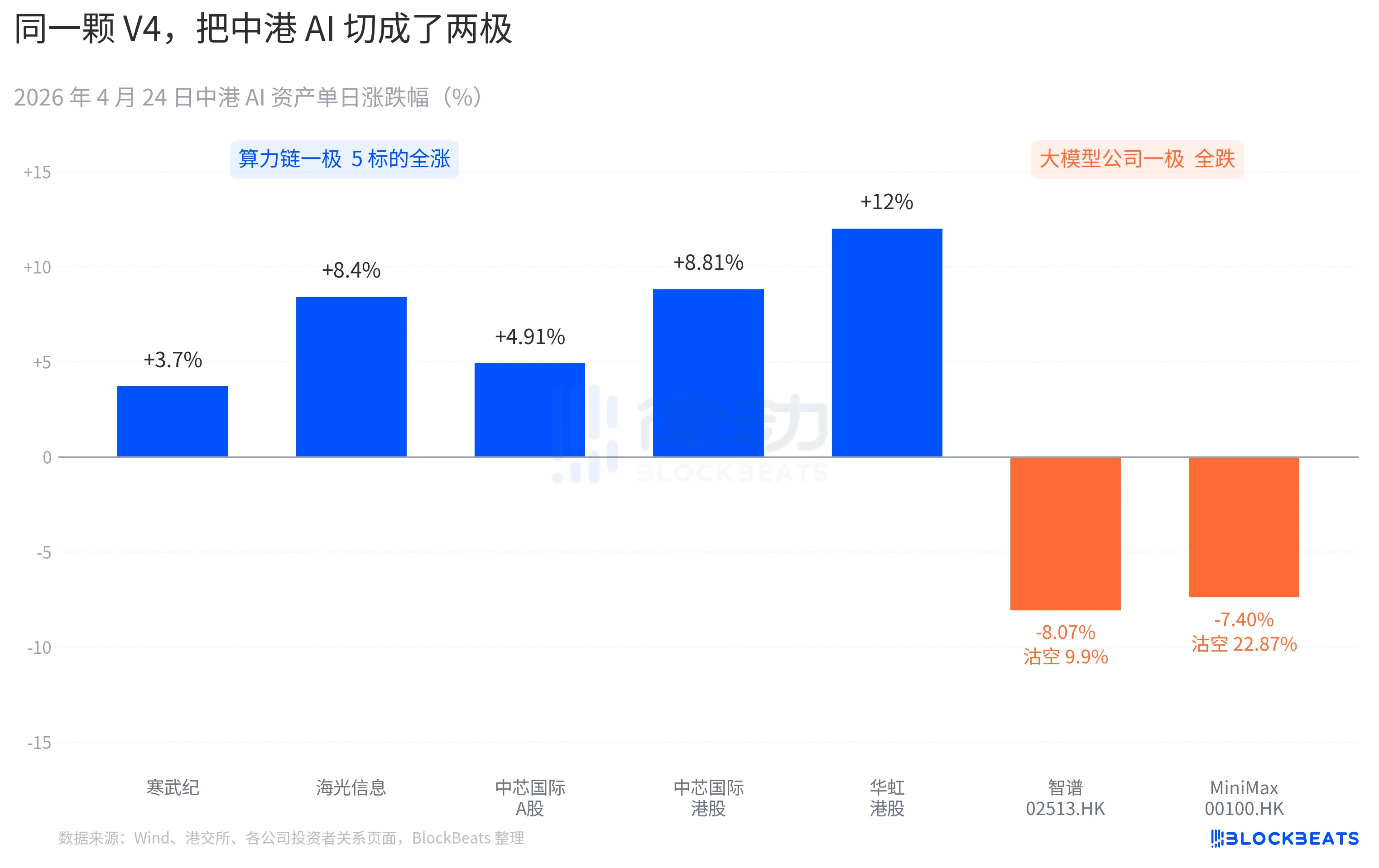

Quase todos os ativos da cadeia de computação de chips subiram fortemente. Cambricon apresentou 11 altas consecutivas, subindo 3,7% em um único dia, com ganho acumulado no mês superando 60%. Higon Information atingiu o limite diário de alta de 10% durante o pregão, fechando em +8,4%. SMIC A-shares subiu +4,91%, enquanto suas ações港股 subiram +8,81%. Hua Hong Semiconductor港股 atingiu pico de +18% durante o dia, fechando em +12%. O ETF Nacional de Chips de Ciência e Tecnologia Cathay registrou entrada líquida de 2,4 bilhões de yuans em um único dia, alcançando seu maior patamar histórico.

A cabeça das empresas de modelos grandes de Hong Kong tem outra cor. Zhipu (02513.HK) caiu 8,07%, com proporção de venda a descoberto de 9,9%. MiniMax (00100.HK) caiu 7,40%, com a proporção de venda a descoberto disparando para 22,87%. Esta última registrou o maior volume diário de venda a descoberto do setor de IA em Hong Kong nos últimos três meses. Ambas as empresas são representantes da onda de IPOs de IA em Hong Kong no segundo semestre de 2025, e seus prospectos de IPO listam a mesma frase como competência central: “modelo base autodesenvolvido”.

A reação do outro lado do Pacífico foi igualmente específica. A NVIDIA abriu em queda de 1,8% em 24 de abril, caindo até -2,6% durante o dia e fechando no mesmo nível. A avaliação rápida de mercado da Bloomberg comparou este ajuste ao "momento DeepSeek V3" de 27 de janeiro. A diferença é que, em janeiro, houve uma venda pânica que eliminou US$ 600 bilhões em valor de mercado em um único dia. Desta vez, foi mais como uma reavaliação, com magnitude moderada mas direção clara. Nos relatórios de pesquisa de instituições compradoras, surgiu uma nova frase: "A demanda chinesa por inferência de IA começou a se desconectar da demanda norte-americana por inferência de IA."

Colocando esses três gráficos um sobre o outro, tem-se a primeira sentença escrita pelo mercado nas 24 horas após o lançamento do V4. Após a vitória do código aberto, o dinheiro começou a se reorganizar; o que já não pode mais ser definido é o modelo em si, mas em qual placa ele está sendo executado e em qual cadeia de valor ele está integrado.

30 dias, 11 novos modelos, o V4 acende o fogo para a comunidade de código aberto

A janela de tempo de lançamento do V4 é parte da razão pela qual essa reação foi amplificada.

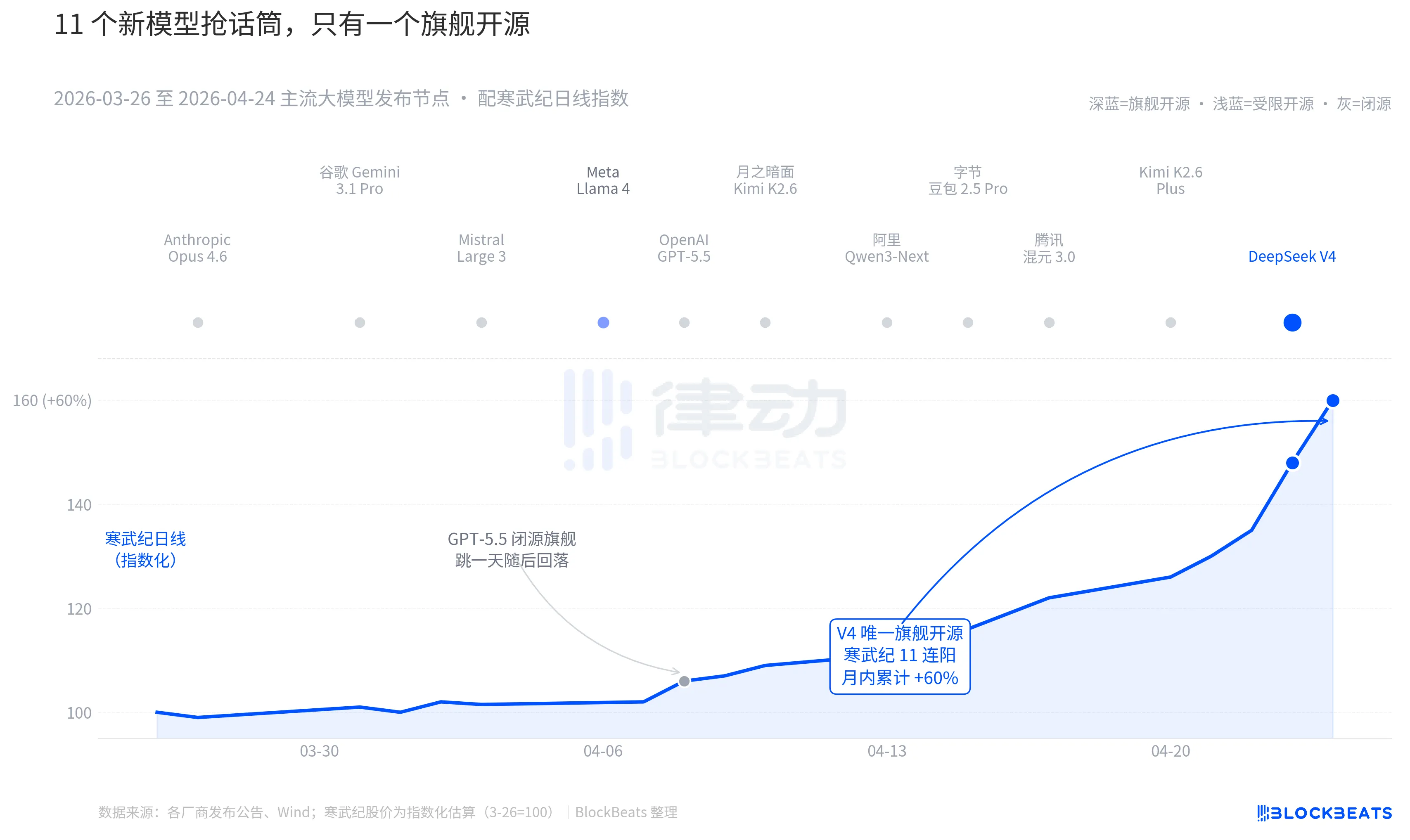

Puxe a câmera para os últimos 30 dias. Entre 26 de março e 24 de abril, pelo menos 11 grandes modelos com influência significativa foram lançados ou atualizados globalmente, abrangendo quase todos os principais players. Anthropic Opus 4.6, Google Gemini 3.1 Pro, OpenAI GPT-5.5, Mistral Large 3, Meta Llama 4, Moonshot Kimi K2.6, Alibaba Qwen3-Next, ByteDance Doubao 2.5 Pro, Tencent Hunyuan 3.0, Kimi K2.6 Plus, e por fim, o DeepSeek V4 lançado na madrugada de 23 de abril.

Em média, um novo modelo é lançado a cada 2,7 dias. Essa é uma velocidade tão rápida que até gestores de fundos não conseguem ler todos os comunicados. Mas, ao analisar os gráficos K das ativos de IA na China e Hong Kong nos últimos 30 dias, apenas um nome deixou uma marca duradoura no gráfico. Em 8 de abril, o GPT-5.5 impulsionou a NVIDIA a subir 4,2% em um único dia, atingindo seu pico. Em seguida, entre 23 e 24 de abril, o DeepSeek V4 impulsionou a cadeia de capacidade de computação na China e Hong Kong a apresentar saltos consecutivos.

A diferença não está na capacidade dos modelos em si. A diferença entre esses 11 modelos na classificação do LMArena, na maioria dos casos, não ultrapassa 50 pontos, estando dentro de uma faixa estreita de "mesma categoria". A diferença está na sobreposição de dois fatores.

A primeira é o código aberto. Dos primeiros 10 modelos, apenas o Llama 4 é de código aberto, mas seu protocolo de pesos inclui uma longa lista de restrições comerciais, resultando em reação fria da comunidade de desenvolvedores na Europa e nos EUA, e caiu fora dos dez primeiros no OpenRouter no terceiro dia. O protocolo do V4 é Apache 2.0, com pesos sem restrições, uso comercial ilimitado e código de inferência liberado simultaneamente. Este é o primeiro modelo de código aberto de destaque nos últimos seis meses a pressionar simultaneamente o campo fechado em desempenho, preço e abertura.

O segundo ponto é o momento. Sob o cenário em que o grupo proprietário está lançando sucessivos golpes, a narrativa open-source está sendo constantemente pressionada. O Opus 4.6 elevou a tarefa de código no SWE-Bench a um novo patamar, enquanto o GPT-5.5 fixou o preço em 1,25 dólar por milhão de tokens como um ponto de referência inferior. A discussão sobre se o open-source conseguirá alcançar o proprietário já dura dois anos na Silicon Valley. O V4, com uma estimativa de 90 milhões de usuários ativos em um mês, colocou essa discussão em pausa.

De acordo com um grande gestor de fundos nacional em uma apresentação de路演, "Antes do V4, aplicamos um desconto na avaliação dos grandes modelos de código aberto; após o V4, esse desconto começou a ser revertido."

DeepSeek trocou a tabela de preços da cadeia de suprimentos de poder de computação

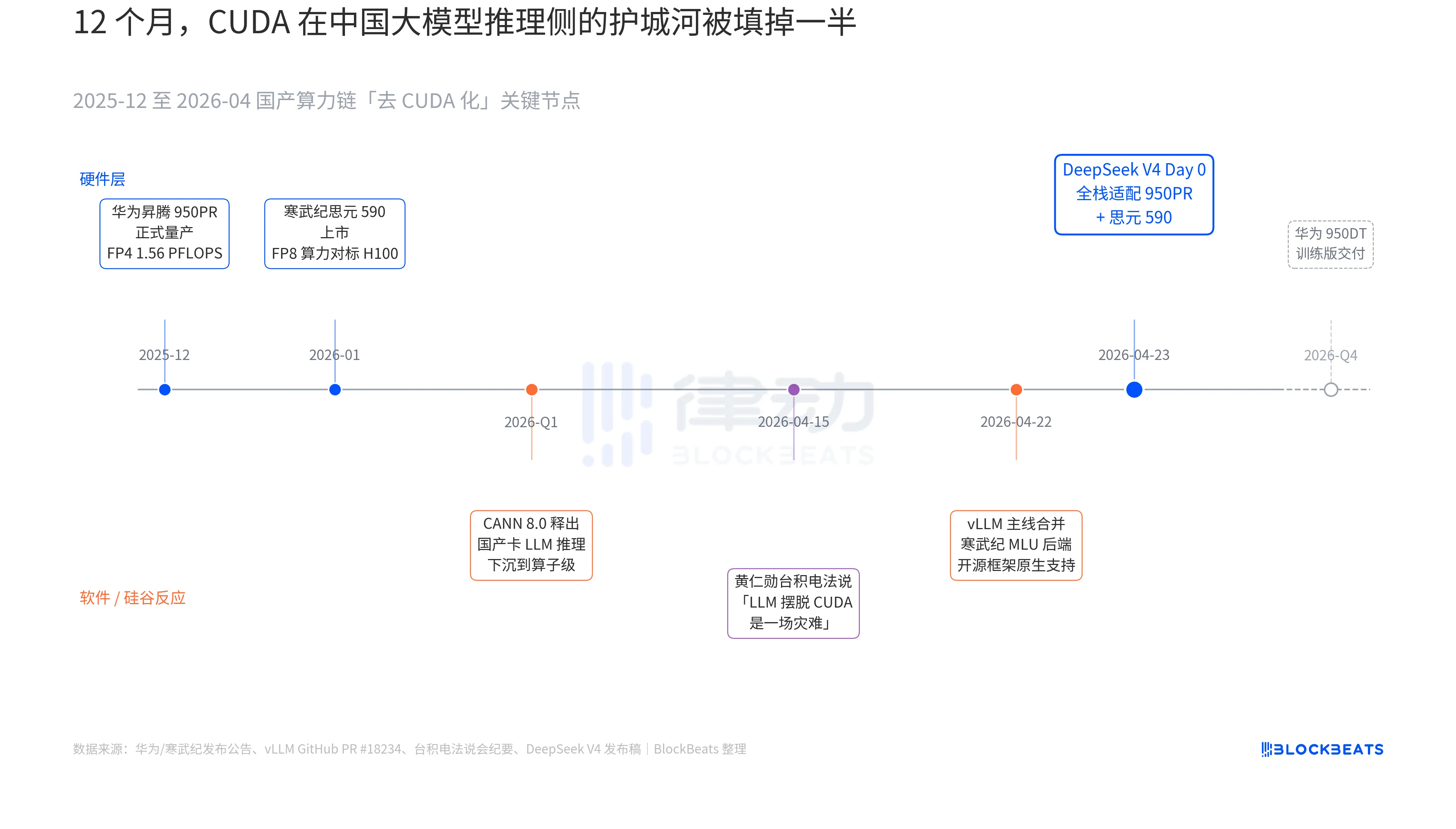

No lançamento da V4, há uma linha que nunca antes apareceu em nenhum documento oficial de grandes modelos chineses: "Dia 0, adaptação completa ao Cambricon MLU590 e ao Huawei Ascend 950PR, código de implantação liberado simultaneamente como código aberto." O peso dessa linha só pode ser compreendido ao conectar as três linhas paralelas que se desenvolveram nos últimos 12 meses: hardware, software e a reação da Vale do Silício.

A primeira linha oculta está no lado do chip. O chip Ascend 950PR da Huawei entrou em produção em massa em dezembro de 2025, com capacidade de processamento FP4 de 1,56 PFLOPS e memória HBM de 112 GB, sendo o primeiro chip de IA nacional a igualar diretamente os chips da série B da NVIDIA em métricas técnicas. Em tarefas de inferência MoE com 1T de parâmetros como V4, o throughput por unidade aumentou 2,87 vezes em comparação com o H20. A pilha de software CANN 8.0 otimiza frameworks de inferência LLM até o nível dos operadores; benchmarks divulgados pela DeepSeek mostram que a latência de inferência de ponta a ponta do V4 em um supernó Ascend (8 chips 950PR) é 35% menor do que em clusters H100 de escala equivalente. Os dados do chip Cambricon MLU590 são ainda mais agressivos: sua capacidade de processamento FP8 por chip iguala a do H100, com preço inferior à metade.

A segunda linha oculta está no lado do software. Em 22 de abril, o vLLM integrou o PR do backend MLU da Cambricon, marcando a primeira vez que um framework de inferência open-source suporta nativamente GPUs nacionais não NVIDIA. O DCU da Hygon segue outro caminho por meio da ecossistema ROCm, mas consegue executar integralmente a camada de roteamento MoE do V4. Isso significa que a implantação do V4 já não é mais “somente possível em um determinado tipo de GPU nacional”, mas sim “pode ser escolhida entre várias GPUs nacionais”. A dependência do ecossistema de um único fornecedor foi quebrada — este é um ponto de virada crucial para produção.

A terceira linha oculta vem da Silicon Valley. Em 15 de abril, Huang Renxun foi pressionado por analistas na conferência de resultados da TSMC sobre os avanços na capacidade de computação nacional da China; sua resposta foi fria e específica: “Se eles realmente conseguirem libertar os LLMs do CUDA, será um desastre para nós.” Nove dias depois, o DeepSeek forneceu a resposta com um único anúncio do Dia 0.

Essas quatro palavras — “substituição nacional” — foram exageradas nos últimos três anos até perderem significado. Mas, após o dia 24 de abril de manhã, pela primeira vez houve dados concretos passíveis de precificação pelo mercado financeiro: throughput por unidade, latência de inferência ponto a ponto, custo de inferência e código de implantação comercializável silenciosamente empurraram essa longa batalha retórica para além da fronteira da produção.

A lógica por trás dos 11 altos consecutivos da ação da Cambricon está aqui. Ela já não é mais apenas uma "ação de conceito de GPU nacional", mas sim um "fornecedor de infraestrutura de inferência DeepSeek V4". A mesma lógica explica a alta de 12% das ações da Hua Hong no港股: ela fabrica o processo equivalente a 7nm do 950PR. Cada token V4 executado em um Ascend nacional significa que parte da capacidade que anteriormente fluía para a NVIDIA e a TSMC agora é parcialmente retida na Região do Delta do Rio Pérla.

O próximo passo já está preparado. No roadmap da Huawei, a 950DT (versão de treinamento) está planejada para entrega no quarto trimestre de 2026, com o objetivo de realizar treinamento completo em uma cluster de 10 mil GPUs para modelos V5 ou de nível equivalente. Se esse caminho for bem-sucedido, a vantagem competitiva do CUDA no treinamento de grandes modelos na China passará de "necessária" para "opcional".

Fonte:律动 BlockBeats