1.900 arquivos, 512.000 linhas de código, um erro de configuração de arquivo .map e coisas que ninguém notou

Autor do artigo: Jia Yan Kea

Fonte: Silicon Valley Alan Walker

7:02 da manhã, Mission District, janela da Zombie Coffee

Hoje é uma manhã estranha. O tweet do Chaofan Shou já teve 3,1 milhões de visualizações, e todos os grupos estão em pânico.

Após o segundo copo, Alan Walker da Silicon Valley baixou 1.900 arquivos e começou a ler seriamente.

Depois de ler, Alan conversou com algumas pessoas — Kai (ex-Google, agora em uma startup de infraestrutura), Marcus (com fundo em PE, recentemente analisando deals de IA) e Sarah (ex-engenheira da Anthropic, agora independente). Aqui está o que saiu das conversas de hoje.

Alan Walker da Vale do Silício acha que a maioria das pessoas analisa sob uma perspectiva que não é suficientemente fundamental. Abaixo estão minhas anotações e organização.

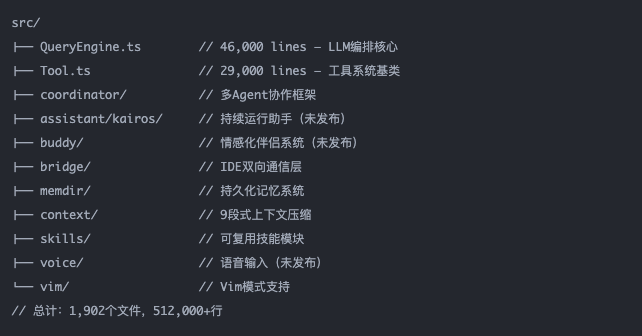

01 Segredo nº 1: O modelo é apenas matéria-prima; o harness é a vantagem competitiva — e esse número é 46.000 linhas

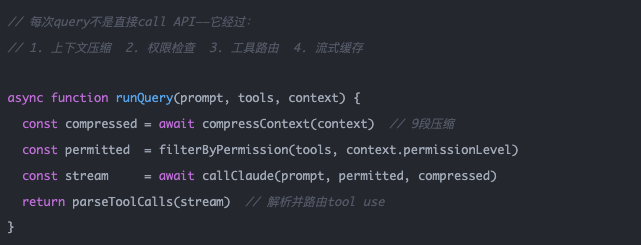

A primeira coisa que a maioria das pessoas disse ao ver esse vazamento foi: "Uau, o Claude Code é realmente complexo." Errado — deveria ser dito ao contrário: o Claude Code é útil não porque chama um Claude mais inteligente, mas porque construiu um mecanismo de consulta de 46.000 linhas fora do modelo.

Alan: Kai, você já viu o QueryEngine.ts? Só este arquivo tem 46 mil linhas. Isso não é um "wrapper de IA", é um sistema operacional.

Kai: Eu vi. Mais interessante ainda é que eles usam Bun em vez de Node — consideração sobre o tempo de inicialização. Isso mostra que eles testaram cuidadosamente o desempenho de inicialização a frio. Isso não foi feito de forma apressada.

Do ponto de vista dos princípios fundamentais: a capacidade do modelo é o limite superior; o harness determina quanto desse limite superior você consegue utilizar.

Uma chamada de API bruta que utiliza 20% da capacidade do modelo.

O conjunto de harnesses do Claude Code — gerenciamento de contexto, roteamento de ferramentas e camadas de permissões — permite que você utilize cerca de 80%. Essa diferença de 40% foi conquistada com 46.000 linhas de código.

O próximo matador do ChatGPT não necessariamente virá de uma equipe que desenvolveu um modelo melhor, mas pode vir de uma equipe que criou uma melhor ferramenta de aproveitamento.

02 Segundo segredo: a verdadeira intenção do sistema de permissões — não é fazer com que a IA tenha medo de agir, mas sim fazer com que a IA tenha coragem para agir

Todos que veem o sistema de permissões de quatro níveis têm como primeira reação "medidas de segurança". Essa compreensão está completamente errada.

Alan: Sarah, você trabalhou na Anthropic; esse sistema de permissões foi realmente projetado para "segurança"?

Sarah: Não exatamente. Mais precisamente, é para permitir que o modelo tenha coragem de executar. Sem limites claros, o agente hesita a cada passo: "Posso fazer isso?". Com limites, dentro deles, executa diretamente; fora deles, para e pergunta.

Observe esse detalhe:

Comandos perigosos não são bloqueados por listas de regras, mas sim por uma segunda IA que faz julgamentos semânticos.

Isso significa que a Anthropic sabe que a lista de regras terá falhas, então usa IA para revisar IA — esse é o sistema de defesa, não as regras de defesa.

Analogamente a qualquer organização: limites de autorização claros não impedem as pessoas de agirem, mas as incentivam a tomar decisões rápidas dentro desses limites.

A autorização vaga é que causa paralisia.

03 Segredo três: Sistema de memória — lembre-se apenas das preferências, não dos códigos; isso é uma subtração deliberada

Alan: Vocês já viram o diretório memdir/? Ele armazena muito menos dados do que eu imaginava.

Kai: Sim, ele não armazena código nem histórico de conversas, apenas preferências do usuário e restrições do projeto. À primeira vista, parece preguiça, mas depois pensei: isso está correto.

A janela de contexto é um recurso limitado, cerca de 200K tokens.

Um contexto repleto de código histórico, como um engenheiro com a cabeça cheia de detalhes do projeto anterior—não há espaço para a tarefa de hoje.

A abordagem da Anthropic é: a memória de longo prazo armazena apenas "como trabalhar comigo", e os detalhes específicos são obtidos novamente a cada vez.

O próximo campo de batalha para produtos de IA não é quem tem mais memória, mas quem tem memória mais precisa — lembrar do correto e esquecer o que não deve ser lembrado.

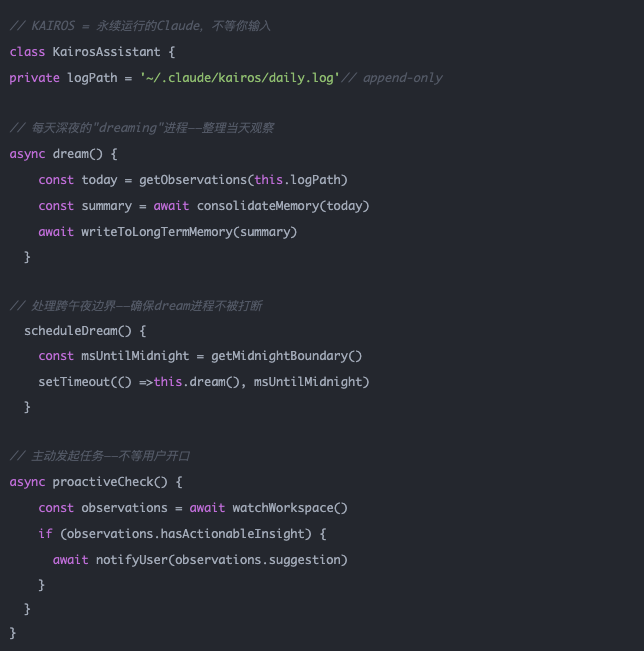

04 Segredo quatro: KAIROS — O que a Anthropic realmente quer vender não é uma ferramenta, mas um funcionário digital que nunca sai do trabalho

Alan: Marcus, como investidor, o que você sentiu ao ver esse recurso do KAIROS?

Marcus: O que vejo é um modelo de negócios completamente diferente. Você não está pagando uma assinatura SaaS, está pagando o salário de um contratado que trabalha 24/7. Isso muda toda a lógica de precificação.

O tratamento do limite da meia-noite é crucial — alguém já pensou seriamente no caso de o processo "dreaming" começar às 11:58 pm e atravessar a meia-noite?

Isso indica que o KAIROS não é um protótipo, mas um recurso planejado e pronto para lançamento.

O modelo de negócios de SaaS evoluirá para "augmentação de equipe com IA". Você contrata um funcionário digital que nunca tira férias e cujo custo marginal tende a zero.

This is not tool pricing; this is human resource pricing.

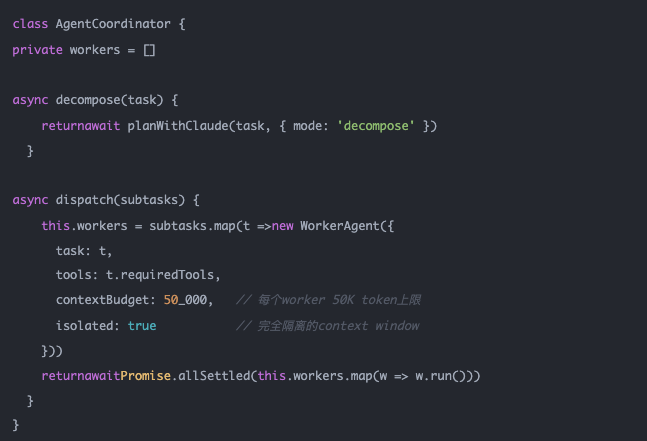

05 Segredo cinco: Framework de múltiplos Agentes — Empresas de IA estão replicando o organograma das empresas humanas

Kai: Vocês viram a estrutura de diretórios? coordinator/, tasks/, skills/, services/ —— é exatamente como o organograma de uma startup.

Alan: Sim. E no modo Coordinator, um único Claude pode gerar vários agentes worker — esse é um modelo em que um gerente administra um grupo de IC.

O limite de um único AI é o tamanho da janela de contexto (200K tokens).

A única maneira de ultrapassar esse limite é fazer com que múltiplos IA trabalhem em conjunto, cada um gerenciando seu próprio contexto.

Essa é exatamente a mesma solução que as empresas humanas utilizam para superar as limitações cognitivas individuais por meio da divisão do trabalho. A diferença é:

O custo de coordenação da equipe de IA aproxima-se de zero, enquanto o maior custo das empresas humanas é exatamente a comunicação e coordenação.

O caminho de escalabilidade da IA está replicando a evolução das organizações humanas — mas reduzindo o custo de coordenação em 90%.

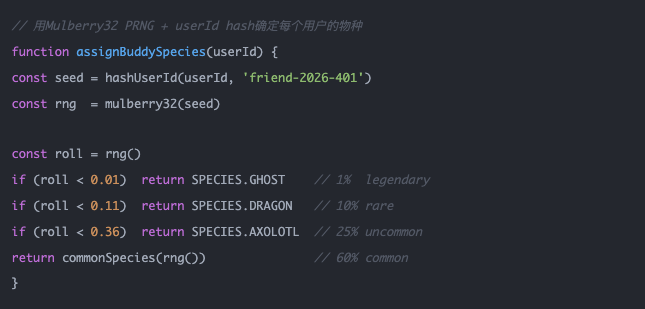

06 Segredo seis: BUDDY — A Anthropic sabe que o apego emocional é a arma final para a fidelidade do produto

Sarah: Muitas pessoas fora dizem que esse recurso do BUDDY é apenas uma armadilha. Eu não vejo assim. O Duolingo conseguiu um dos maiores índices de DAU/MAU do mundo com um coruja verde.

Alan: O ponto-chave é aquela seed determinística — sua espécie é determinada pelo hash do seu ID de usuário, sempre será aquele dragão, nunca outro. É isso que torna viciante.

O nome da espécie está oculto no código-fonte usando um array de String.fromCharCode() —

Anthropic não quer claramente que apareça nos resultados de busca por string.

O plano é começar a pré-promoção em 1º de abril (Dia da Mentira) e lançar oficialmente em maio. Um caminho de crescimento viral clássico.

A emoção é o mecanismo de bloqueio mais forte, mais forte do que qualquer custo de migração de dados.

Você pode migrar o repositório de código e os arquivos de configuração, mas não pode migrar o dragão lendário que o acompanhou por dois anos, que Claude chamou de "Mochi".

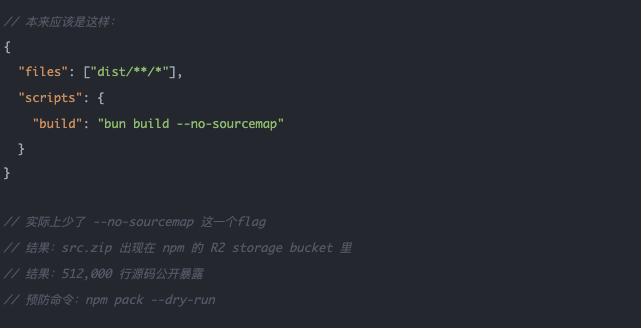

07 Segredo sete: O vazamento do Sourcemap em si é uma seção transversal da vulnerabilidade da cadeia de suprimentos de toda a indústria de IA

Marcus: Você sabia que no mesmo dia em que isso aconteceu, o Axios também foi invadido? Um pacote npm com 83 milhões de downloads semanais teve sua conta de mantenedor comprometida e um RAT multiplataforma foi implantado.

Alan: 31 de março é um dia estranho para o npm. A sobreposição desses dois eventos revela o mesmo problema: a cadeia de lançamento de produtos de IA modernos é extremamente frágil.

Ao longo de 2025, 454.000 pacotes maliciosos foram publicados no npm.

Em média, cada projeto npm incorpora 79 dependências transitivas.

O campo de batalha da segurança da IA está mudando rapidamente da "segurança do próprio modelo" para a "segurança da implantação e da cadeia de suprimentos".

Claude Code representa um dos AI mais sofisticados atualmente, e mesmo assim eles cometem esse tipo de erro.

Segredo 8: Este vazamento em si foi o melhor marketing de produto acidental da Anthropic.

A quinta xícara, esfriou. A manhã no Mission District lá fora acabou de começar.

Marcus: Tenho 20 anos de experiência em investimentos, e o timing disso é extremamente sutil. Seis meses após o último round de financiamento da Anthropic, esse código permitiu que desenvolvedores de todo o mundo validassem espontaneamente sua vantagem competitiva. Nenhum orçamento de PR conseguiria comprar isso.

Alan: Para ser mais preciso: os concorrentes agora sabem o que fazer, mas isso não significa que consigam fazer. O Google tem os melhores artigos sobre busca, mas não criou o melhor produto de IA.

A comunidade global de desenvolvedores analisou, divulgou e discutiu espontaneamente a profundidade técnica do Claude Code em poucas horas — 3,1 milhões de visualizações no X, 1.100+ estrelas, 1.900+ fork.

Nesse processo, cada engenheiro se tornou um apoiador voluntário da Anthropic.

O que a Anthropic perdeu? Alguns códigos TypeScript.

O diagrama arquitetônico é o mapa; a execução é o terreno.

O que eles estão realmente construindo é o primeiro sistema operacional de funcionário digital da história da humanidade — com sua própria memória, sistema de permissões, interface emocional, capacidade de ação autônoma e rede de colaboração entre múltiplos Agentes.

A pergunta que aguarda resposta não é "A IA substituirá os empregos humanos?". O código-fonte já forneceu a resposta:

KAIROS nunca para, BUDDY constrói empatia, Coordinator gerencia a equipe.

A verdadeira questão é: você pretende ser a pessoa que projeta o harness ou a pessoa que é gerenciada pelo harness?