Androides sonham? Se eles sonharem, sonharão com ovelhas eletrônicas?

Screenshot do filme Blade Runner

Em 1968, quando o autor do romance original do filme de ficção científica Blade Runner, Philip K. Dick, digitou essa pergunta abstrata e antecipada na máquina de escrever, provavelmente não imaginou que, mais de meio século depois, os gigantes da tecnologia de Silicon Valley dariam uma resposta com seriedade.

Sim, eles não só sonham com ovelhas eletrônicas, como também conseguem visualizar os sonhos.

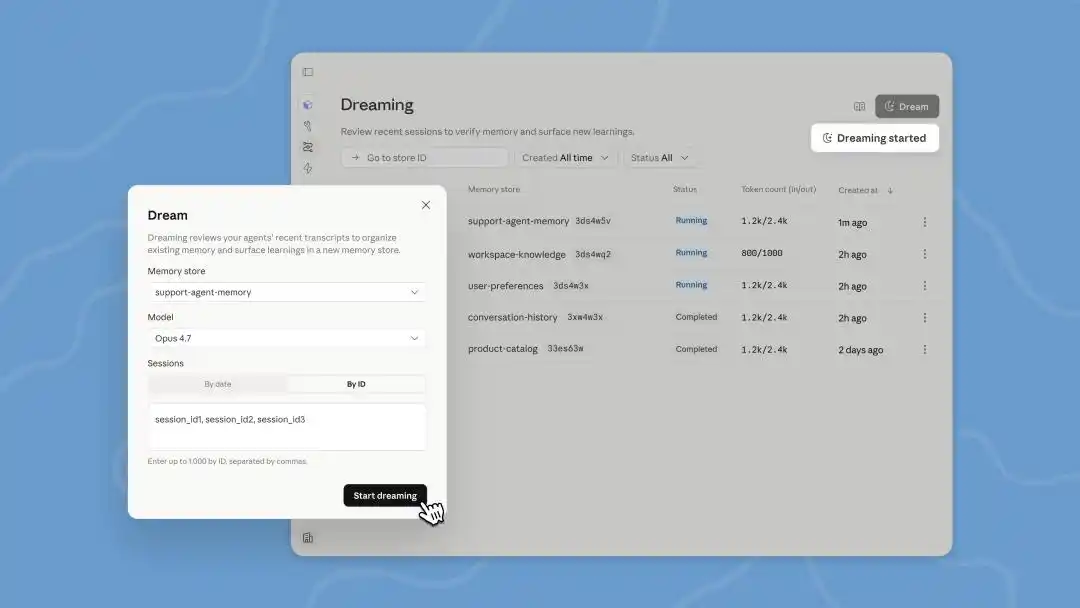

Ontem, a Anthropic lançou uma série de novos recursos para a plataforma de construção de agentes Managed Agents na conferência de desenvolvedores em São Francisco: expansão de memória, saída de resultados, colaboração entre múltiplos agentes e o recurso “sonhar (Dreaming)”.

Segundo a própria Anthropic, "memória e sonho juntos formam um sistema de memória robusto e autossuficiente".

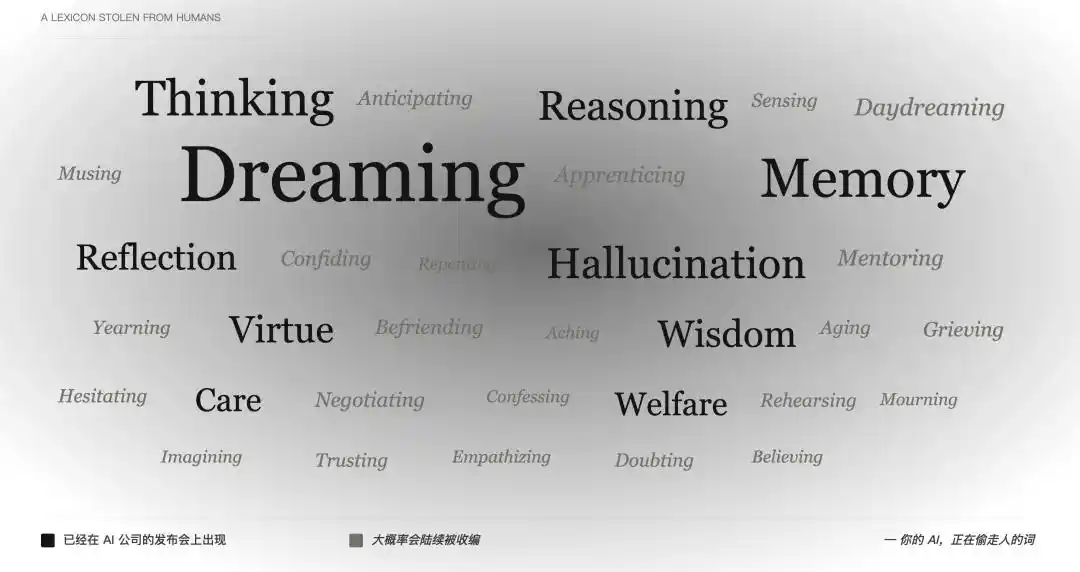

Outra vez sonho, outra vez memória — amigos que não prestam muita atenção ao campo da IA provavelmente ficarão com a cabeça cheia de perguntas: quando essas palavras humanas começaram a ser aplicadas tão naturalmente à IA?

Logo em 2024, quando a OpenAI lançou a série o1, “uma série de modelos de IA projetados para gastar mais tempo pensando antes de responder”, o termo “pensar” foi usado de forma extremamente natural, tão natural que ninguém parou para perguntar: como um programa que estatisticamente prevê o próximo token pode ser chamado de pensar?

Em seguida, reasoning (raciocínio), memory (memória), reflection (reflexão), Imagining (imaginação), trazendo um por um os processos que só os humanos fazem, para os lançamentos de produtos.

Capturas de tela do filme de sonhos "Paprika"

“Pensar” ainda pode ser interpretado como metáfora, “memória” também pode ser considerado uma extensão da terminologia técnica, mas “sonhar” vai longe demais. Filosofia, história e literatura estudaram por milhares de anos e ainda não esclareceram completamente — e empresas de IA afirmam diretamente: não apenas criamos máquinas que pensam, mas também máquinas que sonham.

O que é sonhar? Não existe nenhum termo técnico que possa descrever precisamente esse evento, além de sonhar?

Até sonhar com IA custa dinheiro

No vazamento de código do Claude Code, internautas descobriram que a Anthropic estava preparando uma funcionalidade chamada Auto Dreaming. Na época, todos se perguntavam: será que a IA também precisa dormir, como os seres humanos, e obter descanso suficiente para se tornar mais focada e mais inteligente?

Mas, desde que se compreenda o funcionamento atual dos AI Agents, percebe-se que o chamado “sonhar” é, na verdade, apenas um processamento em lote offline automatizado de logs.

O Agente de IA agora se destaca em realizar tarefas complexas com múltiplos passos. Por exemplo: “Ajude-me a pesquisar as últimas demonstrações financeiras dessas cinco concorrentes e organize-as em uma tabela”. Nesse processo, o Agente precisa navegar entre diferentes páginas, ler vários documentos, utilizar diversas ferramentas e, às vezes, enfrentar mecanismos anti-scraping, exigindo tentativas repetidas.

Ao final desta longa sequência de tarefas online complexas, o backend do agente deixará uma grande quantidade de logs de execução.

Imagem gerada por IA

A função "sonhar" da Anthropic permite que o Agente, durante períodos ociosos, reorganize esses registros históricos. Ele busca padrões, como descobrir que "cada vez que esse pop-up aparece, clicar no canto superior direito o fecha", otimizando assim o caminho de operação da próxima vez.

A "memória" é responsável por capturar o aprendizado durante o trabalho, enquanto o "sonho" refine essas memórias entre as conversas e as compartilha entre diferentes Agentes.

Em outras palavras, é um mecanismo de aprendizado por reforço e autocorreção baseado em dados históricos.

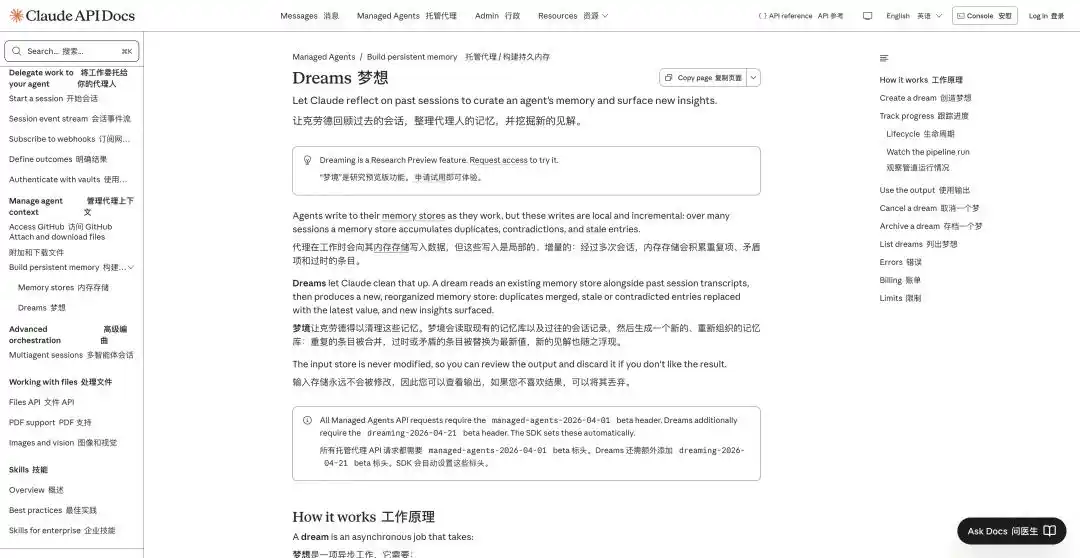

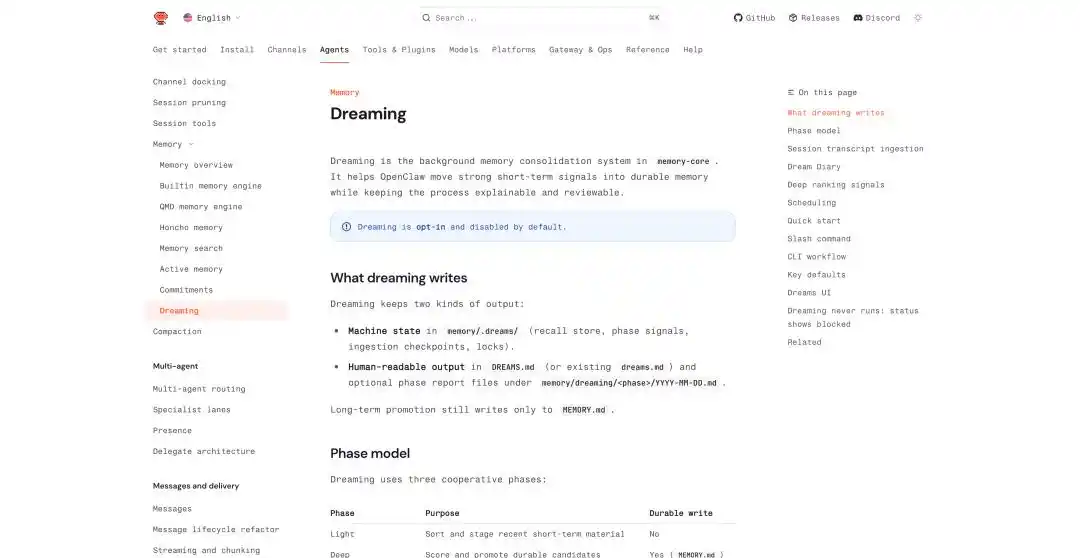

Introdução ao Dream: https://platform.claude.com/docs/en/managed-agents/dreams

Nesta conferência de desenvolvedores, atualizamos os Dreams nos Managed Agents, uma tarefa de processamento em segundo plano que precisamos acionar manualmente. O Claude pode ler até 100 sessões de histórico de conversa de uma vez e gerar uma nova memória, que podemos revisar antes de decidir se a utilizamos.

O AutoDream, que já foi lançado silenciosamente no Claude Code anteriormente, verifica em segundo plano após cada rodada de conversa com o Agente se "é hora de sonhar", por padrão a cada 24 horas.

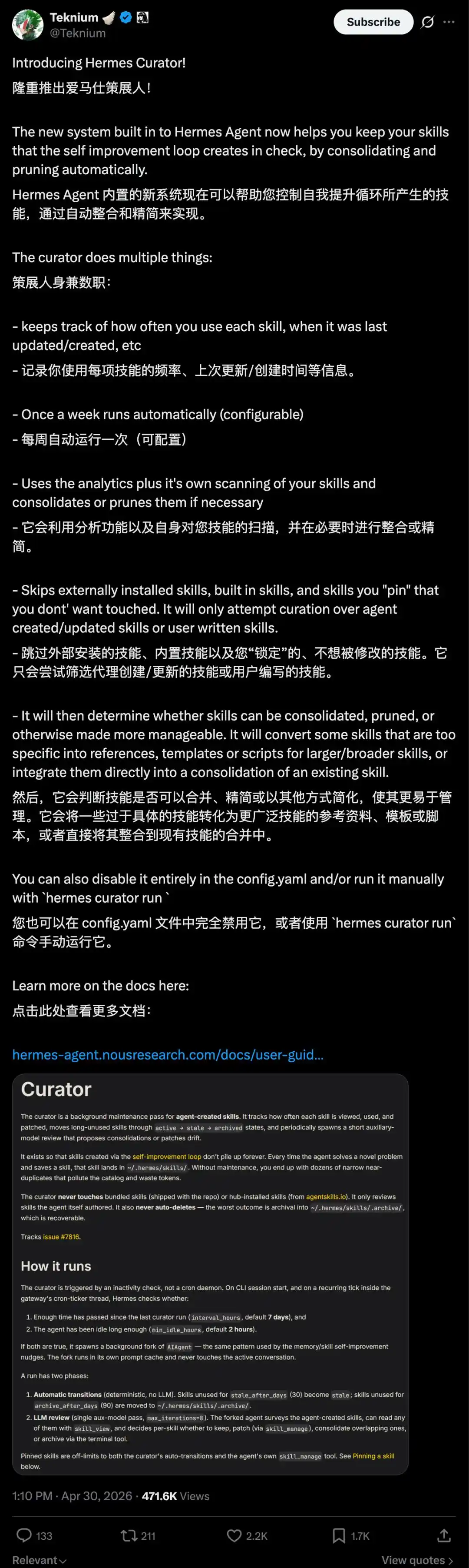

O Hermes Agent também possui uma função semelhante a sonhar. O Hermes Agent é focado em autoaprendizado e evolução, suportando não apenas a总结 automática de experiências de tarefas passadas, armazenando-as em arquivos de memória.

Uma das funcionalidades chamada Curator também pode organizar automaticamente esses guias de operações em Skill.

Essas Skill serão avaliadas, as duplicatas serão mescladas, as que não forem usadas por muito tempo serão arquivadas automaticamente e ainda possuem ciclos de vida como active, stale e archived. Também podemos fixar as Skill importantes para evitar que o sistema as exclua automaticamente.

OpenClaw também adicionou mecanismos relacionados nas últimas atualizações, como memória persistente entre conversas, agendamento de tarefas programadas, execução isolada de sub-Agents e a função direta de sonhar chamada Dreaming.

O sonho do OpenClaw: https://docs.openclaw.ai/concepts/dreaming

No mecanismo de sonho da OpenClaw, ele resume a jornada dos sonhos em três fases: light, REM e deep. As duas primeiras são responsáveis por organizar, refletir e归纳 temas, enquanto a fase deep é a que realmente grava o conteúdo na memória de longo prazo MEMORY.md.

A consolidação na fase de sono profundo será determinada por seis sinais ponderados se deve ou não ser gravada na memória de longo prazo. Esses seis sinais incluem frequência, relevância, diversidade de consultas, atualidade, repetição entre dias e riqueza conceitual.

Imagem gerada por IA

Gravar na memória de longo prazo gerará dois arquivos: um arquivo de estado voltado para máquinas, armazenado em memory/.dreams/; e um registro legível para usuários, gravado no DREAMS.md e em relatórios gerados por estágio.

Além disso, o Dreaming pode ser executado automaticamente em horários agendados, executando automaticamente todo o processo uma vez por dia, às 3h da manhã, na seguinte ordem: light → REM → deep.

Além da saída dos sonhos, o OpenClaw mantém um documento chamado Dream Diary, no qual o sistema gera automaticamente um "diário dos sonhos" que registra o processo de organização de memórias de forma narrativa, enfatizando explicabilidade e revisabilidade, em vez de um banco de dados opaco.

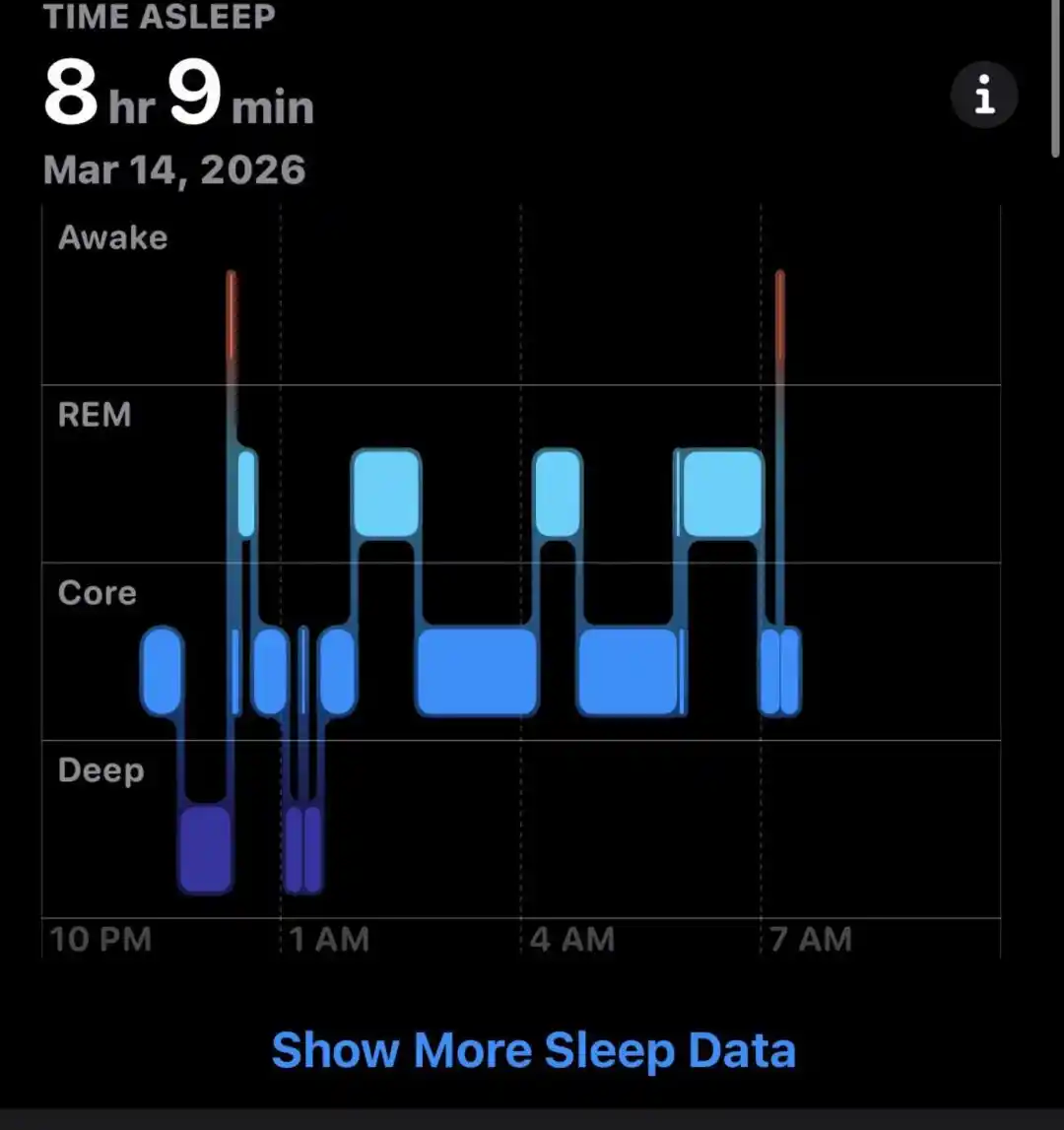

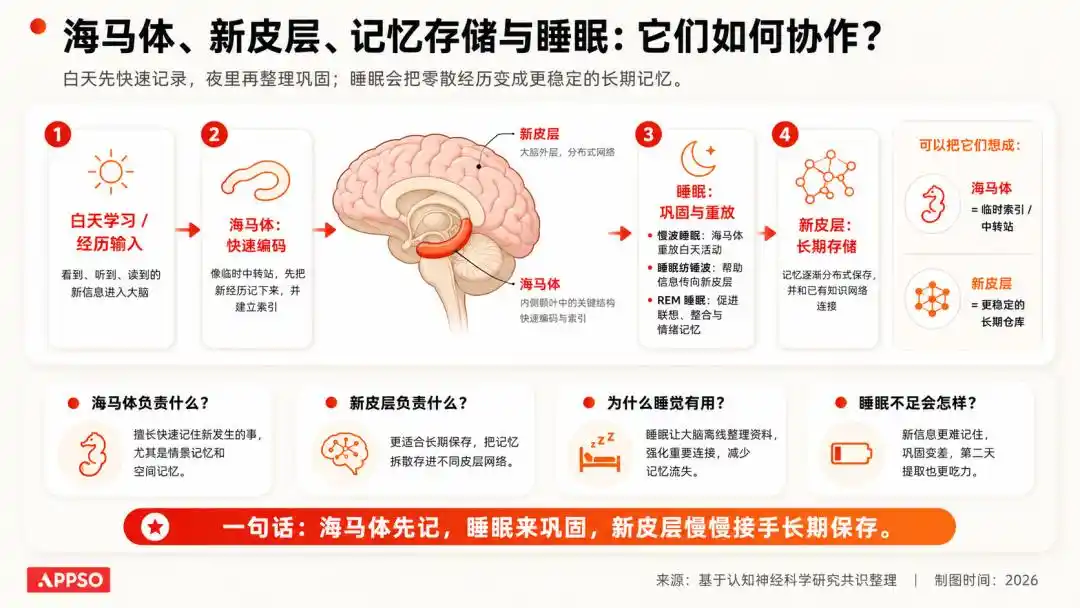

Na neurociência, existe uma compreensão muito clássica: as informações adquiridas pelos seres humanos durante o dia entram primeiro em um sistema de armazenamento temporário; durante o sono, o cérebro reprocessa, consolida e limpa essas informações, mantendo o que é importante e descartando o que não tem significado.

Imagem gerada por IA

Não nos lembramos da cor de cada carro no caminho para o trabalho ontem, mas nos lembramos de como chegar à empresa.

Esses sonhos, parecem realmente iguais aos sonhos que temos como humanos; se precisarmos encontrar alguma diferença, provavelmente é que, quando o Claude sonha, ainda está consumindo nossos Tokens.

Mas nem Anthropic nem OpenClaw escolheram chamá-lo de "otimização baseada em sessão" ou "ajuste pós-tarefa", nomes mais voltados para a engenharia.

After all, when those complex names are directly turned into "dreaming," what we feel is no longer just software functionality, but rather a "digital life with inner activity."

A memória da IA é contexto trivial.

Como foi mencionado "sonhar", não se pode deixar de mencionar sua condição prévia: a memória (Memory).

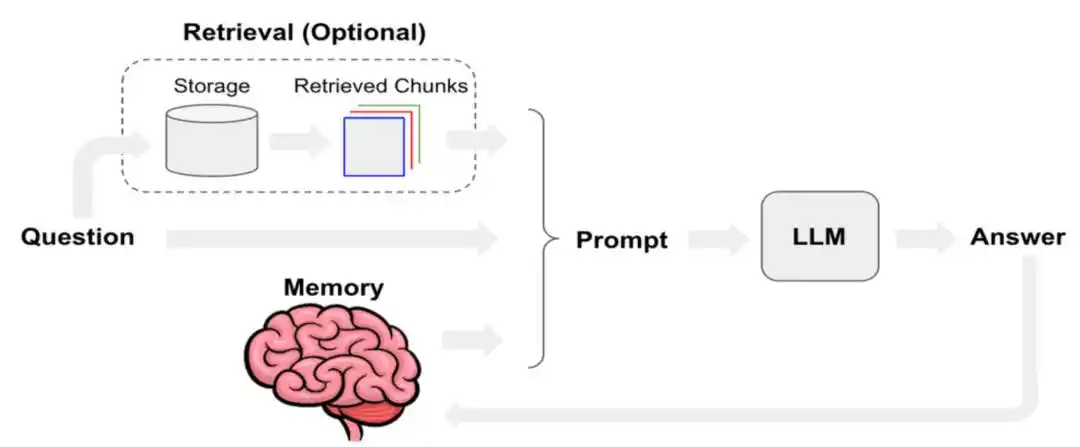

Nos últimos tempos, a palavra mais popular no mundo da IA passou de prompt engineering para context engineering, skill engineering e harness engineering, mas, independentemente das mudanças, o context engineering ainda é o mais valioso atualmente.

As camadas que se sobrepõem — avisos do sistema, entrada do usuário, conversas curtas, memória de longo prazo, documentos recuperados, saídas de chamadas de ferramentas e habilidades, e o estado atual do usuário — constituem o “contexto” que o agente realmente utiliza.

Fazer com que o agente consiga lembrar mais e registrar conteúdo mais útil tem sido um desafio por um longo período de tempo.

Manus publicou um blog técnico no ano passado, detalhando como a Manus otimiza a engenharia de contexto. O artigo menciona definir a taxa de acerto do cache KV como um dos principais indicadores únicos para agentes de IA em ambientes de produção. Ao mesmo tempo, no nível de chamada de ferramentas, prioriza-se o "ocultamento" em vez da "remoção"; além de utilizar o sistema de arquivos como contexto final.

Para entender o chamado KV Cache (cache de chave-valor), podemos imaginar um modelo grande como um paciente extremamente obcecado por ordem que só consegue ler uma palavra de cada vez.

Quando processa uma frase, ele calcula um vetor Key (chave) e um vetor Value (valor) para cada token gerado. Para evitar recalcular tudo do zero a cada vez, ele armazena esses pares chave-valor (K, V), o que é chamado de KV Cache.

KV Cache (cache de chave-valor) é uma técnica de aceleração subjacente usada por modelos grandes ao gerar texto, que troca espaço por tempo. O cache permite que o modelo, ao prever a próxima palavra, não precise recalcular todas as palavras anteriores. Imagem gerada por IA.

Enquanto a conversa continuar, o KV Cache será constantemente armazenado. Em geral, ao lidar com modelos grandes que suportam contextos de 128k, um modelo com 70 bilhões de parâmetros consumindo um contexto completo de 128k pode consumir apenas o KV Cache até 64 GB de memória VRAM.

É por isso que a janela de contexto da maioria dos modelos atualmente é de no máximo milhões.

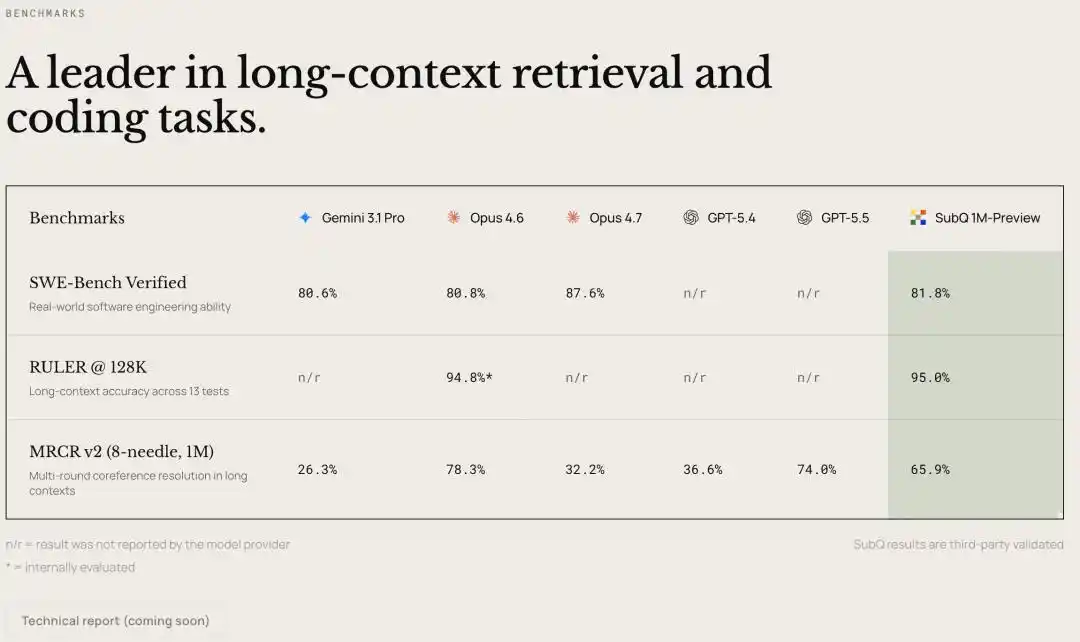

Ontem, a nova empresa Subquadratic, que recebeu um financiamento semente de 29 milhões de dólares, lançou o novo modelo SubQ no X, destacando contexto mais longo.

SubQ afirma suportar uma janela de contexto de até 12 milhões de tokens, a maior janela de contexto atualmente entre todos os grandes modelos.

Embora ainda não haja um artigo técnico ou documentação do modelo, o vídeo de apresentação menciona que a linha central da tecnologia do SubQ consiste em migrar da "atenção densa" tradicional do Transformer para uma arquitetura de "subquadrática / linear" com atenção esparsa. A nova arquitetura tem o potencial de resolver o problema do custo computacional que explode à medida que o contexto se torna mais longo.

Os resultados do teste também são bastante agressivos: com 1 milhão de tokens, a velocidade aumenta mais de 50 vezes e o custo reduz mais de 50 vezes; com 12 milhões de tokens, a demanda por poder de processamento pode ser reduzida em quase 1000 vezes em comparação com modelos de ponta.

No benchmark de contexto longo RULER 128K, a Subquadratic afirma que o SubQ atinge 95% de precisão com um custo de 8 dólares, em comparação com os cerca de 2.600 dólares da Claude Opus, representando uma redução de custo de aproximadamente 300 vezes.

Ou aumente a janela de contexto, ou faça o modelo aprender a sonhar, descartando coisas por conta própria.

É por isso que produtos de agentes como a Anthropic agora precisam lançar o Dreaming. Sob janelas de contexto limitadas, uma IA mais inteligente não pode depender apenas de inserir mais conteúdo; precisa agir com foco.

Admitir que máquinas são apenas máquinas é mais difícil do que se imagina

Ao compreender os mecanismos de sonho e memória da IA, talvez possamos entender sua relação com as atividades humanas.

Mas juntar todas essas palavras criadas pelas empresas de IA para usar em máquinas — o thinking (pensamento) da OpenAI, a memory (memória) e a hallucination (alucinação) comuns da indústria, o dreaming (sonhar) desta vez da Anthropic, e as virtudes e sabedoria do constitution (constituição) da Anthropic.

Podemos ver que as empresas de IA não estão apenas vendendo produtos; estão reassumindo a propriedade dos termos dentro do conceito de "ser humano". Cada vez que apropriam-se de uma palavra, a fronteira entre máquina e ser humano se torna um pouco mais nebulosa.

A linguagem molda as expectativas, as expectativas moldam a tolerância, e a tolerância determina quanto estamos dispostos a entregar a ela. É uma cadeia longa, mas o ponto de partida são as palavras inofensivas do lançamento.

Uma camada mais sutil de impacto é a atribuição de responsabilidade. Quando ferramentas são descritas como entidades com “pensamento”, “memória” e “valores”, ao apresentarem problemas, naturalmente as tratamos como “agentes independentes” a serem responsabilizadas — é esse AI que precisa ser “educado”, “debugado” e “calibrado”.

A verdadeira pergunta que deveria ser feita é à empresa que implantou esse programa em nosso fluxo de trabalho e à equipe de produto que escreveu a palavra “dreaming”. Trocar a palavra muda quem está sentado no banco dos réus.

E enquanto observamos uma máquina que "pensa", "lembrará" e agora também "sonha", começamos a acreditar inconscientemente que há algo lá dentro. Porque admitir que se trata apenas de uma máquina faz desaparecer a experiência de "estar conversando com um ser capaz de pensar", retornando à relação fria e mecânica de uma ferramenta.

Introdução à função White Day Dream | Imagem gerada por IA

Já pensei nisso: Dreaming, sonhar, lida com conteúdo passado; em seguida, as empresas de IA lançarão o Daydreaming, o sonho acordado, para simular o futuro.

O conceito é que sonhar acordado ou se distrair permite que o Agente, em estado ativo, utilize uma pequena parte da capacidade ociosa, combinada com o projeto atual, para realizar simultaneamente geração exploratória e preparar tarefas futuras possíveis.

Este artigo é do número oficial do WeChat "APPSO", autor: APPSO, descobridor de produtos do amanhã.