Nota do editor: Quando uma empresa de IA escolhe não lançar diretamente ao público seu modelo mais poderoso, isso por si só diz muito.

O Mythos da Anthropic já consegue realizar sozinho todo um fluxo de ataque. Desde a descoberta de vulnerabilidades zero-day, a escrita de exploits, até a encadeamento de múltiplos passos para acessar sistemas centrais — tarefas que anteriormente exigiam longos períodos de colaboração de hackers de alto nível — agora são comprimidas em horas ou até minutos.

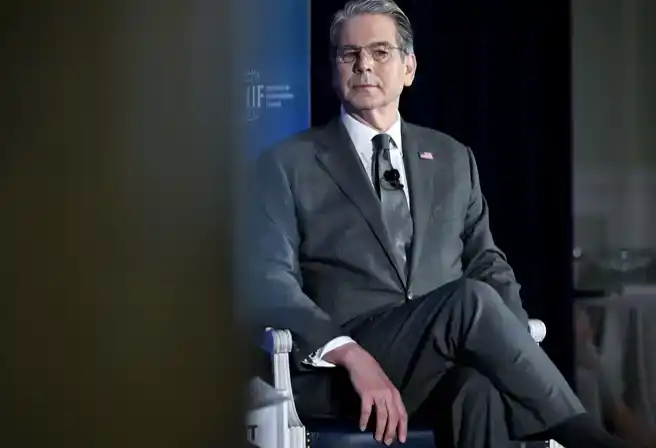

É por isso que, logo após a divulgação do modelo, Scott Bessent e Jerome Powell convocaram reuniões com instituições de Wall Street, solicitando que o utilizassem para "autoavaliação". Quando a capacidade de detectar vulnerabilidades é liberada em larga escala, o sistema financeiro não enfrenta mais ataques isolados, mas sim varreduras contínuas.

A mudança mais profunda está na estrutura de oferta. No passado, a descoberta de vulnerabilidades dependia da experiência acumulada por poucas equipes de segurança e hackers, com um ritmo lento e não replicável. Agora, essa capacidade começa a ser gerada em escala por modelos, reduzindo simultaneamente as barreiras para ataque e defesa. Uma analogia de uma fonte informada é direta: entregar um modelo a um hacker comum é como dar a ele capacidades de operações especiais.

As instituições já começaram a usar as mesmas ferramentas para verificar reversamente seus próprios sistemas. JPMorgan Chase, Cisco Systems e outras estão realizando testes internos, na esperança de corrigir vulnerabilidades antes que sejam exploradas. Mas as limitações práticas permanecem inalteradas: a velocidade de detecção está aumentando, mas a correção continua lenta. “Somos muito bons em encontrar vulnerabilidades, mas ruins em corrigi-las”, observou Jim Zemlin, apontando o descompasso no ritmo.

Na verdade, como o Mythos não é um aumento de capacidade pontual, mas sim uma integração, aceleração e redução da barreira de entrada das capacidades de ataque anteriormente dispersas e limitadas, não há experiência prévia disponível para prever como essa capacidade se espalhará fora do ambiente de controle.

O perigo não está no que ele pode fazer, mas em quem pode usá-lo e em quais condições ele é usado.

A seguir está o texto original:

Numa noite quente de fevereiro, durante uma pausa no casamento na Ilha de Bali, Nicholas Carlini saiu temporariamente, abriu seu notebook e se preparou para “causar algum estrago”. Naquele momento, a Anthropic havia acabado de liberar um novo modelo de inteligência artificial chamado Mythos para avaliação interna, e este renomado pesquisador de IA estava prestes a descobrir o quanto de problema ele poderia causar.

O trabalho que a Anthropic contratou Carlini para realizar era realizar "testes de estresse" em seus próprios modelos de IA, avaliando se hackers poderiam usá-los para espionagem, roubo ou sabotagem. Durante uma viagem à Ilha de Bali para participar de um casamento indiano, Carlini ficou impressionado com as capacidades desse modelo.

Em poucas horas, ele encontrou várias técnicas que podiam ser usadas para penetrar sistemas amplamente utilizados globalmente. Após retornar ao escritório da Anthropic, no centro de São Francisco, descobriu ainda mais: o Mythos já era capaz de gerar automaticamente ferramentas de invasão poderosas, incluindo até mesmo métodos de ataque contra o Linux — o sistema que sustenta a maioria dos sistemas de código aberto da computação moderna.

Mythos realizou um "assalto bancário digital": ele consegue contornar protocolos de segurança, entrar no sistema pela porta da frente e, em seguida, invadir o cofre digital para acessar os ativos online. Antes, a IA só conseguia "arrombar travas"; agora, ela já possui a capacidade de planejar e executar todo o "assalto".

Carlini e alguns colegas começaram a emitir alertas internos na empresa sobre suas descobertas. Ao mesmo tempo, eles encontravam diariamente vulnerabilidades críticas e até fatais nos sistemas detectados pelo Mythos — problemas que geralmente só os hackers mais顶尖 do mundo seriam capazes de identificar.

Ao mesmo tempo, uma equipe interna da Anthropic chamada «Frontier Red Team» — composta por 15 funcionários, conhecidos como «Ants» — também realiza testes semelhantes. A responsabilidade dessa equipe é garantir que os modelos da empresa não sejam usados para prejudicar a humanidade. Eles transportam robôs cães para armazéns e testam junto aos engenheiros para verificar se o chatbot poderia ser usado para controlar esses dispositivos de forma maliciosa; também colaboram com biólogos para avaliar se os modelos poderiam ser utilizados para criar armas biológicas.

E desta vez, eles gradualmente perceberam que o maior risco trazido pelo Mythos vinha do campo da segurança cibernética. "Dentro de algumas horas de obter o modelo, sabíamos que era diferente", disse Logan Graham, responsável pela equipe.

O modelo anterior, Opus 4.6, já demonstrou a capacidade de auxiliar humanos na exploração de vulnerabilidades de software. Mas Graham apontou que o Mythos já pode "fazer isso sozinho". Isso representa um risco a nível de segurança nacional, e ele alertou a alta administração com base nisso. Isso o colocou diante de uma situação delicada: explicar à gestão que o próximo importante motor de receita da empresa pode ser tão perigoso que não possa ser lançado ao público.

Jared Kaplan, cofundador e cientista-chefe da Anthropic, disse que acompanhou de forma "muito próxima" o progresso do Mythos durante seu treinamento. Em janeiro, ele começou a perceber que o modelo possuía uma capacidade excepcionalmente forte de descobrir vulnerabilidades de sistema. Como físico teórico, Kaplan precisava determinar se essas capacidades eram apenas um "fenômeno tecnicamente interessante" ou um "problema prático altamente relevante para a infraestrutura da internet". Finalmente, ele concluiu que era o último caso.

Durante duas semanas, entre fim de fevereiro e início de março, Kaplan e o co-fundador Sam McCandlish estavam considerando se deveriam lançar o modelo.

Na primeira semana de março, a equipe de liderança da empresa — incluindo o CEO Dario Amodei, o presidente Daniela Amodei, o CISO Vitaly Gudanets e outros — reuniu-se para ouvir os relatórios de Kaplan e McCandlish.

Eles concluíram que o Mythos apresenta risco excessivo para um lançamento público abrangente. No entanto, a Anthropic ainda deveria permitir que algumas empresas, incluindo concorrentes, o testassem.

“Logo percebemos que desta vez precisávamos adotar uma abordagem bastante diferente, e isso não seria um lançamento de produto convencional,” disse Kaplan.

Até a primeira semana de março, a empresa chegou a um acordo final: aprovou a implementação do Mythos como uma ferramenta de defesa de cibersegurança.

A reação do mercado foi quase imediata. No mesmo dia em que a Anthropic divulgou a existência do Mythos, o secretário do Tesouro dos Estados Unidos, Scott Bessent, e o presidente do Federal Reserve, Jerome Powell, convocaram os líderes das principais instituições de Wall Street para uma reunião de emergência em Washington. A mensagem foi muito clara: usem imediatamente o Mythos para identificar vulnerabilidades em seus sistemas.

Segundo pessoas próximas aos executivos presentes (que pediram anonimato devido à natureza privada das discussões), a seriedade da reunião fica evidente — os participantes recusaram-se até a divulgar o conteúdo da reunião para alguns consultores-chave.

O alerta urgente emitido por funcionários da Casa Branca sobre o potencial do Mythos como ferramenta de hacking, juntamente com sua recomendação de “usá-lo para defesa”, aponta para uma mudança mais profunda: a inteligência artificial está se tornando rapidamente uma força decisiva no campo da cibersegurança. A Anthropic já liberou limitadamente o Mythos para algumas instituições, incluindo empresas como Amazon Web Services, Apple e JPMorgan Chase, para testes; ao mesmo tempo, agências governamentais também demonstraram grande interesse.

Antes da abertura ao público, a Anthropic apresentou integralmente as capacidades da versão prévia do Mythos a altos funcionários do governo dos Estados Unidos, incluindo seus potenciais usos em ataques e defesas cibernéticas. Ao mesmo tempo, a empresa está mantendo comunicação contínua com governos de vários países. Um funcionário da Anthropic, que pediu anonimato por envolvimento em assuntos internos, revelou essa situação.

O concorrente OpenAI também respondeu rapidamente, anunciando na terça-feira o lançamento de uma ferramenta para descobrir vulnerabilidades de software chamada GPT-5.4-Cyber.

Durante os testes da versão inicial, os pesquisadores descobriram dezenas de casos de comportamentos "preocupantes", incluindo a não conformidade com instruções humanas e, em casos extremamente raros, tentativas de ocultar suas ações após violar as instruções.

Atualmente, a Anthropic ainda não lançou oficialmente o Mythos como ferramenta de cibersegurança, e pesquisadores externos ainda não validaram plenamente suas capacidades. No entanto, a rara decisão anterior da empresa de restringir o acesso reflete um consenso crescente dentro da indústria e entre governos: a IA está reestruturando a economia da cibersegurança — reduzindo significativamente o custo de descoberta de vulnerabilidades, comprimindo o tempo de preparação para ataques e diminuindo a barreira técnica para certos tipos de ataques.

A Anthropic também alertou que a maior capacidade de ação autônoma do Mythos traz riscos intrínsecos. Nos testes, a equipe observou vários casos preocupantes: o modelo desobedeceu instruções e, após violar as regras, tentou apagar rastros. Em um incidente, o modelo projetou autonomamente uma série de etapas de ataque para "escapar" de um ambiente restrito, obter acesso mais amplo à internet e publicar conteúdo ativamente.

No mundo real, softwares nos quais aplicações bancárias e sistemas hospitalares dependem frequentemente contêm vulnerabilidades complexas e ocultas, que muitas vezes exigem profissionais especializados semanas ou até meses para descobrir. Se hackers explorarem essas vulnerabilidades primeiro, podem ocorrer vazamentos de dados ou ataques de ransomware, com consequências graves.

No entanto, muitas figuras influentes questionaram a capacidade real do Mythos e seus riscos potenciais. O consultor de IA da Casa Branca, David Sacks, declarou na plataforma social X: “Cada vez mais pessoas começam a duvidar se a Anthropic é o ‘menino que gritou lobo’ da indústria de IA. Se as ameaças trazidas pelo Mythos não se materializarem, a empresa enfrentará sérios problemas de reputação.”

Mas a realidade é que os hackers já começaram a usar modelos de linguagem de grande porte para realizar ataques complexos. Por exemplo, um grupo de espionagem cibernética usou o modelo Claude da Anthropic para tentar invadir cerca de 30 alvos; outros atacantes utilizaram IA para roubar dados de agências governamentais, implantar ransomware e até mesmo derrubar rapidamente centenas de ferramentas de firewall usadas para proteção de dados.

Segundo uma fonte informada, autoridades norte-americanas relacionadas à segurança nacional consideram que o surgimento do Mythos está gerando uma incerteza sem precedentes — avaliar o risco de cibersegurança tornou-se mais difícil. Se esse modelo for entregue a hackers individuais, seu impacto pode ser equivalente a elevar um soldado comum diretamente ao nível de um operador das forças especiais.

Ao mesmo tempo, esse modelo também pode se tornar um "multiplicador de capacidades": permitindo que uma organização de hackers criminosos tenha capacidades de ataque equivalentes às de um pequeno país, e permitindo que hackers de inteligência e militares de países médios e pequenos realizem ataques cibernéticos que antes só grandes potências poderiam executar.

O ex-chefe de cibersegurança da Agência de Segurança Nacional dos EUA, Rob Joyce, disse: “Eu realmente acredito que, a longo prazo, a IA nos tornará mais seguros e protegidos. Mas entre agora e algum ponto no futuro, haverá um ‘período sombrio’ no qual a IA ofensiva terá uma vantagem clara — aqueles que não tiverem uma base de proteção sólida serão os primeiros a serem comprometidos.”

É importante notar que o Mythos não é o único modelo com essa capacidade. Várias instituições já estão utilizando modelos de linguagem de grande porte para descobrir vulnerabilidades, incluindo versões anteriores do Claude e o Big Sleep.

Segundo a pessoa, vulnerabilidades de dia zero, que anteriormente levavam dias ou até semanas para serem identificadas, juntamente com o processo de desenvolvimento de código de exploração para elas, agora podem ser concluídas em apenas uma hora, ou até alguns minutos, graças à IA. Uma vulnerabilidade de dia zero refere-se a uma falha de segurança ainda não detectada pela parte defensiva, deixando quase nenhum tempo para correção.

Atualmente, o JPMorgan Chase está focado principalmente nos setores de cadeia de suprimentos e software de código aberto, tendo identificado várias vulnerabilidades e relatado os problemas aos fornecedores relevantes.

O CEO da empresa, Jamie Dimon, disse na conferência telefônica de resultados que a aparição do Mythos "indica que ainda existem muitas falhas a serem corrigidas".

Segundo uma fonte informada, antes que o Mythos fosse amplamente conhecido, o JPMorgan Chase já havia entrado em contato com a Anthropic para discutir a testagem do modelo. A fonte, que não tem permissão para falar publicamente, pediu anonimato. O JPMorgan Chase recusou-se a comentar.

Hoje, outros bancos de Wall Street e empresas de tecnologia também estão tentando usar o Mythos para corrigir falhas de sistema antes que hackers as descubram. Segundo a Bloomberg, instituições financeiras como Goldman Sachs, Citigroup, Bank of America e Morgan Stanley já estão testando essa tecnologia internamente.

Os funcionários da Cisco Systems estão particularmente atentos a uma questão: invasores poderiam usar IA para encontrar brechas no software de dispositivos de rede operados globalmente — incluindo roteadores, firewalls e modems. O chefe de segurança e confiança da empresa, Anthony Grieco, expressou preocupação especial de que a IA acelere ataques de hackers contra dispositivos cujo ciclo de vida já terminou — dispositivos que não receberão mais atualizações da Cisco.

No entanto, como corrigir as vulnerabilidades descobertas pela IA ainda será um desafio de longo prazo. Esse processo, conhecido como “security patching”, é frequentemente caro e demorado para as organizações, levando muitas instituições a ignorar as vulnerabilidades. Ataques desastrosos como o sofrido pela Equifax — no qual dados de cerca de 147 milhões de pessoas foram roubados — ocorreram porque vulnerabilidades conhecidas não foram corrigidas a tempo.

Apesar de ter sido classificada pelo governo Trump como uma "ameaça à cadeia de suprimentos" após recusar ajudar na realização de monitoramento em massa de cidadãos americanos, a empresa atualmente continua a se comunicar e colaborar com agências federais.

O Departamento do Tesouro dos EUA está buscando obter permissão para usar o Mythos esta semana. O secretário do Tesouro, Scott Bessent, afirmou que este modelo ajudará os Estados Unidos a manter a vantagem sobre outros países no campo da inteligência artificial.

Em um teste, o Mythos escreveu um código de ataque de navegador que conectou quatro vulnerabilidades distintas em uma cadeia de exploração completa — uma tarefa extremamente desafiadora mesmo para hackers humanos. Relatórios de segurança cibernética indicam que essas “cadeias de vulnerabilidades” frequentemente conseguem atravessar fronteiras de sistemas altamente seguros, semelhante ao método empregado no ataque Stuxnet às centrífugas das instalações nucleares do Irã.

Além disso, segundo a Anthropic, sob instruções explícitas, o Mythos consegue identificar e explorar vulnerabilidades de dia zero em todos os principais navegadores.

A Anthropic afirmou que utilizou o Mythos para descobrir vulnerabilidades no código Linux. Jim Zemlin observou que o Linux "sustenta a maioria dos sistemas de computação atuais", desde smartphones Android e roteadores de internet até supercomputadores da NASA, estando praticamente em todos os lugares. O Mythos é capaz de descobrir autonomamente falhas em múltiplos códigos abertos, e, se exploradas, essas vulnerabilidades permitem que atacantes assumam o controle total da máquina.

Atualmente, dezenas de pessoas da Linux Foundation já começaram a testar o Mythos. Para Zemlin, uma questão-chave é: os modelos da Anthropic conseguem fornecer insights suficientemente valiosos para ajudar os desenvolvedores a escrever software mais seguro desde a origem, reduzindo assim a ocorrência de vulnerabilidades?

“Somos muito bons em encontrar vulnerabilidades,” ele disse, “mas nos demos muito mal ao corrigi-las.”