Essa visão não surgiu do nada. Ele analisou uma série de benchmarks públicos e percebeu que a IA está progredindo rapidamente em tarefas relacionadas ao desenvolvimento de IA.

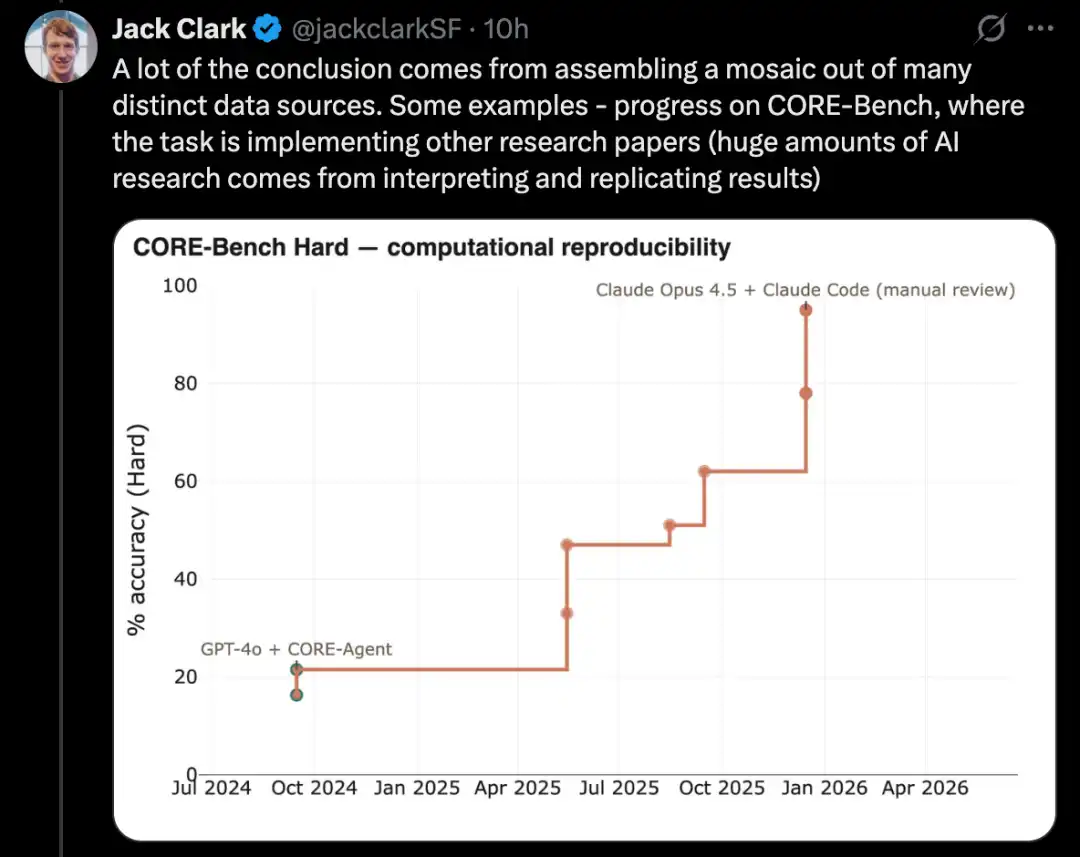

Por exemplo, o CORE-Bench avalia a capacidade da IA de implementar artigos de pesquisa de outras pessoas, o que é uma parte crucial da pesquisa em IA.

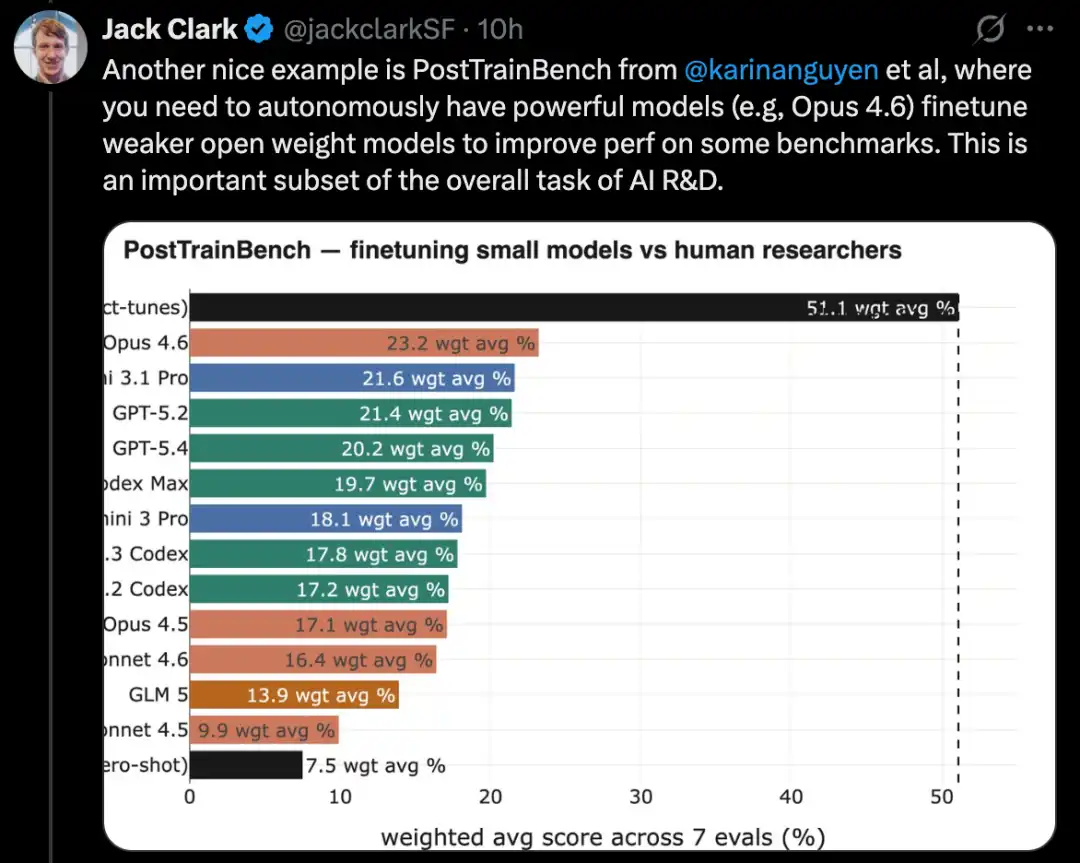

PostTrainBench testa se modelos poderosos podem fine-tunar automaticamente modelos open-source mais fracos para melhorar o desempenho, o que é exatamente um subconjunto chave das tarefas de pesquisa em IA.

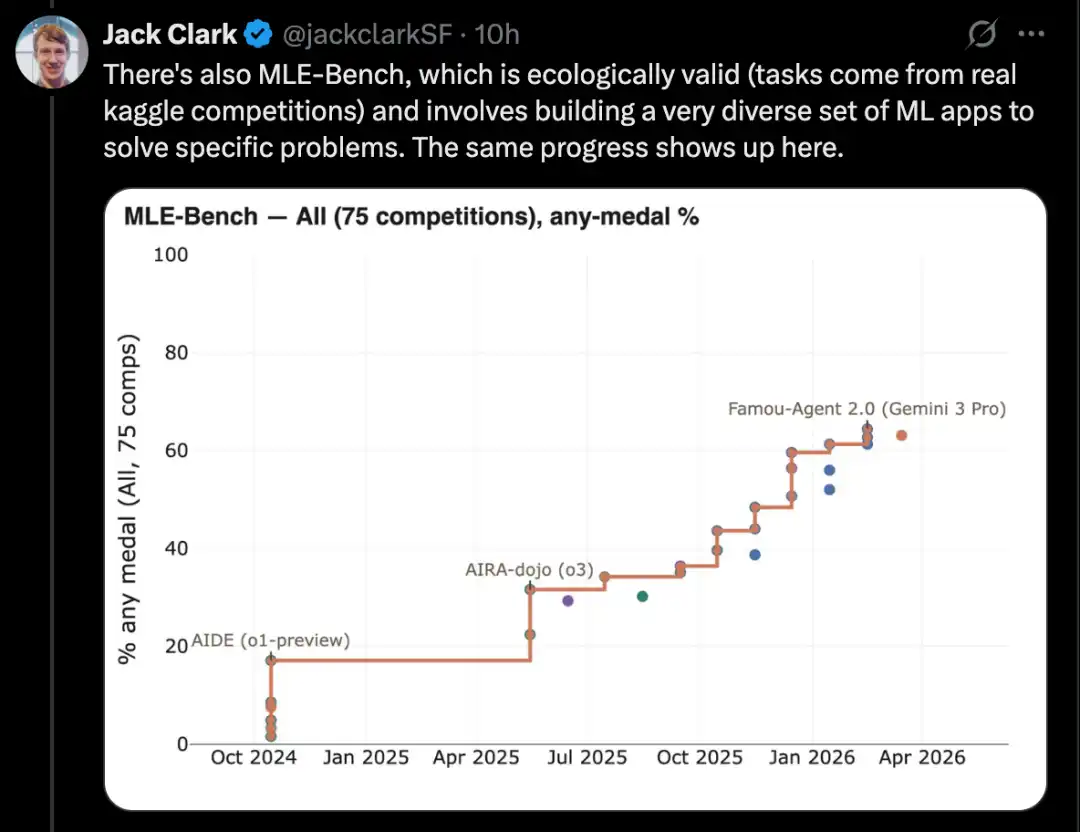

MLE-Bench baseia-se em tarefas reais de competições do Kaggle, exigindo a construção de aplicações de machine learning diversificadas para resolver problemas específicos. Além disso, benchmarks de codificação bem conhecidos, como o SWE-Bench, também demonstram progressos semelhantes.

Jack Clark descreveu esse fenômeno como uma tendência ascendente e para a direita de natureza "fractal", na qual progressos significativos podem ser observados em diferentes resoluções e escalas. Ele acredita que a IA está se aproximando gradualmente da capacidade de automação end-to-end em desenvolvimento; uma vez alcançada, a IA será capaz de construir autonomamente seus próprios sistemas sucessores, iniciando um ciclo de autoiteração.

Após esse comentário, houve muita discussão nas redes sociais.

Alguns o veem como o primeiro passo crucial rumo à ASI e ao ponto de singularidade, podendo transformar radicalmente o ritmo do desenvolvimento tecnológico.

No entanto, também existem vozes diferentes.

O professor de ciência da computação da Universidade de Washington, Pedro Domingos, apontou que sistemas de IA já tinham a capacidade de "construir a si mesmos" desde a invenção da linguagem LISP na década de 1950; a verdadeira questão é se é possível obter retornos incrementais, e até agora não há evidências claras que sustentem isso.

Alguns usuários questionaram se a probabilidade aumentou repentinamente em 30% de 2027 a 2028, o que sugere que a capacidade da IA poderá experimentar uma grande ruptura repentina por volta do final de 2027. Qual marco ou evento específico faria com que a probabilidade de autoaperfeiçoamento recursivo da IA aumentasse significativamente em um curto período de tempo?

Outros internautas também mencionaram que Jack Clark é o recém-nomeado responsável de relações públicas da Anthropic, o que faz parte de sua nova estratégia: não somos alarmistas; há muitos artigos que corroboram as advertências que sempre lhes fizemos.

Jack Clark escreveu um artigo detalhado sobre isso na edição 455 da newsletter Import AI.

Agora, vamos analisar completamente este artigo.

O sistema de IA está prestes a começar a se autoconstruir. O que isso significa?

Clark afirma que escreveu este artigo porque, após analisar todas as informações publicamente disponíveis, foi forçado a formar um julgamento nada fácil: até o final de 2028, a probabilidade de surgimento de pesquisa de IA sem intervenção humana já é bastante alta, talvez acima de 60%.

A chamada pesquisa de IA sem intervenção humana refere-se a um sistema de IA suficientemente poderoso: capaz não apenas de auxiliar humanos na pesquisa, mas também de completar autonomamente processos cruciais de desenvolvimento e até construir seu próprio sistema de próxima geração.

Na visão de Clark, isso é claramente um grande acontecimento.

Ele admitiu que também tem dificuldade em compreender plenamente o significado disso.

Chama-se isso um julgamento relutante porque as implicações por trás dele são tão enormes que ele se sente incapaz de controlá-las. Clark também não tem certeza se a sociedade como um todo já está preparada para as mudanças profundas trazidas pela automação do desenvolvimento de IA.

Ele agora acredita que a humanidade pode estar vivendo em um ponto especial: a pesquisa de IA está prestes a ser automatizada de ponta a ponta. Se esse momento realmente ocorrer, a humanidade terá cruzado o Rubicão e entrado em um futuro quase imprevisível.

Clark afirma que o objetivo deste artigo é explicar por que ele acredita que o decolagem rumo à pesquisa de IA totalmente automatizada está acontecendo.

Ele discutirá algumas das consequências que essa tendência pode trazer, mas a maior parte do artigo se concentrará nas evidências que sustentam esse julgamento. Quanto às implicações mais profundas, Clark planeja continuar analisando ao longo da maior parte deste ano.

Do ponto de vista temporal, Clark não acredita que isso realmente ocorra em 2026. Mas ele acha que, nos próximos um ou dois anos, podemos ver um caso em que algum modelo treina seu próprio sucessor de ponta a ponta. Pelo menos em modelos não de ponta, é muito provável que surja uma prova de conceito; já para os modelos mais avançados, a dificuldade será maior, pois são extremamente caros e dependem de um trabalho intensivo de pesquisadores humanos.

O julgamento de Clark baseia-se principalmente em informações públicas: incluindo artigos no arXiv, bioRxiv e NBER, bem como produtos já implementados no mundo real por empresas de IA de ponta. Com base nessas informações, ele conclui que os diversos componentes necessários para a produção automatizada dos atuais sistemas de IA, especialmente os componentes de engenharia no desenvolvimento de IA, já estão basicamente disponíveis.

Se a tendência de scaling continuar, devemos começar a nos preparar para a possibilidade de que os modelos se tornem suficientemente criativos não apenas para melhorar automaticamente métodos conhecidos, mas também para substituir pesquisadores humanos na proposta de novas direções de pesquisa e ideias originais, impulsionando assim sozinhos o avanço da fronteira da IA.

Singularity Code: Evolution of Abilities Over Time

Sistemas de IA são implementados por meio de software, que é composto por código.

Os sistemas de IA já revolucionaram a forma como o código é produzido. Por trás disso, há duas tendências relacionadas: por um lado, os sistemas de IA estão se tornando cada vez mais habilidosos na escrita de código complexo do mundo real; por outro lado, também estão se tornando cada vez mais capazes de encadear várias tarefas de codificação lineares com quase nenhuma supervisão humana, como escrever código e, em seguida, testá-lo.

Dois exemplos típicos que refletem essa tendência são o SWE-Bench e o gráfico de horizontes temporais do METR.

Resolver problemas de engenharia de software do mundo real

SWE-Bench é um teste de programação amplamente utilizado para avaliar a capacidade de sistemas de IA resolverem issues reais do GitHub.

Quando o SWE-Bench foi lançado no final de 2023, o melhor modelo disponível era o Claude 2, com uma taxa de sucesso geral de apenas cerca de 2%. Já o Claude Mythos Preview alcançou 93,9%, praticamente atingindo o máximo desse benchmark.

Claro, todos os benchmarks têm algum ruído, então geralmente ocorre uma fase em que, após atingir uma pontuação elevada, os limites que você encontra não são mais da própria metodologia, mas sim das limitações do benchmark. Por exemplo, no conjunto de validação do ImageNet, cerca de 6% dos rótulos estão incorretos ou são ambíguos.

O SWE-Bench pode ser considerado um indicador confiável para medir a capacidade de programação geral e o impacto da IA na engenharia de software. Clark afirmou que a maioria das pessoas com quem ele entrou em contato em laboratórios de IA de ponta e em Silicon Valley agora quase totalmente escrevem código por meio de sistemas de IA, e cada vez mais pessoas estão começando a usar sistemas de IA para escrever testes e revisar código.

Em outras palavras, os sistemas de IA já são suficientemente avançados para automatizar um componente importante da pesquisa em IA e acelerar significativamente todos os pesquisadores e engenheiros humanos envolvidos na pesquisa em IA.

Medir a capacidade dos sistemas de IA de concluir tarefas de longa duração

METR criou um gráfico para medir a complexidade das tarefas que a IA pode realizar. A complexidade é calculada com base no número aproximado de horas que um humano qualificado levaria para concluir essas tarefas.

O indicador mais importante é o intervalo de tempo aproximado das tarefas em que o sistema de IA atinge 50% de confiabilidade.

Neste ponto, o progresso é incrível:

· Em 2022, as tarefas que o GPT-3.5 conseguia realizar eram aproximadamente equivalentes às que um humano levaria 30 segundos para concluir.

· Em 2023, o GPT-4 elevou esse tempo para 4 minutos.

· Em 2024, o1 aumentou esse tempo para 40 minutos.

· Em 2025, o GPT-5.2 High atingiu cerca de 6 horas.

· Até 2026, o Opus 4.6 já elevou esse tempo ainda mais, para cerca de 12 horas.

Ajeya Cotra, que trabalha na METR e acompanha há muito tempo as previsões de IA, acredita que não é uma expectativa irrazoável que, até o final de 2026, sistemas de IA consigam realizar tarefas que exigiriam 100 horas de trabalho humano.

O período durante o qual os sistemas de IA podem operar de forma independente aumentou significativamente, também em forte correlação com o surgimento de ferramentas de codificação agênticas. Ferramentas de codificação agênticas, por sua vez, consistem na productização de sistemas de IA capazes de realizar tarefas em nome dos humanos: elas podem agir em representação de pessoas e avançar tarefas de forma relativamente independente por longos períodos de tempo.

Isso também redireciona o foco para o próprio desenvolvimento de IA. Observando atentamente as tarefas diárias de muitos pesquisadores de IA, percebe-se que grande parte dessas atividades pode ser decomposta em tarefas de algumas horas, como limpeza de dados, leitura de dados, inicialização de experimentos, entre outras.

E esse tipo de trabalho agora cai dentro do intervalo de tempo que os sistemas modernos de IA conseguem cobrir.

Quanto mais habilidoso o sistema de IA, mais ele pode operar independentemente dos humanos e ajudar a automatizar parte do desenvolvimento de IA.

Os principais fatores para a atribuição de tarefas são dois:

· Primeiro, a sua confiança na capacidade do delegado;

· Em segundo lugar, você acredita que a outra pessoa pode concluir o trabalho de forma independente, conforme sua intenção, sem depender de sua supervisão contínua.

Quando os usuários observam a capacidade da IA em programação, percebem que os sistemas de IA não só estão se tornando cada vez mais habilidosos, mas também conseguem trabalhar de forma independente por períodos mais longos, sem necessidade de recalibração humana.

Isso também está em linha com o que está acontecendo ao nosso redor, pois engenheiros e pesquisadores estão atribuindo cada vez mais tarefas grandes aos sistemas de IA. À medida que as capacidades da IA continuam a melhorar, as tarefas delegadas à IA tornam-se cada vez mais complexas e importantes.

A IA está dominando as habilidades científicas fundamentais necessárias para o desenvolvimento de IA

Pense em como a pesquisa científica moderna é conduzida: grande parte do trabalho consiste primeiro em definir uma direção e identificar quais tipos de informações empíricas se deseja obter; depois, projetar e realizar experimentos para gerar essas informações; e, por fim, verificar a plausibilidade dos resultados experimentais.

Com a constante melhoria das habilidades de programação da IA e a crescente capacidade de modelagem do mundo dos grandes modelos de linguagem, já surgiram uma série de ferramentas que ajudam os cientistas humanos a acelerar o processo e automatizar parcialmente certas etapas em cenários de pesquisa e desenvolvimento mais amplos.

Aqui, podemos observar a velocidade com que a IA avança em várias habilidades científicas fundamentais, que são também partes essenciais da própria pesquisa em IA:

· Primeiro, reproduzir os resultados da pesquisa;

· Em segundo lugar, integrar técnicas de machine learning com outros métodos para resolver problemas técnicos;

· Terceiro, otimizar o próprio sistema de IA.

Implementar o artigo científico completo e realizar os experimentos relacionados

Um dos principais trabalhos na pesquisa de IA é ler artigos científicos e reproduzir seus resultados. Nesse aspecto, a IA já obteve progressos significativos em uma série de benchmarks.

Um bom exemplo é o CORE-Bench, também conhecido como Computational Reproducibility Agent Benchmark.

Este benchmark exige que o sistema de IA reproduza os resultados do artigo, dado o artigo e seu repositório de código. Especificamente, o agente precisa instalar as bibliotecas, pacotes e dependências relacionadas, executar o código; se o código for executado com sucesso, ele também deve buscar todos os resultados de saída e responder às perguntas da tarefa.

O CORE-Bench foi proposto em setembro de 2024. Na época, o sistema com melhor desempenho foi o modelo GPT-4o executado no scaffold CORE-Agent. Nesse conjunto mais difícil de tarefas do benchmark, seu desempenho foi de aproximadamente 21,5%.

Em dezembro de 2025, um dos autores do CORE-Bench anunciou que o benchmark havia sido resolvido: o modelo Opus 4.5 alcançou 95,5%.

Construir um sistema completo de machine learning para resolver problemas de competições do Kaggle

MLE-Bench é um benchmark construído pela OpenAI para testar a capacidade de sistemas de IA de participar de competições do Kaggle em ambientes offline.

Cobre 75 tipos diferentes de competições do Kaggle, abrangendo várias áreas, incluindo processamento de linguagem natural, visão computacional e processamento de sinais, entre outros.

MLE-Bench foi lançado em outubro de 2024. No lançamento, o sistema com melhor desempenho foi um modelo o1 executado em um scaffold de agente, com pontuação de 16,9%.

Até fevereiro de 2026, o sistema de melhor desempenho tornou-se o Gemini 3 executado em um agent harness com capacidade de busca, alcançando pontuação de 64,4%.

Design do Kernel

Uma tarefa mais desafiadora no desenvolvimento de IA é a otimização de kernel. A otimização de kernel consiste em escrever e aprimorar o código de baixo nível para mapear operações específicas, como multiplicação de matrizes, de forma mais eficiente no hardware subjacente.

A otimização do kernel é fundamental no desenvolvimento de IA porque determina a eficiência do treinamento e da inferência: por um lado, ela afeta a quantidade de poder de processamento que você pode efetivamente utilizar ao desenvolver sistemas de IA; por outro lado, após o treinamento do modelo, ela determina quão eficientemente você pode transformar esse poder de processamento em capacidade de inferência.

Nos últimos anos, o uso de IA para design de kernel passou de uma pequena área interessante para um campo de pesquisa altamente competitivo, com vários benchmarks surgindo. No entanto, esses benchmarks ainda não se tornaram muito populares, o que torna difícil modelar claramente seu progresso a longo prazo, como em outras áreas. Por outro lado, podemos sentir a velocidade com que essa direção está avançando por meio de pesquisas em andamento.

Os trabalhos relacionados incluem:

· Tentar construir melhor kernel de GPU usando o modelo DeepSeek;

Converte automaticamente módulos PyTorch em código CUDA;

· A Meta usa LLM para gerar automaticamente kernels Triton otimizados e implantá-los em sua própria infraestrutura;

· E ajustar modelos de pesos abertos projetados para kernel GPU, como o Cuda Agent.

É necessário acrescentar um ponto: o design do kernel realmente possui algumas características particularmente adequadas para o desenvolvimento impulsionado por IA, como a facilidade de validação dos resultados e sinais de recompensa mais claros.

Fine-tune language models via PostTrainBench

Uma versão mais difícil desse tipo de teste é o PostTrainBench. Ele avalia se diferentes modelos de ponta conseguem assumir modelos de pesos abertos menores e melhorar seu desempenho em certos benchmarks por meio de fine-tuning.

Uma vantagem desse benchmark é que ele possui uma linha de base humana muito forte: as versões já instruídas desses pequenos modelos. Essas versões geralmente são desenvolvidas por excelentes pesquisadores de IA de laboratórios de ponta, refinadas por pesquisadores e engenheiros altamente capazes e já implantadas no mundo real. Portanto, elas constituem uma referência humana difícil de superar.

Até março de 2026, os sistemas de IA já conseguem realizar pós-treinamento em modelos, obtendo um aumento de desempenho aproximadamente equivalente à metade do resultado obtido com treinamento humano.

A pontuação de avaliação específica é derivada de uma média ponderada: ela integra vários modelos de linguagem grandes após o treinamento, incluindo Qwen 3 1.7B, Qwen 3 4B, SmolLM3-3B, Gemma 3 4B, e diversos benchmarks, incluindo AIME 2025, Arena Hard, BFCL, GPQA Main, GSM8K, HealthBench e HumanEval.

Em cada execução, a equipe de avaliação solicitará um agente CLI para melhorar o desempenho de um determinado modelo básico em um determinado benchmark.

Até abril de 2026, os sistemas de IA com as maiores pontuações alcançaram aproximadamente 25% a 28%, com modelos representativos como Opus 4.6 e GPT 5.4; em comparação, a pontuação humana foi de 51%.

Este já é um resultado bastante significativo.

Otimizar o treinamento do modelo de linguagem

Nos últimos doze meses, a Anthropic vem relatando o desempenho de seu sistema em uma tarefa de treinamento de LLM. Essa tarefa exige que o modelo otimize uma implementação de treinamento de um pequeno modelo de linguagem que usa apenas CPU, para que funcione o mais rápido possível.

A forma de avaliação é: o número médio de vezes que o modelo acelerou em relação ao código inicial não modificado.

O progresso deste resultado foi muito significativo:

· Em maio de 2025, o Claude Opus 4 alcançou uma aceleração média de 2,9 vezes;

· Em novembro de 2025, o Opus 4.5 foi aumentado para 16,5 vezes;

· Em fevereiro de 2026, o Opus 4.6 atingiu 30 vezes;

· Em abril de 2026, o Claude Mythos Preview atingiu 52x.

Para entender o significado desses números, considere esta referência: em pesquisadores humanos, essa tarefa normalmente requer de 4 a 8 horas de trabalho para alcançar uma aceleração de 4 vezes.

Habilidade primária: Gerenciamento

Os sistemas de IA também estão aprendendo a gerenciar outros sistemas de IA.

Isso já pode ser visto em alguns produtos amplamente implantados, como Claude Code ou OpenCode. Nesses produtos, um agente principal pode supervisionar vários sub-agentes.

Isso permite que o sistema de IA processe projetos de maior escala: projetos que podem exigir que múltiplos agentes com diferentes especializações trabalhem em paralelo, geralmente coordenados por um único gerente de IA. O próprio gerente é também um sistema de IA.

A pesquisa em IA é mais como descobrir a relatividade geral ou montar legos?

Uma questão fundamental é: o AI pode inventar novas ideias para ajudar a se aprimorar? Ou esses sistemas são mais adequados para realizar tarefas menos glamorosas, mas que precisam ser avançadas passo a passo na pesquisa?

This question is important because it relates to the extent to which AI systems can end-to-end automate AI research itself.

O julgamento do autor é: atualmente, a IA ainda não consegue propor novas ideias verdadeiramente radicais. No entanto, para alcançar a automação de seu próprio desenvolvimento, talvez não precise necessariamente fazer isso.

Como campo, o avanço da IA depende em grande parte de experimentos cada vez maiores e de cada vez mais entradas, como dados e poder computacional.

Ocasionalmente, os seres humanos apresentam ideias que transformam paradigmas, aumentando drasticamente a eficiência de recursos em todo o campo. A arquitetura Transformer é um bom exemplo, e os modelos de especialistas mistos, também conhecidos como mixture-of-experts, são outro exemplo.

Mas, com mais frequência, o avanço na área de IA é mais simples: os humanos pegam um sistema que funciona bem, ampliam um de seus aspectos, como dados de treinamento e poder computacional; observam onde surgem problemas após o aumento da escala; encontram soluções de engenharia para corrigi-los e permitir que o sistema continue expandindo; e então aumentam a escala novamente.

Nesse processo, a parte que realmente exige insights é realmente pequena. Grande parte do trabalho é mais como engenharia básica, menos brilhante, mas muito sólida.

Da mesma forma, muitas pesquisas em IA consistem na execução de várias variantes de experimentos existentes, explorando os resultados de diferentes configurações de parâmetros. Embora a intuição da pesquisa possa ajudar os humanos a escolher os parâmetros mais valiosos para testar, esse processo em si também pode ser automatizado, permitindo que a IA decida quais parâmetros merecem ajuste. A busca inicial de arquiteturas neurais é uma versão desse conceito.

Edison uma vez disse: "Genialidade é 1% de inspiração e 99% de suor." Mesmo após 150 anos, essa frase ainda é muito apropriada.

Às vezes, surgem realmente novas insights que transformam completamente um campo. Mas na maioria das vezes, o progresso no campo ocorre gradualmente, através do esforço humano de aprimorar e ajustar diversos sistemas.

E os dados públicos mencionados anteriormente indicam que a IA já se tornou muito habilidosa em executar muitas das tarefas árduas e necessárias no desenvolvimento de IA.

Ao mesmo tempo, há uma tendência maior: habilidades fundamentais, como programação, estão sendo combinadas com um intervalo de tempo de tarefas em constante expansão. Isso significa que sistemas de IA podem cada vez mais encadear essas tarefas para formar sequências de trabalho complexas.

Portanto, mesmo que os sistemas de IA atualmente tenham criatividade relativamente limitada, há razões para acreditar que ainda assim conseguem impulsionar seu próprio avanço. Contudo, essa progressão pode ser mais lenta em comparação com situações em que são capazes de gerar novas insights.

Mas, se continuar a observar os dados públicos, será possível perceber outro sinal curioso: os sistemas de IA podem estar demonstrando certa criatividade, e essa criatividade pode permitir que eles impulsionem seu próprio progresso de maneiras mais surpreendentes.

Impulsionar a fronteira da ciência para frente

Já existem alguns indícios muito iniciais de que sistemas de IA geral têm a capacidade de impulsionar a fronteira da ciência humana adiante. No entanto, até agora, isso ocorreu apenas em poucos campos, principalmente ciência da computação e matemática. E muitas vezes, as descobertas não são realizadas apenas pelo sistema de IA, mas sim por meio de colaboração homem-máquina, em conjunto com pesquisadores humanos.

Mesmo assim, essas tendências ainda valem a pena ser observadas:

Problema de Erdős: Um grupo de matemáticos colaborou com o modelo Gemini para testar seu desempenho na resolução de alguns problemas matemáticos de Erdős. Eles orientaram o sistema a tentar cerca de 700 problemas, resultando em 13 soluções. Dentre essas soluções, uma foi considerada interessante por eles.

Os pesquisadores escreveram que, inicialmente, consideram que a solução da Aletheia (um sistema de IA baseado no Gemini 3 Deep Think) para o Erdős-1051 representa um caso inicial: um sistema de IA resolvendo autonomamente um problema aberto de Erdős ligeiramente não trivial e de certo interesse matemático mais amplo. Esse problema já tinha algumas publicações de pesquisa relacionadas.

Se interpretado de forma otimista, esses casos podem ser vistos como um sinal de que os sistemas de IA estão desenvolvendo algum tipo de intuição criativa capaz de impulsionar a fronteira do campo, algo que antes pertencia principalmente aos seres humanos.

Mas também pode ser interpretado de outro modo: a matemática e a ciência da computação podem ser campos particularmente adequados para descobertas impulsionadas por IA, portanto, talvez sejam apenas exceções e não representem que outras áreas da pesquisa científica serão impulsionadas pela IA da mesma maneira.

Outro exemplo semelhante é a 37ª jogada do AlphaGo. No entanto, Clark acredita que, como já se passaram dez anos desde aquele resultado do AlphaGo e a 37ª jogada não foi substituída por uma descoberta mais moderna e impressionante, isso em si também pode ser visto como um sinal ligeiramente pessimista.

A IA já pode automatizar grande parte do trabalho na engenharia de IA

Se colocarmos todas as evidências acima juntas, podemos ver um quadro assim:

Sistemas de IA já conseguem escrever código para quase qualquer programa, e esses sistemas já podem ser confiáveis para realizar independentemente algumas tarefas; tarefas que, se atribuídas a humanos, geralmente exigiriam dezenas de horas de trabalho intenso e concentrado.

Os sistemas de IA estão ficando cada vez melhores em realizar tarefas centrais no desenvolvimento de IA, desde o ajuste fino de modelos até o design de kernels, todas sendo gradualmente abrangidas.

Sistemas de IA já conseguem gerenciar outros sistemas de IA, formando na prática uma equipe sintética: vários AI podem lidar separadamente com problemas complexos, onde alguns AI desempenham papéis de líderes, críticos e editores, enquanto outros atuam como engenheiros.

· Sistemas de IA já conseguem, às vezes, superar humanos em tarefas de engenharia e ciência difíceis, embora ainda seja difícil determinar se isso ocorre porque possuem criatividade verdadeira ou porque dominaram habilmente um grande volume de conhecimento padronizado.

Na visão de Clark, essas evidências já demonstram de forma muito convincente que a IA atual já pode automatizar grande parte do trabalho de engenharia de IA, possivelmente até cobrindo todos os seus processos.

No entanto, ainda não está claro em que medida a IA pode automatizar a própria pesquisa em IA, pois certas partes da pesquisa podem diferir das habilidades puramente de engenharia e ainda depender de julgamentos de maior nível, consciência de problemas e criatividade.

Mas de qualquer forma, um sinal claro já apareceu: a IA de hoje está acelerando drasticamente o trabalho dos humanos que desenvolvem IA, permitindo que esses pesquisadores e engenheiros amplifiquem sua capacidade de trabalho ao se emparelhar com inúmeros colegas sintéticos.

Por fim, o próprio setor de IA está quase dizendo explicitamente: automatizar a pesquisa em IA é o seu objetivo.

A OpenAI deseja construir um estagiário de pesquisa de IA automatizado até setembro de 2026. A Anthropic está publicando trabalhos sobre a construção de pesquisadores automatizados de alinhamento de IA. A DeepMind parece a mais cautelosa entre os três laboratórios, mas também afirma que a automação da pesquisa de alinhamento deve ser avançada quando viável.

O desenvolvimento automatizado de IA também se tornou um objetivo de muitas startups. A Recursive Superintelligence acabou de levantar 500 milhões de dólares com o objetivo de automatizar a pesquisa em IA.

Em outras palavras, bilhões de dólares em capital existente e novo estão sendo investidos em uma série de instituições com o objetivo de desenvolver IA automatizada.

Portanto, naturalmente devemos esperar que esta direção alcance algum grau de progresso.

Por que isso é importante

As implicações disso são profundas, mas raramente discutidas na mídia mainstream sobre o desenvolvimento de IA. Os seguintes aspectos refletem os grandes desafios trazidos pelo desenvolvimento de IA.

1. Devemos garantir o alinhamento: técnicas de alinhamento eficazes hoje podem falhar na autoaprimoração recursiva, pois os sistemas de IA se tornarão muito mais inteligentes do que as pessoas ou sistemas que os supervisionam. Este é um campo amplamente estudado, então ele apenas esboça brevemente alguns problemas:

Treinar sistemas de inteligência artificial para não mentir ou fraudar é um processo surpreendentemente sutil (por exemplo, mesmo com esforços para criar bons testes para o ambiente, às vezes o melhor método da IA para resolver problemas é fraudar, ensinando-a que a fraude é viável).

· Sistemas de IA podem nos enganar por meio de “falsa alinhamento”, gerando pontuações que nos fazem acreditar que estão se saindo bem, mas na verdade ocultam suas intenções reais. (Em geral, sistemas de IA já conseguem perceber quando estão sendo testados.)

· À medida que sistemas de IA começam a participar mais ativamente na agenda de pesquisa básica que fundamenta seu próprio treinamento, podemos alterar drasticamente a maneira como treinamos sistemas de IA, sem uma intuição ou base teórica sólida para compreender o que isso significa.

· Quando você coloca um sistema em um ciclo recursivo, surge um problema fundamental de "acúmulo de erros", que pode afetar todos os problemas acima e outros: a menos que seu método de alinhamento seja "100% preciso" e teoricamente capaz de manter essa precisão continuamente em sistemas mais inteligentes, as coisas podem rapidamente sair do controle. Por exemplo, se sua precisão inicial da tecnologia for de 99,9%, após 50 gerações pode cair para 95,12%, e após 500 gerações pode cair para 60,5%.

Tudo envolvendo IA terá um grande aumento de produtividade: assim como a IA aumenta significativamente a produtividade dos engenheiros de software, devemos esperar que outros campos envolvendo IA também o façam. Isso traz vários desafios que precisam ser enfrentados:

· Desigualdade no acesso aos recursos: supondo que a demanda por IA continue superando a oferta de recursos computacionais, precisamos decidir como alocar a IA para maximizar o benefício social. Tenho ceticismo quanto à capacidade dos incentivos de mercado de garantir que obtenhamos o melhor retorno social possível dos recursos computacionais limitados de IA. Determinar como alocar a capacidade de aceleração trazida pelo desenvolvimento de IA será uma questão altamente política.

· A Lei de Amdahl da economia: À medida que a IA flui para a economia, descobriremos que certos elos apresentarão gargalos diante do crescimento acelerado, exigindo soluções para corrigir os pontos fracos dessas cadeias. Isso pode ser particularmente evidente em áreas que exigem coordenação entre o mundo digital rápido e o mundo físico lento, como ensaios clínicos de novos medicamentos.

3. Formação de uma economia intensiva em capital e leve em mão de obra: Todas as evidências acima sobre o desenvolvimento de IA também indicam que os sistemas de IA estão se tornando cada vez mais capazes de operar empresas de forma autônoma.

Isso significa que podemos esperar que uma parte da economia seja ocupada por uma nova geração de empresas, que podem ser intensivas em capital (por possuírem grandes quantidades de computadores) ou intensivas em despesas operacionais (por gastarem grandes quantias em serviços de IA e criarem valor sobre essa base), em comparação com as empresas de hoje, que dependem relativamente menos de mão de obra — pois, à medida que a capacidade dos sistemas de IA continua a aumentar, o valor marginal do investimento em IA cresce constantemente.

Na verdade, isso se manifestará como uma “economia machine” gradualmente emergindo dentro da “economia humana” maior; com o tempo, empresas operadas por IA poderão começar a realizar transações entre si, alterando a estrutura econômica e suscitando diversas questões sobre desigualdade e redistribuição. Por fim, poderão surgir empresas inteiramente operadas de forma autônoma por sistemas de IA, acentuando os problemas acima mencionados e trazendo muitos novos desafios de governança.

Olhar para o buraco negro

Com base na análise acima, o autor acredita que, até o final de 2028, há cerca de 60% de probabilidade de observarmos o desenvolvimento automatizado por IA (ou seja, modelos de ponta capazes de treinar autonomamente suas versões sucessoras). Por que não se espera que isso ocorra em 2027?

A razão é que o autor acredita que a pesquisa em IA ainda precisa de criatividade e perspectivas divergentes para avançar, e até agora os sistemas de IA não demonstraram isso de forma transformadora e significativa (embora alguns resultados na aceleração da pesquisa matemática sejam indicativos).

Se for obrigado a dar a probabilidade para 2027, ele dirá 30%.

Se ainda não ocorrer até o final de 2028, podemos revelar algumas deficiências fundamentais no atual paradigma tecnológico, exigindo inovações humanas para impulsionar o desenvolvimento futuro.