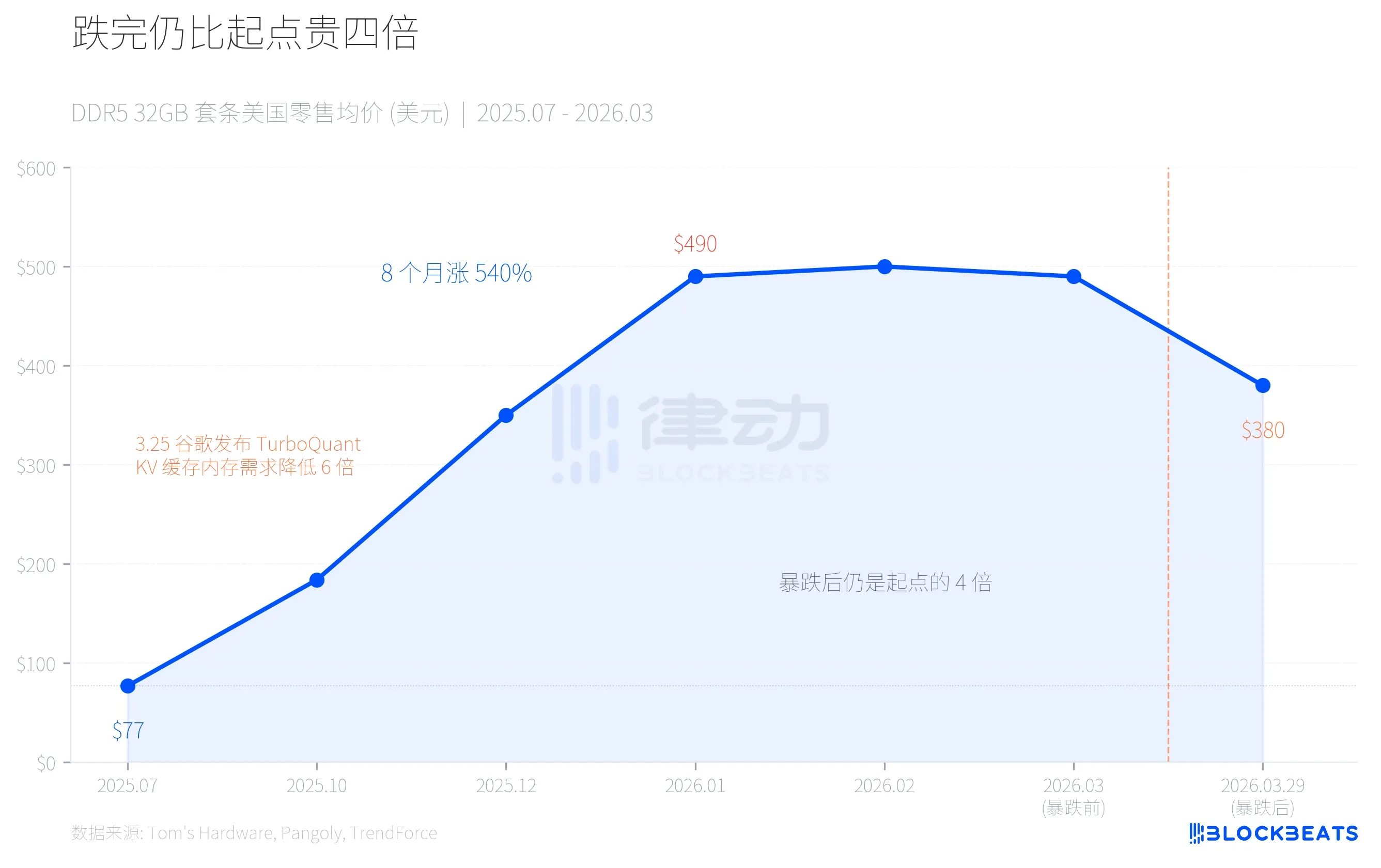

Em 29 de março, os mercados de varejo de Huaqiangbei e dos Estados Unidos experimentaram simultaneamente uma queda acentuada nos preços dos módulos de memória. O kit Corsair 32GB DDR5-6400 caiu de US$ 490 para US$ 380, uma queda de 22% em um único dia. No mercado interno, os kits DDR5 de alta frequência de 32GB caíram 800 yuans em uma semana, com distribuidores vendendo em pânico; um revendedor disse: “Caiu mais de cem yuans em um dia”.

Mas, quando esse número é colocado em um cronograma mais longo, a imagem é totalmente diferente: mesmo após a queda, o preço atual do DDR5 ainda é quatro vezes maior do que em julho de 2025. Trata-se de um descompasso preciso de oferta e demanda na cadeia de valor da IA, onde a mesma força primeiro criou uma escassez e depois um pânico por excesso.

Montanha-russa: alta de 540% em oito meses, queda de 22% em um mês

Em julho de 2025, um conjunto de memória DDR5-6000 de 32 GB mainstream custava apenas 77 dólares no mercado varejista dos EUA. Em janeiro de 2026, o mesmo conjunto subiu para 490 dólares. Oito meses, uma alta de 540%.

O aumento de preços não se deve à ascensão repentina dos consumidores para atualizar seus computadores. Segundo dados da TrendForce, o preço contratual do DRAM no primeiro trimestre de 2026 subiu de 90% a 95% em relação ao trimestre anterior, com o DRAM para PC aumentando mais de 100%, ambos os valores registrando o maior aumento trimestral da história. O impulso por trás disso é a demanda insaciável por uma memória especial proveniente da infraestrutura de IA.

Em seguida, em 25 de março, o Google lançou um algoritmo de compressão chamado TurboQuant. Quatro dias depois, os preços da memória despencaram.

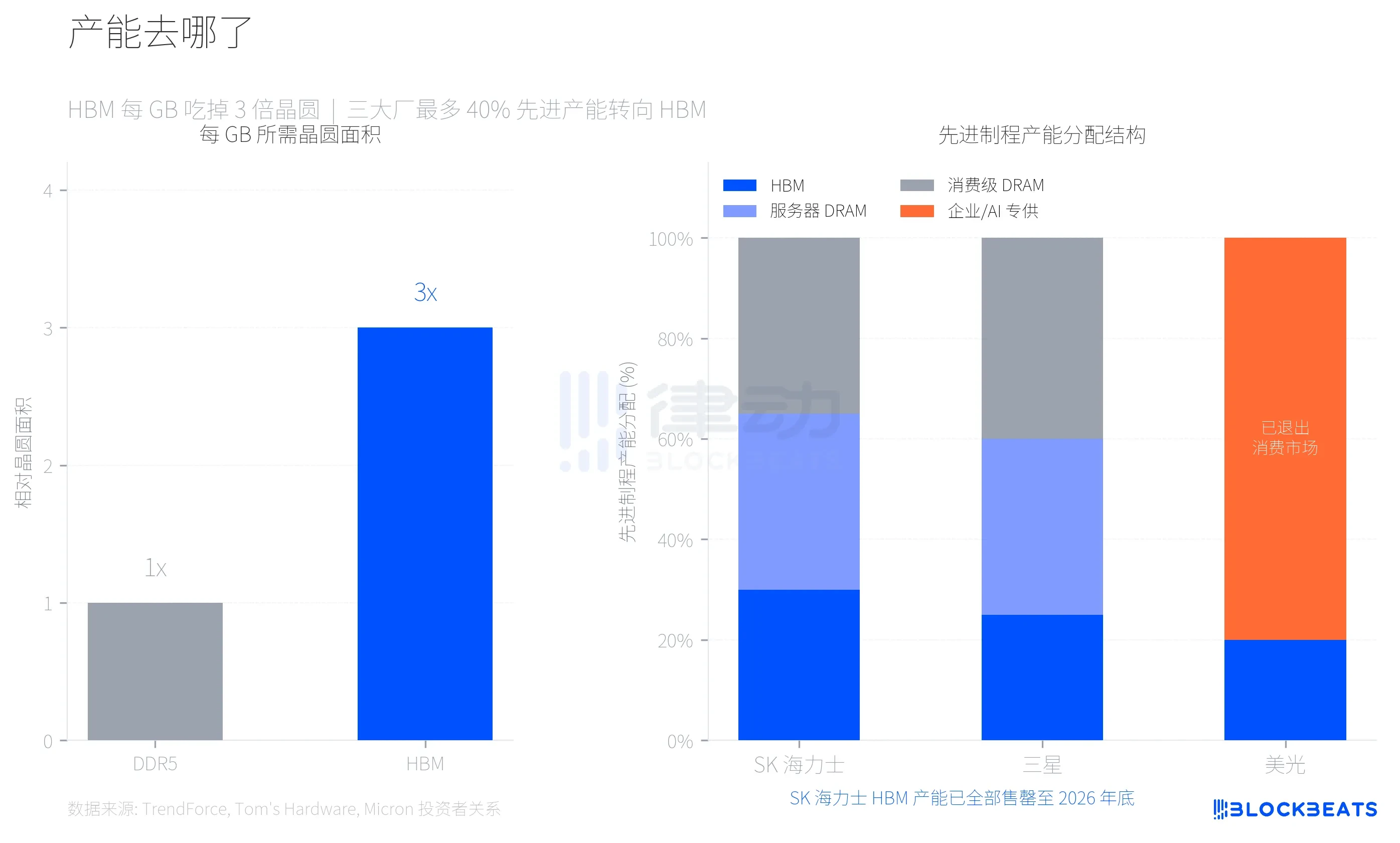

Onde foi parar a capacidade? O HBM devorou seus módulos de memória

Para entender este aumento de preços, é necessário compreender um parâmetro técnico chave. A HBM (memória de alta largura de banda, usada nos chips de IA da NVIDIA) consome três vezes mais área de wafer por GB do que a DDR5 comum. Segundo o Tom's Hardware, isso significa que, com o mesmo wafer, a produção de HBM gera apenas um terço da capacidade da DDR5.

Samsung, SK Hynix e Micron, as três principais fabricantes de memória, fizeram uma escolha racional diante da alta margem de lucro do HBM, desviando até 40% da capacidade de wafers de processos avançados para a produção de HBM. Segundo dados da TrendForce, até o primeiro trimestre de 2026, a margem de lucro do DDR5 deverá superar pela primeira vez a do HBM3e, refletindo o grau em que a oferta de memória para consumo foi comprimida.

A escolha da Micron foi a mais ousada. Em dezembro de 2025, a empresa anunciou o encerramento da marca de consumo Crucial, que operava há 29 anos, saindo totalmente do mercado de memória e armazenamento para consumidores e focando integralmente em clientes corporativos e de IA. Segundo o comunicado de relações com investidores da Micron, sua receita total no ano fiscal de 2025 foi de US$ 37,38 bilhões, com aplicações em data centers e IA representando 56% da receita total. O mercado de consumo não vale a pena.

A capacidade de produção de HBM da SK Hynix já está totalmente comprometida até o final de 2026. A Samsung planeja aumentar a capacidade mensal de produção de HBM de 170.000 wafers para 250.000 wafers até o final de 2026. As novas fábricas de wafers (Samsung P4L e SK Hynix M15X) só entrarão em produção em larga escala mais cedo em 2027-2028. Em outras palavras, a lacuna de oferta de DRAM para consumidores é estrutural e não será resolvida em apenas um ou dois trimestres.

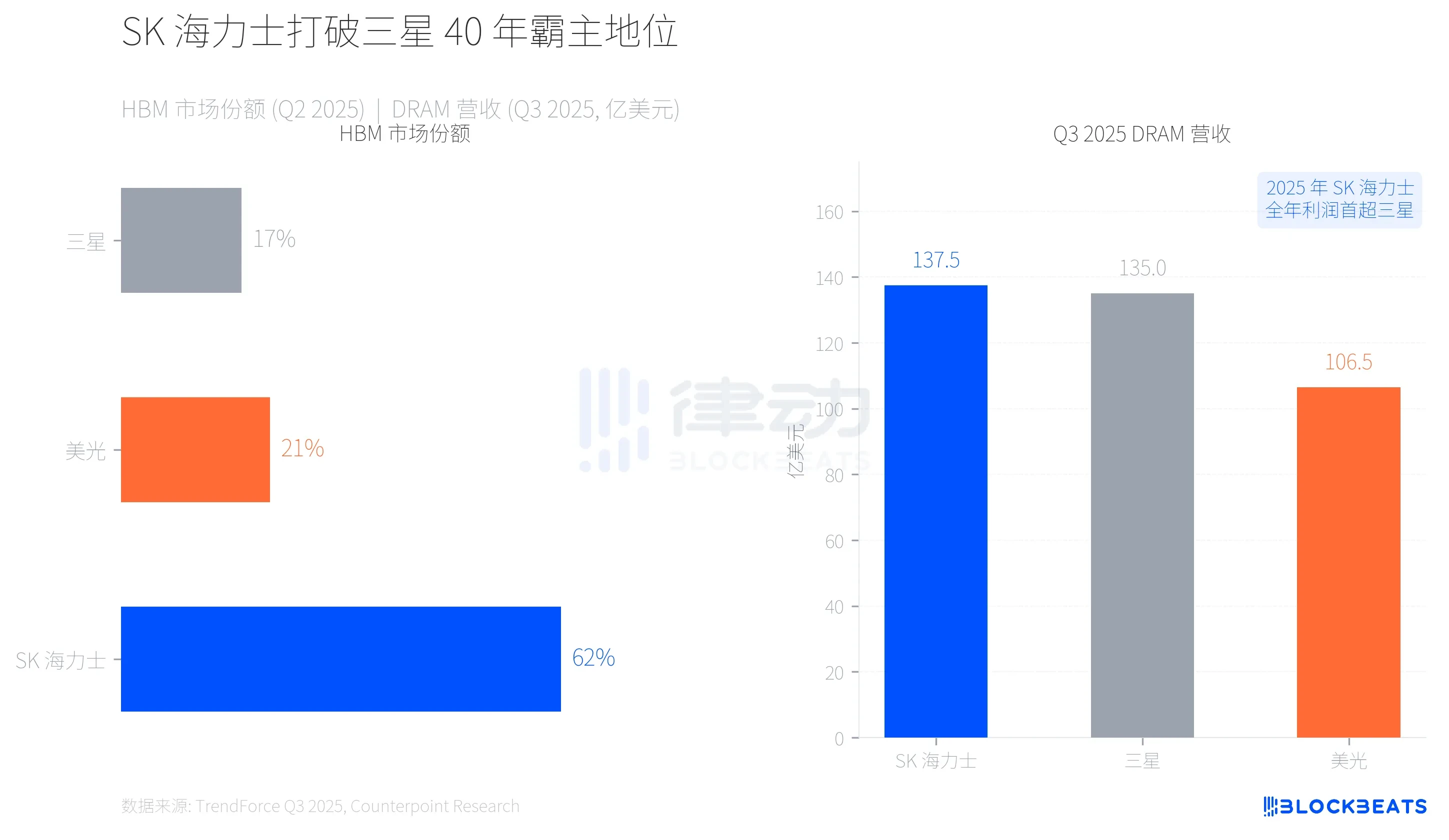

A dinâmica muda; SK Hynix encerra o domínio de 40 anos da Samsung

Essa transferência de capacidade reescreveu o mapa de poder da indústria de memória. Segundo dados da TrendForce, no segundo trimestre de 2025, a SK Hynix conquistou 62% do mercado de HBM graças à sua estreita parceria com a NVIDIA, enquanto a Samsung deteve apenas 17% e a Micron 21%.

Mais significativamente, houve uma inversão na receita. Segundo o relatório da TrendForce para o Q3 de 2025, SK Hynix alcançou pela primeira vez a liderança com uma receita trimestral de DRAM de US$ 13,75 bilhões, seguida pela Samsung com US$ 13,50 bilhões. A diferença entre ambas é de apenas US$ 250 milhões, mas é a primeira vez em quase 40 anos que a Samsung perde a posição de número um em receita de memória. Segundo a CNBC, o lucro operacional anual da SK Hynix em 2025 também superou pela primeira vez o da Samsung.

A vantagem de primeira-mover da HBM deu à SK Hynix uma quantidade suficiente de vantagens, mas essa corrida está longe de terminar. A Samsung está se esforçando ao máximo para acompanhar a produção em massa da HBM4, e a Micron, embora tenha abandonado o mercado de consumo, registrou o maior crescimento de receita nos setores corporativo e de IA (aumento de 53,2% em relação ao Q3), sendo o mais rápido entre as três empresas.

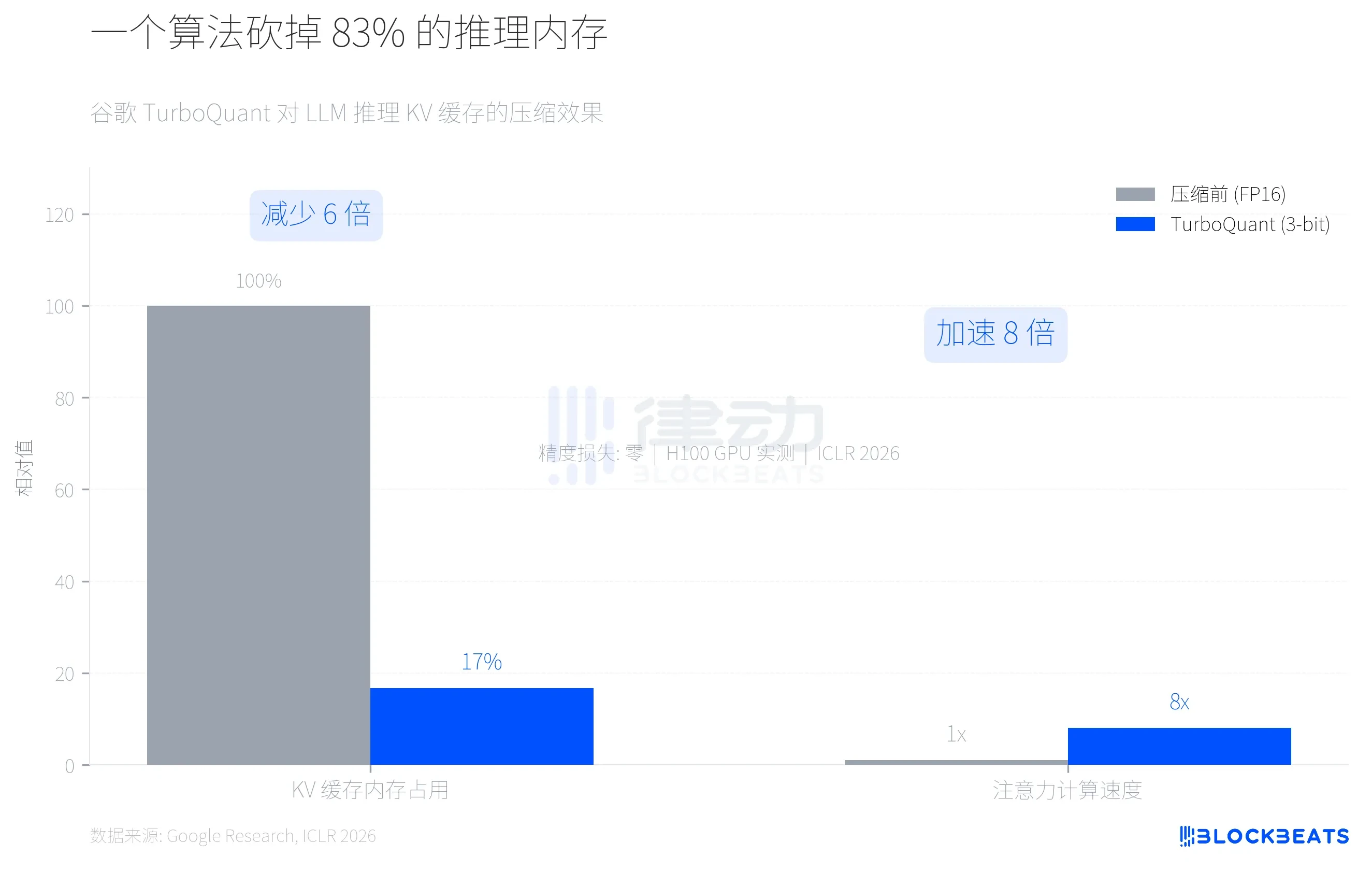

Como um algoritmo abalou a lógica de aumento de preços?

Em 25 de março, o Google apresentou o algoritmo TurboQuant no ICLR 2026. Este algoritmo realiza uma única tarefa: comprimir o cache KV (cache de chave-valor, a parte que mais consome memória durante a inferência) dos modelos de linguagem de grande porte de precisão FP16 para 3-bit, reduzindo o uso de memória em pelo menos 6 vezes e alcançando até 8 vezes de aceleração no cálculo de atenção em GPUs H100. Segundo o blog de pesquisa do Google, em cinco benchmarks de contexto longo, incluindo Needle-in-a-Haystack, a perda de precisão foi nula.

O mercado fez rapidamente um cálculo. Se o TurboQuant ou algoritmos semelhantes forem amplamente adotados por empresas de IA principais, a demanda adicional de DRAM por inferência de IA diminuirá significativamente. E a narrativa central que sustentou a alta dos preços de memória nos últimos seis meses foi exatamente a de que "a infraestrutura de IA consumiu muita capacidade de memória".

Quatro dias depois, a confiança no canal colapsou.

É importante destacar que o TurboQuant é voltado para o cache KV da inferência de IA, e não para a demanda de HBM na fase de treinamento. A relação de oferta e demanda de HBM não mudará a curto prazo devido a um algoritmo de otimização de inferência. No entanto, o mercado nem sempre distingue esses dois aspectos. Segundo notícias da Sina Finance, no período anterior à queda acentuada, canais domésticos atraíram um grande número de compradores externos ao setor devido ao aumento de preços; os preços elevados levaram a uma queda superior a 60% nas vendas no varejo, e as vendas em cadeia motivadas por tensão no fluxo de caixa amplificaram a queda.

Uma cadeia de valor de IA gerou ao mesmo tempo pânico por escassez e superprodução de memória. A pressão sobre a capacidade física de HBM causou escassez de memória para consumidores, enquanto a quebra na eficiência algorítmica do TurboQuant reduziu drasticamente as expectativas de demanda por memória para IA. A mesma força impulsionou tanto o aumento de preços quanto o colapso.