Como os agentes de IA de autoaprendizado diferem dos modelos tradicionais de aprendizado de máquina e dos agentes baseados em LLM atuais?

2026/05/02 07:21:02

Introdução

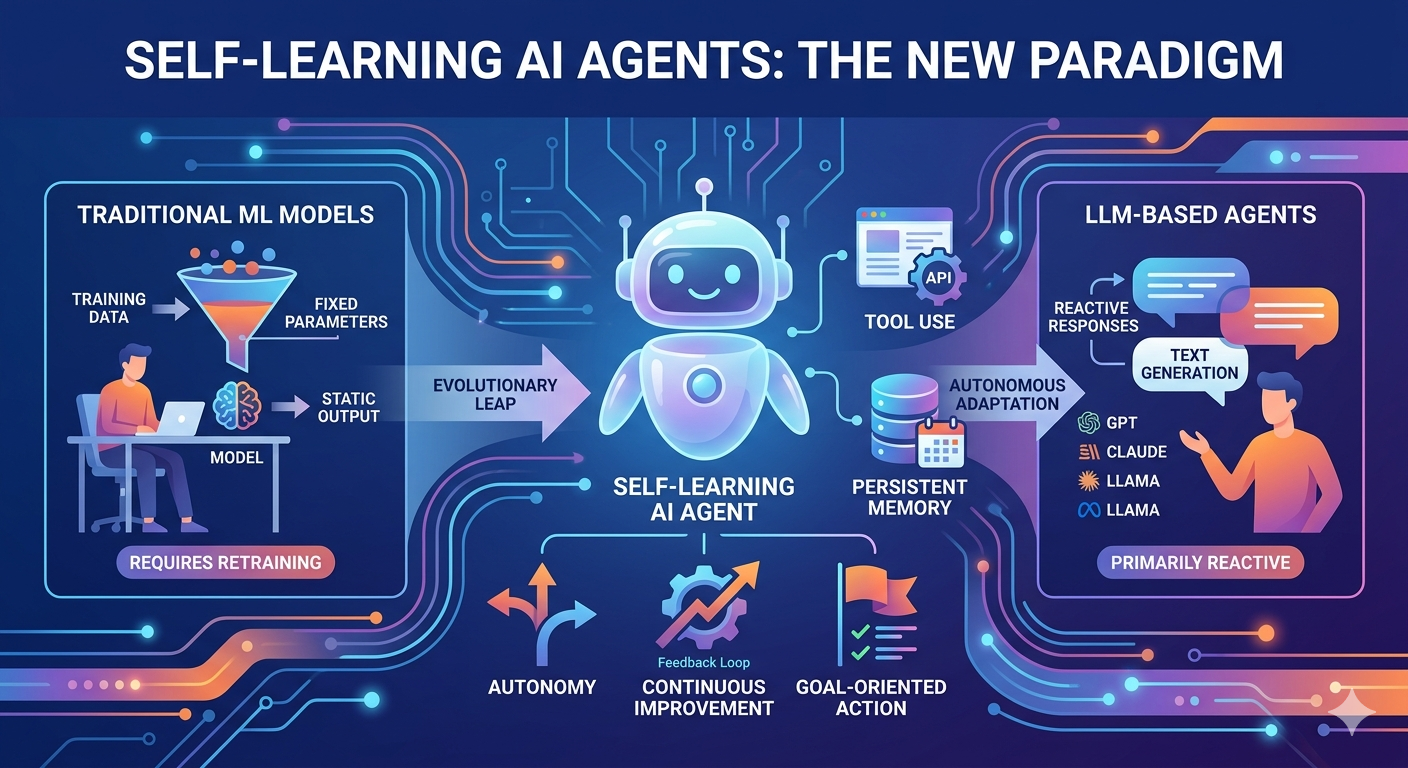

O cenário da inteligência artificial está passando por uma transformação profunda. Enquanto modelos tradicionais de aprendizado de máquina dominaram a última década e modelos de linguagem grandes capturaram a atenção do mundo desde 2022, um novo paradigma está emergindo que altera fundamentalmente como os sistemas de IA operam. Agentes de IA autoaprendizes AI agents representam o próximo salto evolutivo, combinando autonomia, raciocínio adaptativo e melhoria contínua de maneiras que os distinguem claramente de seus predecessores e dos sistemas atuais baseados em LLMs. Compreender essas diferenças é essencial para qualquer pessoa que deseja navegar pelo ecossistema de IA em rápida evolução.

O que são agentes de IA autoaprendizes?

Agentes de IA autodidatas são entidades computacionais autônomas capazes de perceber seu ambiente, analisar informações, formular decisões e executar ações para alcançar objetivos específicos. Ao contrário dos sistemas de IA convencionais, que exigem orientação humana em cada etapa, os agentes autodidatas podem receber um objetivo de alto nível e determinar independentemente como realizá-lo. Esses agentes combinam capacidades de percepção, raciocínio, aprendizado e ação para simular comportamento inteligente anteriormente visto apenas em sistemas biológicos.

As características definidoras dos agentes de IA de autoaprendizado incluem autonomia, reatividade, proatividade e habilidade social. A autonomia permite que os agentes operem independentemente sem intervenção humana contínua. A reatividade permite que eles percebam mudanças no ambiente e respondam adequadamente. A proatividade significa que eles não apenas reagem a estímulos, mas buscam ativamente metas por meio de planejamento. A habilidade social permite a colaboração com outros agentes em sistemas multiagente para completar tarefas complexas.

De acordo com as previsões de IA da Microsoft para 2025, agentes impulsionados por IA estão ganhando maior autonomia para executar mais tarefas, melhorando assim a qualidade de vida em diversos domínios. A principal distinção reside em como esses agentes lidam com objetivos: enquanto um modelo de linguagem grande exige um prompt detalhado e bem elaborado para produzir uma saída de qualidade, um agente de IA precisa apenas de um objetivo e será capaz de pensar independentemente e executar as ações necessárias.

Modelos Tradicionais de Aprendizado de Máquina: Estrutura e Limitações

Modelos tradicionais de aprendizado de máquina representam uma abordagem fundamentalmente diferente da inteligência artificial. Esses modelos são tipicamente treinados em conjuntos de dados específicos para realizar tarefas estreitas e bem definidas, como classificação, regressão ou agrupamento. Uma vez implantados, operam dentro de parâmetros fixos e não podem modificar seu comportamento com base em novas experiências sem um re-treinamento explícito.

A arquitetura dos modelos tradicionais de ML centra-se no aprendizado estatístico a partir de dados históricos. Um modelo aprende padrões durante o treinamento e aplica esses padrões aprendidos a novas entradas no momento da inferência. Essa abordagem funciona excepcionalmente bem para tarefas com padrões claros e entradas consistentes, como detecção de spam, classificação de imagens ou sistemas de recomendação. No entanto, a natureza estática desses modelos cria limitações significativas em ambientes dinâmicos e imprevisíveis.

Modelos tradicionais de ML exigem que engenheiros humanos definam características, selecionem algoritmos e ajustem hiperparâmetros. Quando a distribuição dos dados muda ou os requisitos da tarefa variam, os modelos podem sofrer degradação no desempenho e exigir retrinamento. O processo de aprendizado é essencialmente congelado após a implantação, o que significa que esses sistemas não podem melhorar com a experiência nem se adaptar a situações novas sem intervenção explícita.

As equipes de segurança e conformidade geralmente utilizam ML tradicional para reconhecimento de padrões em dados estruturados, mas esses sistemas enfrentam dificuldades quando confrontados com tarefas que exigem compreensão contextual ou raciocínio em múltiplas etapas. Eles não possuem a capacidade de planejar, raciocinar sobre causalidade ou decompor problemas complexos em sub-tarefas menores e gerenciáveis.

Agentes baseados em LLM: Capacidades e restrições atuais

Os agentes baseados em LLM atuais representam um avanço significativo em relação ao aprendizado de máquina tradicional. Construídos sobre modelos de linguagem grandes com bilhões de parâmetros, esses sistemas conseguem entender linguagem natural, gerar texto semelhante ao humano e realizar tarefas de raciocínio que anteriormente eram impossíveis para a IA. Empresas como OpenAI, Anthropic e Google desenvolveram modelos cada vez mais capazes que servem como base para muitas aplicações de IA hoje.

Agentes baseados em LLMs se destacam na compreensão e geração de linguagem natural. Eles podem participar de conversas significativas, resumir documentos, escrever código e explicar conceitos complexos. O modelo o1 da OpenAI, por exemplo, demonstra capacidades avançadas de raciocínio que o permitem resolver problemas complexos por meio de etapas lógicas semelhantes à análise humana antes de responder perguntas difíceis.

No entanto, a maioria dos agentes baseados em LLM atuais são sistemas fundamentalmente reativos. Eles respondem a prompts do usuário, mas não perseguem proativamente metas nem executam ações no mundo. Quando você interage com um chatbot, o sistema gera uma resposta com base em sua entrada e nos dados de treinamento, mas não toma iniciativas independentes para alcançar um objetivo mais amplo sem orientação humana contínua.

As limitações de agentes baseados em LLM tornam-se aparentes quando as tarefas exigem esforço contínuo em múltiplos passos, integração com ferramentas externas ou adaptação com base em feedback. Embora esses modelos possam raciocinar sobre problemas em uma única exchange, muitas vezes carecem da capacidade de manter estado entre interações, executar ações em sistemas externos ou aprender com os resultados de suas decisões.

Diferenças Chave: Agentes de IA Autoaprendizes vs ML Tradicional

As diferenças entre agentes de IA de autoaprendizado e modelos tradicionais de aprendizado de máquina abrangem arquitetura, capacidade e filosofia operacional. Compreender essas distinções esclarece por que muitos especialistas consideram os agentes a próxima fronteira no desenvolvimento de IA.

-

Aprendizado e Adaptação

Modelos tradicionais de ML aprendem durante uma fase de treinamento fixa e depois operam de forma estática. Um modelo de detecção de fraude treinado com dados históricos de transações aplicará os mesmos padrões indefinidamente, a menos que seja re-treinado. Em contraste, agentes de autoaprendizado podem aprender continuamente por meio de suas interações com o ambiente. Eles observam os resultados de suas ações, analisam o que funcionou e o que não funcionou, e modificam suas estratégias conforme necessário.

-

Autonomia e Comportamento Orientado por Objetivos

Modelos tradicionais de ML são ferramentas que os humanos usam para realizar tarefas específicas. Eles não perseguem objetivos de forma independente; simplesmente processam entradas e produzem saídas de acordo com padrões aprendidos. Agentes de autoaprendizado são sistemas orientados a objetivos que podem receber objetivos de alto nível e determinar o melhor curso de ação para alcançá-los. Eles decompõem objetivos complexos em subtarefas, executam essas subtarefas e ajustam sua abordagem com base no progresso.

-

Uso de Ferramentas e Interação com o Ambiente

Agentes de autoaprendizado podem se integrar a ferramentas externas, APIs e sistemas de software. Eles podem navegar na internet, manipular arquivos, executar código e interagir com bancos de dados. Modelos tradicionais de ML normalmente não conseguem fazer isso; eles são limitados aos inputs que recebem e aos outputs que geram dentro de seu próprio grafo de computação.

-

Compreensão e planejamento contextuais

Enquanto o ML tradicional se destaca no reconhecimento de padrões em dados estruturados, agentes de autoaprendizado demonstram capacidades superiores na compreensão de contexto e no planejamento de soluções em múltiplos passos. Um agente com o objetivo de planejar uma viagem pesquisará destinos, comparará preços, verificará disponibilidade e reservará os arranjos—comportamentos impossíveis para um modelo de classificação estático.

Diferenças Chave: Agentes de IA de Aprendizado Próprio vs Agentes Baseados em LLM

A distinção entre agentes de IA de autoaprendizado e agentes baseados em LLMs atuais é sutil, mas consequente. Ambos podem usar modelos de linguagem grandes como componentes principais, mas suas arquiteturas e modos operacionais diferem significativamente.

-

Operação Reativa vs Proativa

A maioria dos agentes baseados em LLM atuais são sistemas reativos que geram respostas a prompts. Um usuário faz uma pergunta e o modelo fornece uma resposta. No entanto, agentes de autoaprendizado podem operar proativamente. Dado um objetivo, eles tomam iniciativa para reunir informações, fazer planos e executar ações sem esperar por entrada humana em cada etapa.

-

Gerenciamento de Estado e Memória

LLMs tradicionais tratam cada conversa como sem estado, embora algumas implementações adicionem janelas de contexto. Agentes autoaprendizes incorporam sistemas de memória sofisticados que mantêm informações entre sessões, rastreiam o progresso em direção a metas e permitem aprender com experiências passadas. Essa memória persistente permite que os agentes construam sobre o trabalho anterior em vez de começar do zero a cada interação.

-

Integração de ferramentas e execução de ações

Agentes baseados em LLM geram principalmente texto, mesmo quando esse texto representa código ou comandos. Agentes de autoaprendizado são projetados para realmente executar esses comandos e interagir com sistemas externos. O Operator da OpenAI e o Computer Use do Claude representam os primeiros passos nessa direção, permitindo que a IA controle navegadores, interfaces de linha de comando e aplicativos de software.

-

Adaptação dinâmica do fluxo de trabalho

Quando um agente baseado em LLM enfrenta um obstáculo, geralmente falha ou produz uma mensagem de erro. Um agente de autoaprendizado pode reconhecer quando sua abordagem inicial não está funcionando, analisar o porquê e ajustar dinamicamente sua estratégia. Essa capacidade de iterar e se adaptar é crucial para lidar com tarefas complexas e do mundo real que raramente ocorrem exatamente como planejado.

A Arquitetura de Agentes de Aprendizado Próprio

Compreender o que torna os agentes de autoaprendizado diferentes exige examinar sua arquitetura subjacente. Esses sistemas combinam vários componentes que trabalham juntos para permitir comportamento autônomo e adaptativo.

-

Motor de Planejamento e Raciocínio

No núcleo de um agente de autoaprendizado está um mecanismo de raciocínio, geralmente impulsionado por um grande modelo de linguagem, capaz de decompor metas complexas em etapas actionáveis. Esse mecanismo permite que o agente planeje, raciocine sobre causalidade e avalie os resultados de ações potenciais. A pesquisa da Microsoft indica que métodos de treinamento e capacidades do agente podem criar efeitos sinérgicos, com modelos aprimorados possibilitando agentes mais eficazes.

-

Sistemas de Memória

Agentes de autoaprendizado mantêm vários tipos de memória: memória de trabalho de curto prazo para tarefas atuais, memória de longo prazo para conhecimento persistente e memória episódica para experiências passadas. Esses sistemas de memória permitem que os agentes aprendam com feedback, lembrem-se de estratégias bem-sucedidas e evitem repetir erros. A sofisticação desses sistemas de memória distingue os agentes verdadeiramente de autoaprendizado de sistemas reativos mais simples.

-

Uso de Ferramentas e Integração de API

Os agentes estão equipados com a capacidade de chamar ferramentas externas, acessar bancos de dados, navegar na web e interagir com aplicativos de software. Essa capacidade de uso de ferramentas amplia o alcance do agente além da geração pura de texto, permitindo ações no mundo real. O agente pode selecionar as ferramentas apropriadas com base na tarefa, executar chamadas de ferramentas e incorporar os resultados em seu raciocínio.

-

Feedback e Mecanismos de Aprendizado

Talvez a característica mais distintiva dos agentes de autoaprendizado seja sua capacidade de aprender com a experiência. Quando um agente tenta uma tarefa, ele pode avaliar o resultado, identificar o que deu errado e modificar sua abordagem para tentativas futuras. Esse aprendizado pode ocorrer por meio de diversos mecanismos, incluindo aprendizado por reforço, autoanálise e refinamento iterativo.

Aplicações e Implicações do Mundo Real

As capacidades únicas dos agentes de IA de autoaprendizado estão permitindo novas aplicações em diversos setores. A Microsoft relata que quase 70% dos funcionários das Fortune 500 já usam agentes do Microsoft 365 Copilot para lidar com tarefas diárias repetitivas, como filtragem de e-mails e registro de notas em reuniões durante conferências no Teams.

Na gestão da cadeia de suprimentos, agentes podem prever variações na demanda de estoque com base em dados históricos e informações em tempo real, ajustando planos de aquisição e produção para evitar faltas ou excessos de estoque. Na área da saúde, agentes podem analisar casos de pacientes, fornecer sugestões de diagnóstico e auxiliar no planejamento de tratamentos ao processar grandes volumes de literatura médica e registros de pacientes.

As implicações vão além dos ganhos de eficiência. Agentes de autoaprendizado estão transformando a forma como o trabalho baseado em conhecimento é realizado. Em vez de humanos aprenderem a usar ferramentas de IA, o paradigma está mudando para agentes de IA que aprendem a auxiliar os humanos de forma mais eficaz. Isso representa uma mudança fundamental na relação humano-IA, passando de humanos operando ferramentas para humanos supervisionando e colaborando com agentes autônomos.

Como as organizações podem se preparar para a era dos agentes?

Organizações que buscam utilizar agentes de IA de autoaprendizado devem começar identificando casos de uso de alto valor onde as capacidades dos agentes podem oferecer vantagens significativas em comparação com abordagens tradicionais. Tarefas que envolvem processos em múltiplos passos, integração com sistemas externos ou ambientes dinâmicos são candidatas ideais para implantação de agentes.

A infraestrutura técnica deve evoluir para suportar a operação de agentes. Isso inclui integrações de API robustas, acesso seguro a ferramentas e sistemas de monitoramento que possam rastrear o desempenho dos agentes e detectar problemas. As organizações também devem estabelecer estruturas de governança que definam limites apropriados para a autonomia dos agentes, garantindo ao mesmo tempo a conformidade com regulamentações relevantes.

Investir na alfabetização em agentes em toda a organização torna-se essencial à medida que esses sistemas se tornam mais prevalentes. Os funcionários precisam entender como os agentes operam, como fornecer orientação eficaz e como avaliar e aprimorar os resultados dos agentes. Essa mudança exige não apenas investimento técnico, mas também adaptação cultural.

Conclusão

Agentes de IA autodidatas representam um avanço fundamental nas capacidades de inteligência artificial. Ao contrário dos modelos tradicionais de aprendizado de máquina, que são estáticos e específicos para tarefas, os agentes podem se adaptar, planejar e executar fluxos de trabalho complexos de forma autônoma. Em comparação com os sistemas atuais baseados em LLM, os agentes adicionam operação proativa, memória persistente e a capacidade de realizar ações no mundo real por meio da integração de ferramentas.

A transição da IA reativa para agentes autônomos marca uma mudança de paradigma comparável à passagem da IA estreita para a compreensão geral da linguagem. Organizações que compreendem essas diferenças e se preparam adequadamente estarão melhor posicionadas para aproveitar o potencial transformador dos agentes de autoaprendizado. A era dos agentes não está se aproximando—já está aqui, redefinindo como o trabalho é feito e o que a IA pode alcançar.

Perguntas frequentes

Qual é a principal diferença entre agentes de IA e modelos tradicionais de aprendizado de máquina?

Modelos tradicionais de ML aprendem padrões durante o treinamento e os aplicam estaticamente a novas entradas, exigindo retreinamento para se adaptar. Agentes de IA autodidatas podem aprender continuamente com a experiência, adaptar-se a novas situações e operar de forma autônoma sem intervenção humana constante ou retreinamento.

Agentes de IA de autoaprendizado podem substituir os chatbots baseados em LLM atuais?

Agentes de IA e LLMs desempenham propósitos diferentes e muitas vezes são complementares, e não competitivos. LLMs se destacam na compreensão e geração de linguagem, enquanto agentes adicionam autonomia, capacidades de ação e aprendizado adaptativo. Muitos agentes na verdade utilizam LLMs como seu motor de raciocínio, acrescentando camadas para planejamento, memória e uso de ferramentas.

Agentes de IA de autoaprendizado exigem mais recursos computacionais do que modelos de ML tradicionais?

Agentes de autoaprendizado geralmente exigem mais recursos computacionais devido à sua complexidade, gerenciamento de estado persistente e frequentemente modelos subjacentes maiores. No entanto, as ganhos de eficiência provenientes da operação autônoma e da redução da necessidade de supervisão humana podem compensar esses custos em muitas aplicações.

Como os agentes de autoaprendizado lidam com erros e falhas?

Agentes de autoaprendizado conseguem reconhecer quando sua abordagem não está funcionando, analisar as razões para a falha e ajustar dinamicamente sua estratégia. Essa capacidade de refinamento iterativo permite que eles lidem melhor com situações imprevisíveis do que sistemas estáticos, embora o tratamento robusto de erros e a supervisão humana permaneçam importantes.

Agentes de IA autodidatas são seguros para uso empresarial?

Quando adequadamente projetados com limites adequados, agentes de autoaprendizado podem ser implantados com segurança em ambientes empresariais. As organizações devem estabelecer limites claros para a autonomia dos agentes, implementar sistemas de monitoramento e manter supervisão humana para decisões críticas. A chave é equilibrar as capacidades dos agentes com estruturas de governança adequadas.

Aviso legal: Esta página foi traduzida usando tecnologia de IA (alimentada por GPT) para sua conveniência. Para informações mais precisas, consulte a versão original em inglês.