SN24 lança a arquitetura Quasar-3B: Como o Bittensor TAO desafia a OpenAI em IA de contexto longo

2026/04/21 15:00:03

Introdução

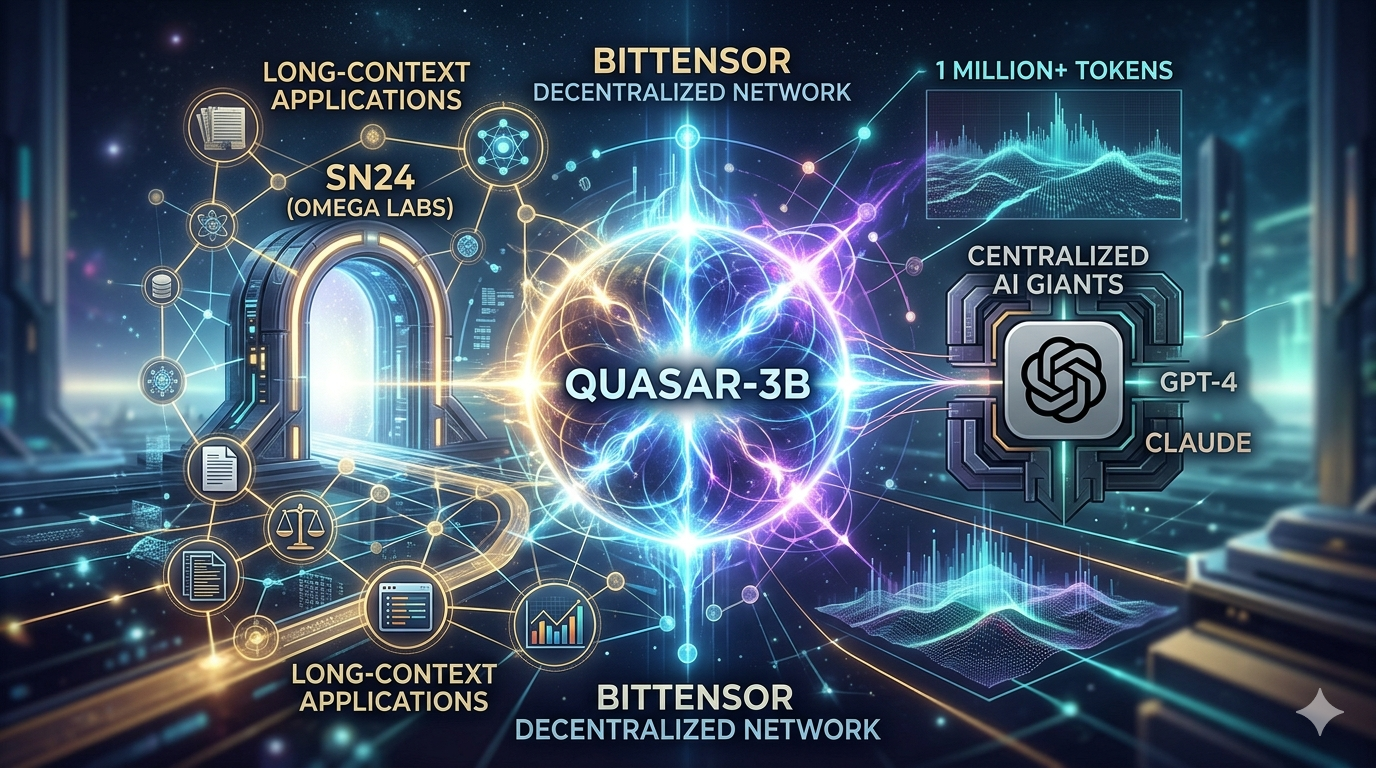

O cenário de inteligência artificial presenciou desenvolvimento significativo em abril de 2026, quando a SN24 (OMEGA Labs) anunciou o lançamento do Quasar-3B, um transformador contínuo em tempo cíclico especificamente projetado para inteligência de longo contexto.

Este anúncio representa mais do que um marco técnico - sinaliza a séria intenção do Bittensor de competir diretamente com gigantes de IA centralizados como a OpenAI em uma das dimensões de capacidade mais críticas: a habilidade de processar e raciocinar em contextos estendidos. Com o cenário de IA de longo contexto evoluindo rapidamente, a competição para construir modelos que possam processar efetivamente milhões de tokens tornou-se uma das batalhas mais consequentes no desenvolvimento de IA. A abordagem descentralizada do Bittensor por meio do Quasar-3B do SN24 agora entra nesse campo, desafiando a suposição de que apenas corporações centralizadas massivas podem empurrar os limites do que modelos de IA podem realizar. A questão já não é se a IA descentralizada pode competir - é quão rapidamente poderá fechar a lacuna com os jogadores estabelecidos.

Este artigo de pilar explora como o Quasar-3B se encaixa no contexto mais amplo do ecossistema do Bittensor. Para leitores novos nesse espaço, três tópicos fundamentais fornecem o contexto essencial:

-

entendendo What Is SN24 e seu papel na rede Bittensor,

-

explorando Why Is Long-Context AI Important e suas aplicações transformadoras em diversos setores;

-

e comparando How Does Bittensor's Decentralized Approach com o desenvolvimento tradicional centralizado de IA.

O que é o Quasar-3B: a resposta da SN24 aos desafios de contexto longo

Quasar-3B representa a solução da OMEGA Labs para uma das limitações mais persistentes da IA: a degradação da janela de contexto. Quando a maioria dos modelos processa documentos que excedem o comprimento do contexto de treinamento, a precisão cai significativamente. Pesquisas sugerem que o Claude perde mais de 30% de sua precisão após 1 milhão de tokens. Essa limitação restringe fundamentalmente o que os sistemas de IA podem realizar em aplicações práticas.

O nome da arquitetura "Quasar" evoca o fenômeno astronômico - objetos de imensa brilhância visíveis a grandes distâncias. Da mesma forma, o Quasar-3B visa iluminar contextos extensos, permitindo que a IA "veja" através de milhões de tokens com precisão mantida. A designação "3B" refere-se à contagem de parâmetros do modelo, com "1B Ativo" indicando que um bilhão de parâmetros permanecem ativamente envolvidos durante o processamento.

Inovações arquiteturais-chave distinguem o Quasar-3B dos transformadores convencionais. O design de transformador contínuo em tempo cíclico permite que o modelo mantenha o fluxo de informações ao longo de sequências extendidas sem a degradação típica que ocorre quando modelos processam contexto além de sua faixa otimizada. Essa escolha arquitetural resolve a limitação fundamental que tem restringido a competição entre Bittensor e OpenAI em aplicações de contexto longo.

Para entender o posicionamento estratégico do SN24 dentro do ecossistema mais amplo, é útil examinar o que a sub-rede realiza, operando como uma das unidades especializadas do Bittensor focadas em avançar as capacidades de contexto longo da rede, enquanto contribui para o maior conjunto de dados multimodal descentralizado do mundo.

A Arquitetura Técnica: Como o Quasar-3B alcança contexto estendido

Compreender a arquitetura técnica do Quasar-3B exige examinar por que o processamento de contexto longo se mostrou tão desafiador para sistemas de IA. Modelos transformer tradicionais usam mecanismos de atenção que escalam quadraticamente com o comprimento da sequência — dobrar o comprimento do contexto quadruplica os requisitos computacionais. Essa realidade matemática tornou o processamento de contexto estendido proibitivamente caro para a maioria das aplicações.

A abordagem de transformador de tempo contínuo em loop do Quasar-3B resolve esse desafio de escala por meio de inovações arquiteturais que mantêm a eficiência computacional mesmo à medida que o comprimento do contexto aumenta. O modelo alcança isso por meio de vários mecanismos. Primeiro, a modelagem de tempo contínuo permite que o sistema processe informações como um fluxo contínuo em vez de blocos discretos, reduzindo a sobrecarga associada ao particionamento. Segundo, a arquitetura em loop cria caminhos de feedback que permitem que a informação persista ao longo de sequências extendidas sem aumento proporcional na computação. Terceiro, pipelines de inferência otimizados garantem que essa capacidade expandida se traduza em aplicações práticas.

Os resultados do benchmark atraíram atenção significativa dentro da comunidade de pesquisa em IA. De acordo com o anúncio no X da equipe Quasar, o modelo demonstra desempenho competitivo nas avaliações do LongBench — o benchmark padrão para capacidades de IA com contexto longo. Enquanto números detalhados do benchmark continuam a surgir à medida que o modelo passa por testes da comunidade, indicadores iniciais sugerem progresso significativo em direção ao objetivo de manter a precisão através de milhões de tokens.

A implantação por meio da infraestrutura de sub-rede do Bittensor oferece vantagens adicionais. As 128 sub-redes ativas da rede permitem otimização especializada para diferentes aspectos do processamento de contexto longo. Sub-redes focadas em recuperação, processamento e validação podem trabalhar em conjunto com o Quasar-3B para entregar capacidades que exigiriam esforço de engenharia significativo para serem replicadas em sistemas centralizados.

Por que a IA de contexto longo é importante para a corrida da IA

A importância da IA de contexto longo vai muito além de um avanço técnico — representa uma mudança fundamental na capacidade que permite categorias inteiramente novas de aplicações. Para empresas e pesquisadores que trabalham com grandes conjuntos de documentos, processos jurídicos, bases de código ou arquivos de pesquisa, a capacidade de processar conjuntos inteiros de dados em contexto transforma o que se torna possível.

Abordagens tradicionais de IA exigiam dividir documentos grandes em pedaços menores, perdendo a capacidade de identificar padrões que se estendem por todo o conjunto de dados. Uma equipe jurídica revisando uma fusão com milhares de documentos não podia fazer perguntas que exigissem compreensão das relações entre todos os materiais. Um desenvolvedor analisando uma base de código de um milhão de linhas não podia obter assistência de IA que compreendesse o contexto completo do sistema. A IA de longo contexto remove essas limitações, permitindo aplicações em áreas como jurídico, saúde, finanças e pesquisa que anteriormente eram impraticáveis.

O cenário competitivo intensificou-se à medida que grandes players reconhecem essa dinâmica. O GPT-4.5 da OpenAI e o Claude Opus 4.6 da Anthropic impulsionaram as janelas de contexto para 1 milhão de tokens, com o Gemini alcançando 2 milhões. Esses desenvolvimentos validam a direção do mercado, elevando o padrão para os concorrentes. A entrada do Bittensor por meio do Quasar-3B representa o desafio descentralizado mais sério a este espaço.

Para aqueles que buscam uma compreensão mais aprofundada sobre por que essas capacidades são importantes e quais indústrias se beneficiam mais, a análise da IA de contexto longo revela potencial transformador em diagnóstico médico, revisão de documentos jurídicos, análise de portfólios financeiros e síntese de literatura acadêmica.

Como o modelo descentralizado do Bittensor compete com a IA centralizada

A comparação entre a abordagem descentralizada do Bittensor e o modelo de desenvolvimento centralizado da OpenAI adquire novas dimensões com o lançamento do Quasar-3B. Entender como a competição entre Bittensor e OpenAI se manifesta na IA de contexto longo exige examinar múltiplas dimensões da rivalidade.

Do ponto de vista de recursos, a OpenAI desfruta de vantagens significativas. A parceria da empresa com a Microsoft fornece acesso a uma infraestrutura computacional massiva. Relata-se que os treinamentos do GPT-4 custaram mais de US$ 100 milhões. Essa intensidade de capital cria barreiras que redes descentralizadas têm dificuldade em igualar diretamente. No entanto, o modelo distribuído do Bittensor utiliza capital de milhares de participantes, em vez de exigir investimento de uma única entidade. O desenvolvimento do Quasar-3B demonstra que capacidade significativa de IA pode emergir desse modelo distribuído.

As estruturas de incentivo diferem fundamentalmente. Os benefícios do desenvolvimento da OpenAI fluem principalmente para a empresa e seus investidores. Os funcionários e pesquisadores recebem compensação, mas não participam da criação de valor a longo prazo. O modelo crypto-econômico do Bittensor significa que os contribuidores para o desenvolvimento do Quasar-3B ganham tokens TAO que se valorizam à medida que a rede cresce. Essa alinhamento cria padrões de motivação diferentes que podem impulsionar a inovação por meio da competição.

A arquitetura demonstra como redes descentralizadas podem se especializar efetivamente. Em vez de construir capacidades de propósito geral que tentam ser tudo para todos, as subnets podem se concentrar em desafios específicos. O Quasar-3B concentra-se exclusivamente no processamento de contexto longo, otimizando profundamente essa capacidade em vez de distribuir recursos para melhorias gerais.

Para leitores interessados em compreender os compromissos de escalabilidade entre essas abordagens, a comparação detalhada mostra que cada modelo apresenta vantagens distintas dependendo dos requisitos do caso de uso.

As comparações de desempenho continuam a evoluir à medida que ambas as abordagens amadurecem. Os modelos da OpenAI atualmente lideram nos benchmarks de capacidade geral. As sub-redes do Bittensor demonstraram desempenho competitivo em tarefas específicas. A dimensão de contexto longo representa um domínio onde o Bittensor pode potencialmente liderar, em vez de seguir, dadas as inovações arquiteturais, como o design de transformador de tempo contínuo do Quasar-3B.

A Importância Estratégica para TAO e o Ecossistema Bittensor

O lançamento do Quasar-3B traz implicações significativas para o ecossistema mais amplo do Bittensor e especificamente para o token TAO. Compreender essas implicações exige examinar como o sistema de subnet cria valor para toda a rede.

As subnets dentro do Bittensor operam como mercados especializados, cada uma focada em diferentes capacidades de IA. O sucesso das subnets individuais contribui para o valor geral da rede por meio de vários mecanismos. Primeiro, subnets úteis atraem consultas que geram emissões de TAO. Segundo, subnets bem-sucedidas demonstram a capacidade da rede, atraindo mais participantes. Terceiro, o sistema dTAO significa que a valorização dos tokens da subnet beneficia os detentores de TAO por meio do mecanismo de criador de mercado automático.

O lançamento do Quasar-3B fortalece a rede de várias maneiras. O modelo oferece uma capacidade anteriormente indisponível no cenário de IA descentralizada, atraindo usuários que precisam de processamento de contexto longo. A inovação técnica demonstra que o Bittensor pode produzir pesquisa de IA de ponta. A atenção gerada pelo lançamento valida a abordagem de subnet para o desenvolvimento de IA.

O posicionamento competitivo torna-se mais atraente com o Quasar-3B em produção. Usuários empresariais avaliando opções de IA agora têm uma alternativa descentralizada que pode igualar certas capacidades de provedores centralizados. Essa concorrência beneficia todo o mercado, enquanto potencialmente captura valor para o ecossistema Bittensor.

Para investidores que avaliam TAO, o lançamento do Quasar-3B representa um ponto de prova para a tese de investimento. A capacidade de desenvolver modelos de IA competitivos por meio de coordenação descentralizada valida a abordagem fundamental. Lançamentos futuros de sub-redes podem apontar para o Quasar-3B como evidência de que a rede pode competir com o desenvolvimento centralizado de IA.

Aplicações do mundo real habilitadas pela capacidade de contexto longo do Quasar-3B

As aplicações práticas da capacidade de contexto estendido do Quasar-3B abrangem indústrias e casos de uso que anteriormente eram impraticáveis para assistência por IA. Compreender essas aplicações demonstra por que a corrida pelo contexto longo importa além da conquista técnica.

As aplicações da indústria jurídica se transformam quando arquivos de casos inteiros podem ser processados em contexto. Em vez de revisar documentos individuais isoladamente, os advogados podem consultar históricos litigiosos completos, identificando padrões e precedentes em todos os materiais. A análise de contratos pode rastrear obrigações e dependências em bibliotecas inteiras de acordos. A due diligence pode incorporar documentação abrangente da empresa em uma única análise.

O desenvolvimento de software se beneficia da compreensão de todo o código em contexto. Auditorias de segurança podem analisar repositórios completos, identificando vulnerabilidades que se estendem por vários arquivos. A revisão de código pode compreender o contexto completo das alterações, não apenas diffs em isolamento. A geração de documentação pode incorporar uma compreensão abrangente da arquitetura do sistema.

A análise financeira atinge nova sofisticação com contexto histórico completo. A análise de carteira pode incorporar décadas de dados de mercado. A avaliação de risco pode avaliar posições em todas as carteiras simultaneamente. A pesquisa pode sintetizar históricos completos de resultados e arquivos regulatórios.

Aplicações de saúde permitem análise abrangente de pacientes. O diagnóstico pode considerar históricos médicos completos que abrangem anos. A pesquisa pode analisar conjuntos inteiros de dados de ensaios clínicos. A conformidade regulatória pode processar estruturas de políticas abrangentes.

A pesquisa acadêmica se transforma quando é possível engajar corpos inteiros de literatura. A revisão da literatura pode sintetizar descobertas ao longo de décadas de publicações. A pesquisa interdisciplinar pode conectar insights entre campos. A análise de bolsas pode avaliar histórias completas de propostas.

A indústria de blockchain se beneficia especificamente dessas capacidades. A auditoria de contratos inteligentes pode analisar implementações completas de protocolos. A análise DeFi pode avaliar interações do ecossistema de forma abrangente. A análise on-chain pode incorporar históricos completos de transações.

Mapa de Estrada Futuro: O que vem a seguir para SN24 e Quasar

O lançamento do Quasar-3B representa um marco, e não um destino final. De acordo com informações da documentação da sub-rede, o plano de desenvolvimento se estende até 2026 e além, com várias fases de desenvolvimento.

O Q4 de 2025 viu o lançamento inicial da subnet na testnet do Bittensor, a implementação da avaliação LongBench, a implantação do modo mock e a integração do monitoramento WandB. Esses elementos fundamentais estabeleceram a infraestrutura para o desenvolvimento contínuo.

O Q1 de 2026 focou na expansão das capacidades de contexto longo e na melhoria das métricas de avaliação. O anúncio do Quasar-3B em abril de 2026 representa o resultado desses esforços, mas a contínua melhoria permanece como foco.

Desenvolvimentos esperados para o restante de 2026 incluem variantes adicionais do modelo otimizadas para diferentes casos de uso, comprimentos de contexto expandidos além das capacidades atuais, integração com outras sub-redes do Bittensor para entrega aprimorada de capacidades e melhorias impulsionadas pela comunidade por meio do mecanismo de incentivo.

A pressão competitiva dos provedores centralizados de IA garante inovação contínua em toda a indústria. À medida que OpenAI, Anthropic e Google expandem as janelas de contexto, concorrentes descentralizados devem acompanhar esse progresso enquanto demonstram vantagens distintas. A abordagem do Bittensor de especialização por meio de subnets fornece um framework para essa competição contínua.

Para o movimento mais amplo de IA descentralizada, o Quasar-3B representa um ponto de prova. A demonstração de que capacidades de IA competitivas podem emergir de redes descentralizadas valida a tese fundamental. Projetos futuros podem se basear nessa fundação, potencialmente acelerando o desenvolvimento de alternativas de IA descentralizadas.

Devo investir em TAO na KuCoin?

Para traders avaliando a exposição ao ecossistema Bittensor, o lançamento do Quasar-3B fornece contexto adicional para decisões de investimento.

Considerações de alta

-

Validação competitiva: o Quasar-3B demonstra que o Bittensor pode desenvolver capacidades de IA de ponta, validando a abordagem descentralizada

-

Oportunidade de mercado de longo contexto: O mercado de IA de contexto estendido representa uma oportunidade significativa e em crescimento, avaliada em bilhões

-

Força do ecossistema da Subnet: O sucesso do Quasar-3B da SN24 fortalece o ecossistema mais amplo da Subnet

-

Diferenciação técnica: Inovações arquiteturais, como transformadores de tempo contínuo, oferecem capacidades distintas

Fatores de Risco

-

Concorrência centralizada: Grandes empresas de tecnologia continuam investindo bilhões em IA de contexto longo, potencialmente superando alternativas descentralizadas

-

Incerteza na execução: Traduzir inovações arquitetônicas em aplicações práticas exige execução contínua

-

Ambiente regulatório: Tanto criptomoedas quanto IA enfrentam quadros regulatórios em evolução globalmente

-

Volatilidade do mercado de criptomoedas: TAO permanece altamente volátil em comparação com ativos tradicionais

Estrutura Estratégica

O lançamento do Quasar-3B representa um desenvolvimento significativo para o ecossistema Bittensor, mas deve ser avaliado dentro do contexto geral da carteira. Considere o tamanho da posição com base na convicção na tese de IA descentralizada, mantendo uma gestão de risco adequada diante da volatilidade do mercado de criptomoedas.

Como negociar TAO na KuCoin

Etapa 1: Crie sua conta KuCoin

Se você está pronto para negociar TAO, o primeiro passo é criar sua conta KuCoin. Novos usuários podem se registrar na KuCoin e receber até 11.000 USDT em recompensas para novos usuários — um bônus substancial que pode aumentar seu capital inicial para negociação. Basta visitar o site da KuCoin ou baixar o aplicativo móvel, completar o processo de registro com seu e-mail ou número de telefone e verificar sua identidade para desbloquear essas recompensas. O processo de registro leva apenas alguns minutos, e o bônus de boas-vindas oferece um excelente ponto de partida para explorar oportunidades de negociação de TAO.

Etapa 2: Execute sua negociação

Após a configuração da sua conta, busque por "TAO/USDT" na interface de negociação da KuCoin. O TAO geralmente oferece boa liquidez para a maioria dos tamanhos de posição, embora a liquidez possa variar conforme as condições de mercado. Durante períodos de alta volatilidade em torno de anúncios importantes, como o lançamento do Quasar-3B, considere usar ordens limite em vez de ordens de mercado para gerenciar a derrapagem. Avalie seu ponto de entrada com base nas condições atuais do mercado e na sua tolerância ao risco antes de executar a negociação.

Etapa 3: Gerenciamento de posição

Dada a volatilidade inerente aos criptoativos de IA, estabeleça metas claras de lucro e níveis de stop-loss antes de entrar em uma posição. Monitore os desenvolvimentos da SN24, os lançamentos mais amplos da sub-rede Bittensor e o cenário competitivo entre IA descentralizada e centralizada. Ajuste sua posição com base na avaliação contínua da tese, e não em respostas emocionais às movimentações de preço.

Conclusão

O lançamento do Quasar-3B pela SN24 representa um momento decisivo para a IA descentralizada. Ao demonstrar que o Bittensor pode desenvolver capacidades competitivas de IA com contexto longo por meio de sua rede distribuída, o projeto desafia suposições sobre quem pode empurrar os limites da inteligência artificial. As inovações arquiteturais no transformador contínuo em loop do Quasar-3B fornecem uma base para avanços contínuos.

A dinâmica competitiva entre IA descentralizada e centralizada continua evoluindo. A OpenAI mantém vantagens em capital e escala. No entanto, o alinhamento de incentivos do Bittensor, sua especialização por meio de subnets e a participação global criam vantagens distintas. A competição entre Bittensor e OpenAI tornou-se mais interessante com este desenvolvimento.

Para a indústria de IA como um todo, a coexistência de múltiplas abordagens beneficia a todos. A concorrência impulsiona a inovação, enquanto a diversidade proporciona resiliência. A demonstração de que redes descentralizadas podem competir valida estruturas de desenvolvimento alternativas.

Para investidores, o lançamento do Quasar-3B fornece evidências que sustentam a tese de investimento no Bittensor. No entanto, o tamanho da posição deve refletir a adoção de tecnologia em estágio inicial e a volatilidade do mercado de criptomoedas.

Perguntas frequentes

Q: O que é Quasar-3B?

A: Quasar-3B é um modelo de IA de contexto longo lançado pela SN24 (OMEGA Labs) na rede Bittensor em abril de 2026. Ele utiliza uma arquitetura de transformer de tempo contínuo com loop, projetada para raciocínio eficiente em milhões de tokens. O "3B" refere-se a 3 bilhões de parâmetros, com 1 bilhão ativos durante o processamento.

P: Como o Quasar-3B se compara aos modelos de contexto longo da OpenAI?

A: O Quasar-3B visa especificamente o desafio do contexto longo com inovações arquiteturais que mantêm a precisão em sequências estendidas. Embora comparações detalhadas de benchmarks continuem surgindo, o modelo demonstra desempenho competitivo nas avaliações do LongBench. O modelo de desenvolvimento descentralizado oferece vantagens diferentes da abordagem centralizada da OpenAI.

Q: O que torna a arquitetura Quasar diferente dos transformadores tradicionais?

A: O Quasar utiliza um design de transformador contínuo com loop que permite que a informação flua através de sequências estendidas sem aumento proporcional na computação. Isso resolve o problema de escalonamento quadrático que torna a extensão do contexto dos transformadores tradicionais cara.

P: Como o SN24 se encaixa no ecossistema mais amplo do Bittensor?

A: SN24 (OMEGA Labs) é uma das 128 sub-redes ativas do Bittensor, focada em criar o maior conjunto de dados multimodal descentralizado do mundo. A sub-rede contribui para o ecossistema tanto por meio da infraestrutura de dados quanto por meio de capacidades de IA como o Quasar-3B.

Q: Quais são as aplicações do mundo real para o Quasar-3B?

A: As aplicações incluem análise de documentos legais em arquivos de casos completos, auditoria de segurança de software em bases de código inteiras, análise financeira incorporando décadas de dados de mercado, análise de saúde em históricos completos de pacientes e síntese de pesquisa acadêmica em corpos inteiros de literatura.

Aviso legal: Esta página foi traduzida usando tecnologia de IA (alimentada por GPT) para sua conveniência. Para informações mais precisas, consulte a versão original em inglês.